| БрМЭЦМі: |

| РДдДcsdn

,жївЊНВНтСЫGroupByЛњжЦЃЌgroupsжаЕФЕќДњЃЌDictsгыSeriesЗжзщЃЌгІгУКЏЪ§НјааЗжзщЃЌИљОнЫїв§ЕШМЖЗжзщЃЌЪ§ОнОлКЯЕШНсКЯАИР§ЯъЯИНВНтЁЃ |

|

import numpy as

np

import pandas as pd |

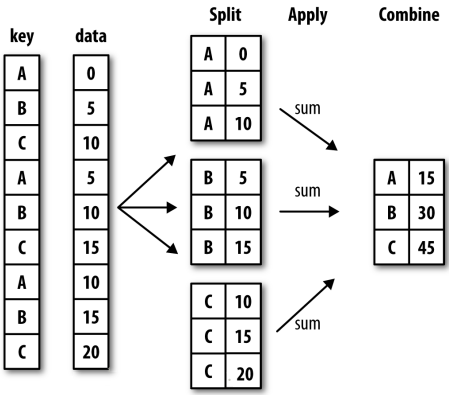

GroupByЛњжЦ

ЩЯЭМЯдЪОСЫвЛИіЗжзщБГКѓЕФОпЬхВйзїЃЌЕБВйзївЛИіЪ§ОнМЏАДееФГИіkeyНјааЗжзщЪБЃЌЪ§ОнМЏЪзЯШЛсАДзщНјааЗжИюЃЌШЛКѓдйЖдУПвЛзщгІгУКЏЪ§ЃЌзюКѓЗЕЛиЗжзщКѓЕФНсЙћЁЃ

df=pd.DataFrame({

'key1':['a','a','b','b','a'],

'key2':['one','two','one','two','one'],

'data1':np.random.randn(5),

'data2':np.random.randn(5)

})

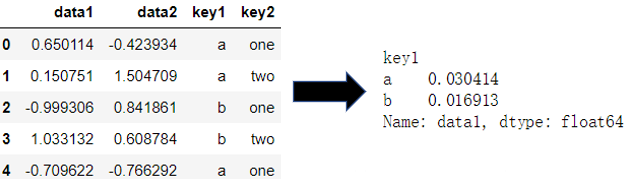

df.loc[:,'data1'].groupby(df.loc[:,'key1']).mean()

#НЋdata1СаАДееkey1НјааЗжзщ,дйЧѓОљжЕ

|

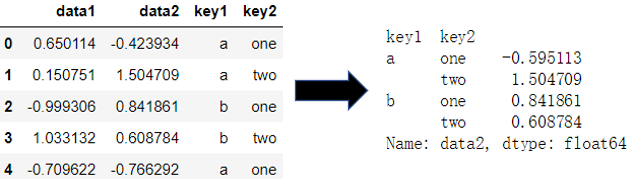

ЕБашвЊАДееЖрИіkeyНјааЗжзщЪБЃЌИјgroupby()ДЋЕнвЛИіСаБэМДПЩЃЌЕУЕНЕФНсЙћЪЧОпгаВуМЖindexЕФSeriesЃК

mean=df.loc[:,'data1'].groupby([df.loc[:,'key1'],df.loc[:,'key2']]).mean()

mean.unstack() |

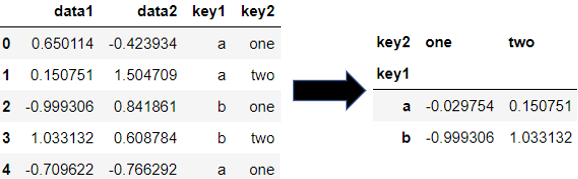

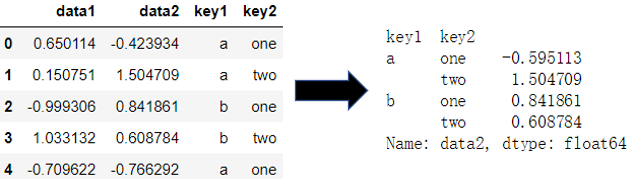

ЕБЖдећИіЪ§ОнМЏНјааЗжзщЪБЃЌПЩвджБНгИјgroupby()ДЋЕнkeyЕФжЕЃЌДЫЪБВЛПЩдйгУloc()гыiloc()ЗНЗЈЃЌвђЮЊgroupby()ЩњГЩЕФЪЧвЛИіgroupbyЖдЯѓЃЌЖјВЛЪЧDataFrameЃК

| df.groupby(['key1','key2'])['data2'].mean() |

СэвЛИігІгУгкgroupby()жЎКѓЕФЗНЗЈЮЊsize()ЃК

| df.groupby(['key1','key2']).size() |

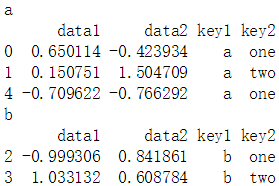

groupsжаЕФЕќДњ

GroupByЖдЯѓЪЧвЛИіПЩЕќДњЖдЯѓЃК

for key,data

in df.groupby('key1'):

print(key)

print(data) |

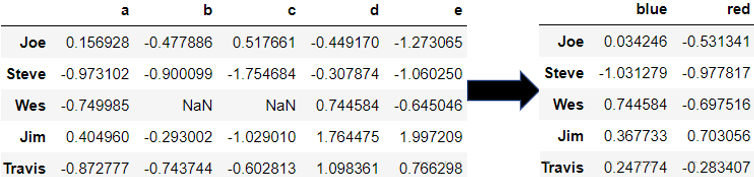

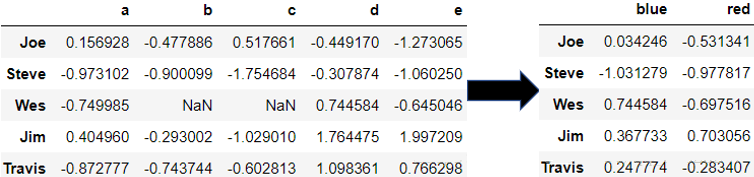

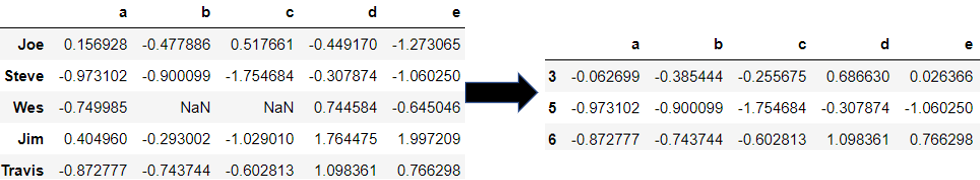

ИљОнDictsгыSeriesЗжзщ

НЈСЂгГЩфЙиЯЕШчdictЛђseriesЃЌНЋСаЯШНјаагГЩфдйНјааЗжзщЁЃ

people=pd.DataFrame(

np.random.randn(5,5),

index=['Joe','Steve','Wes','Jim','Travis'],

columns=['a','b','c','d','e']

)

people.iloc[2,[1,2]]=None

mapping={

'a':'red',

'b':'red',

'c':'blue',

'd':'blue',

'e':'red',

'f':'orange'

}

people.groupby(mapping,axis=1).mean()

|

map_series=pd.Series(mapping)

people.groupby(map_series,axis=1).mean() |

гІгУКЏЪ§НјааЗжзщ

БШШчЖдЩЯЪіЪ§ОнМЏЃЌШчашвЊЖдУћзжГЄЖШНјааЗжзщЃЌдђПЩвдИјgroupby()ДЋЕнвЛИіКЏЪ§зїЮЊВЮЪ§ЃК

| people.groupby(len,axis=0).mean() |

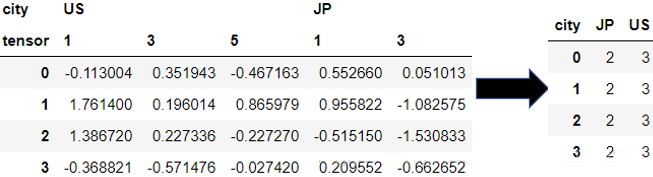

ИљОнЫїв§ЕШМЖЗжзщ

ЖдгкДјВуМЖЫїв§ЕФЪ§ОнМЏЃЌПЩвдИљОнФГвЛВуМЖЕФЫїв§УћГЦНјааЗжзщЃЌжИЖЈВЮЪ§level=МДПЩЃК

hier_df=pd.DataFrame(

np.random.randn(4,5),

columns=[['US','US','US','JP','JP'],

[1,3,5,1,3]]

)

hier_df.columns.names=['city','tensor']

hier_df.groupby(level='city',axis=1).count()

|

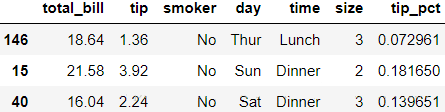

Ъ§ОнОлКЯ

tips=pd.read_csv('examples/tips.csv')

tips.loc[:,'tip_pct']=tips.loc[:,'tip']/tips.loc[:,'total_bill']

tips.sample(3)

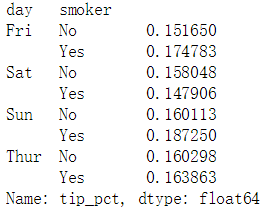

|

grouped=tips.groupby(['day','smoker'])

grouped['tip_pct'].mean() |

ПЩвдЖдgroupbyЖдЯѓЕФagg()ЗНЗЈДЋЕнвЛИіКЏЪ§УћСаБэЃЌЛсЗЕЛивЛИіgroupbyЖдЯѓгІгУКЏЪ§КѓЩњГЩЕФDataFrameЃК

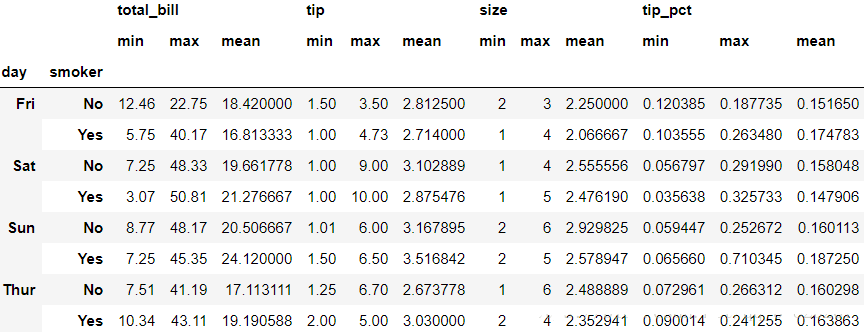

| grouped.agg(['min','max','mean']) |

ЗЕЛиЮоааЫїв§ЕФОлКЯЪ§Он

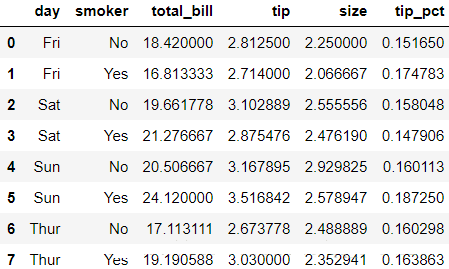

ЪЙгУВЮЪ§as_index=ВЮЪ§РДЗЕЛивЛИіЮоааЫїв§ЕФЪ§ОнЃК

| tips.groupby(['day','smoker'],as_index=False).mean() |

ПЩМћааЫїв§БЛзЊЛЛГЩСЫСажЕЁЃ

Apply

GroupBy()ЗНЗЈзюЦеБщЕФФПЕФОЭЪЧдкЪ§ОнМЏЩЯгІгУКЏЪ§вдЩИбЁГіЯывЊЕФЪ§ОнЁЃБШШчгУЛЇздМКаДСЫвЛИіtop()КЏЪ§ЃЌЫќЛсЗЕЛиDataFrameжИЖЈСажажЕзюДѓЕФnЬѕМЧТМЃК

def top(df,n=5,column='tip_pct'):

return df.sort_values(by=column).iloc[-n:,:] |

| tips.groupby('smoker').apply(top,n=3)

#ЩИбЁ3Ьѕtip_pctзюДѓЕФЪ§Он |

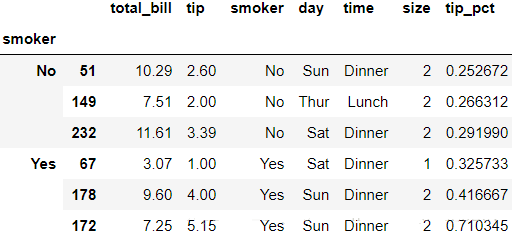

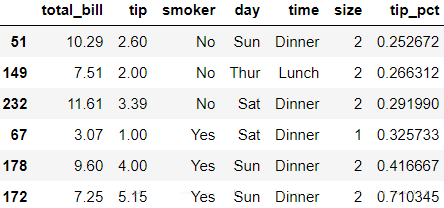

ПЩвдПДЕНвдЁЏsmokerЁЏЗжзщЗНЗЈЩИбЁГіРДЕФЪ§ОнЬѕФПжаЛЙАќКЌСЫгЩЗжзщВњЩњЕФЁЏsmokerЁЏааЫїв§ЃЌПЩвдЪЙгУВЮЪ§group_keys=РДЯћГ§ЗжзщЫїв§ЃК

| tips.groupby ('smoker',group_keys =False).apply(top,n=3)

#ЩИбЁ3Ьѕtip_pctзюДѓЕФЪ§Он |

ЗжЮЛЪ§гыЭАЗжЮі

frame=pd.DataFrame({

'data1':np.random.randn(1000),

'data2':np.random.randn(1000)

})

quartiles= pd.cut(frame.loc[:,'data1'],4) #вдdata1ЩњГЩЫФИіЧјМф

|

def get_stats(group):

return {

'min':group.min(),

'max':group.max(),

'mean':group.mean()

}

|

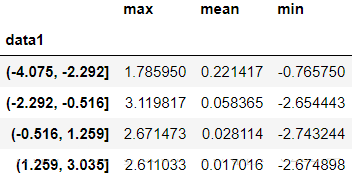

grouped= frame.loc[:,'data2' ].groupby(quartiles)

#вдdata1ЕФЧјМфРДЖдdata2НјааЗжзщ

grouped.apply(get_stats).unstack() |

ЪОР§

ЫцЛњВЩбљгыИФађ

МйЩшашвЊЩњГЩвЛзщЫцЛњВЩбљ(гаЗХЛиЛђЮоЗХЛи)РДзіУЩЬиПЈТхЗжЮіЃЌЛђепЪЧгУзіЛњЦїбЇЯАЯюФПжаЕФЪ§ОнзгМЏЃЌашвЊЖддЪ§ОнМЏНјааЫцЛњВЩбљЛђепИФађЁЃ

#ЩњГЩвЛИБХЦзщSeries

suits=['H','S','C','D']

base_name=['A']+list(range(2,11))+['J','Q','K']

cards=[]

for suit in suits:

cards.extend(str(num)+suit for num in base_name)

card_val=(list(range(1,14)))*4

deck=pd.Series(card_val,index=cards)

|

#ГщХЦКЏЪ§

def draw(deck,n=5):

return deck.sample(n)

|

4H 4

6C 6

5C 5

AH 1

7C 7

dtype: int64

МйЩшЯждкашвЊДгУПИіЛЈЩЋжаЫцЛњГщГіСНеХХЦЃЌПЩвдЯШАДЛЈЩЋРДЖдХЦзщНјааЗжзщдйгІгУГщХЦКЏЪ§ЃК

get_suit=lambda

card:card[-1] #cardЕФзюКѓвЛЮЛБэЪОЛЈЩЋ,етРяУЛЬЋЖЎ

deck.groupby (get_suit,group_keys=False).apply (draw,n=2) |

6C 6

10C 10

KD 13

QD 12

9H 9

JH 11

5S 5

6S 6

dtype: int64

ЗжзщЕФМгШЈОљжЕгыЯрЙиЯЕЪ§

ШчЙћЪ§ОнЪЧДјШЈжиЕФЃЌЪЙгУapply()ЗНЗЈПЩвдКмЗНБуЕФМЦЫуМгШЈЦНОљжЕЃК

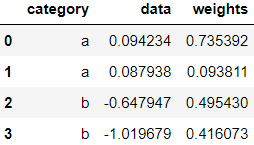

frame=pd.DataFrame({

'category':['a','a','b','b'],

'data':np.random.randn(4),

'weights':np.random.rand(4)

})

frame |

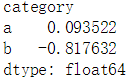

get_wavg=lambda

grouped:np.average(grouped.loc[:,'data'],weights=grouped.loc[:,'weights'])

frame.groupby('category').apply(get_wavg) |

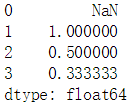

дкЯТвЛИіР§згЧАЃЌЯШСЫНтвЛЯТpct_change()ЗНЗЈЃК

obj=pd.Series(np.arange(1,5))

obj.pct_change() |

НгЯТРДЮвУЧЕМШывЛИіецЪЕЪ§ОнМЏЃЌНјааЯрЙиадЗжЮіЃК

close_px=pd.read_csv ('examples/stock_px_2.csv', parse_dates=True,index_col=0)

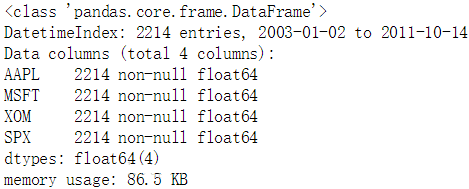

close_px.info() |

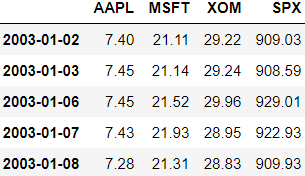

ЪЙгУpct_change()РДМЦЫуШеЛиБЈТЪЃК

eturns=close_px.pct_change().dropna()

returns.head() |

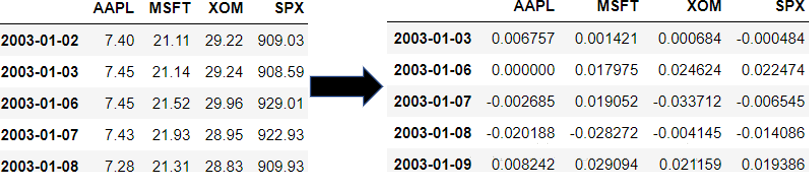

ЮвУЧАбЪ§ОнАДФъНјааОлКЯЃЌдйЪЙгУapply()ЗНЗЈЯдЪОвдSPXЮЊВЮееЕФИїЙЋЫОЪевцЯрЙиадЃК

get_year=lambda

timestamp:timestamp.year #ДЫЪ§ОнМЏЕФааЫїв§ЮЊЪБМфЖдЯѓ,Юоloc()ЗНЗЈ

spx_cor=lambda x:x.corrwith(x.loc[:,'SPX']) |

| returns.groupby(get_year).apply(spx_cor) |

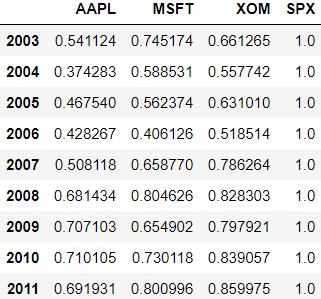

ЛЙПЩвдЕУЕНжИЖЈСНМвЙЋЫОЕФФъЪевцЯрЙиадЃК

AAPL_cor_MSFT=lambda

x:x.loc[:,'AAPL'].corr(x.loc[:,'MSFT'])

returns.groupby(get_year).apply(AAPL_cor_MSFT) |

2003 0.480868

2004 0.259024

2005 0.300093

2006 0.161735

2007 0.417738

2008 0.611901

2009 0.432738

2010 0.571946

2011 0.581987

dtype: float64

ЭИЪгБэгыНЛВцБэ

pivot_table()ЗНЗЈгыgroupby()ЗНЗЈФмЕУЕНЯрЫЦЕФНсЙћЃЌВЛЙ§pivot_table()ЗНЗЈФмЬсЙЉИќЧПДѓЕФЙІФмЁЃ

tips=pd.read_csv('examples/tips.csv')

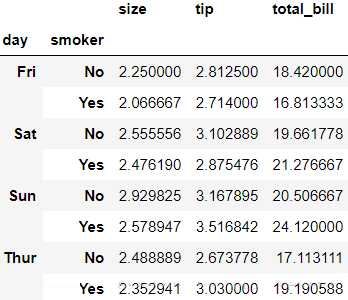

tips.pivot_table(index=['day','smoker']) |

вдЩЯНсЙћЭЌбљПЩвдЭЈЙ§tips.groupby(['day','smoker'])ЕУЕНЁЃШчЙћЯждкЮвУЧжЛЯыЩњГЩtipКЭsizeСаЕФЭИЪгБэЃЌвдtimeКЭdayРДЗжзщЃК

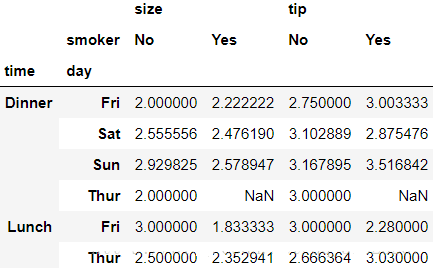

| tips.pivot_table(['tip','size'],index=['time','day'],columns='smoker') |

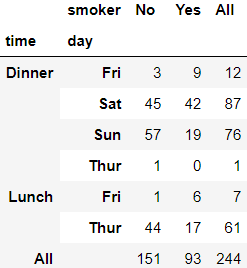

НЛВцБэ

вдСНИіSeriesЛђlistзщГЩвЛИіБэ

| pd.crossta([tips.loc[:,'time'], tips.loc[:,'day']], tips.loc[:,'smoker'], margins=True)

#marginsЯдЪОзмЖю |

|