| Īŗľ≠Õ∆ľŲ: |

ĪĺőńŌÚīůľ“Ĺť…‹Ņ™∑ĘĻż≥Ő÷–£¨ĺ≠≥£ĽŠ–Ť“™∂‘ő“√«Ņ™∑ĘĶń≥Ő–Ú◊Ų–‘ń‹∑÷őŲ£¨”–ļ‹∂ŗ–‘ń‹∑÷őŲĶńĻ§ĺŖ£¨ļ‹∂ŗ”Ô—‘∂ľŐŠĻ©Ńň≤ĽÕ¨ĶńprofilingĻ§ĺŖ£¨’‚–©Ļ§ĺŖļ‹”–”√£¨ŐŠĻ©Ńň≥Ő–Ú‘ň––Ķń‘≠ ľľ«¬ľ żĺ›,Ō£ÕŻ∂‘ńķĶń—ßŌį”–ňýįÔ÷ķ°£

Īĺőńņī◊‘”ŕcsdn£¨”…ĽūŃķĻŻ»ŪľĢDeloresĪŗľ≠°ĘÕ∆ľŲ°£ |

|

ĺŖ ÷ĽķĶń żĺ›Ī»ĹŌ‘≠ ľ£¨ÕýÕýĽĻ–Ť“™“Ľ–©łŁĹÝ“Ľ≤ĹĶń∑÷őŲ£¨≤Ňń‹∂®őĽő Ő‚°£

Splunk «“ĽłŲŅ…“‘‘ň––‘ŕ≤ĽÕ¨∆ĹŐ®…ŌĶńĽķ∆ų żĺ›Ķń Ķ Ī‘ňő¨∆ĹŐ®£¨ňýőĹĽķ∆ų żĺ›£¨ĺÕ «÷łĽķ∆ų≤ķ…ķĶń żĺ›£¨∆š÷–“ĽłŲ≥£ľŻĶń≥°ĺįĺÕ «»’÷ĺ°£∂‘”ŕĻ„īů≥Ő–Ú‘ĪņīňĶ£¨∑÷őŲ»’÷ĺ «“ĽłŲ∑«≥£≥£ľŻ£¨∂Ý«“∑ĪňŲĶńĻ§◊ų£¨∂Ý«“ļ‹∂ŗ ĪļÚ£¨Īō–ŽÕ®Ļż»’÷ĺņī∂‘≥Ő–ÚĹÝ––Ķų ‘£¨ņż»Á∂ŗŌŖ≥ŐĶń«ťŅŲ°£ľ«Ķ√“‘«įő™ŃňľłįŔ’◊ĽÚ’ŖľłGĶń»’÷ĺĹÝ––∑÷őŲ£¨≤ĽĶ√≤Ľ–īŃňlogViewerņī∑÷őŲ°£Ō÷‘ŕ”–ŃňSplunk£¨’śĶńľęīůĶńľÚĽĮŃň∂‘»’÷ĺ∑÷őŲĶńĻ§◊ų°££®◊ĘSplunk√‚∑—įś÷ß≥÷√ŅŐž500MĶń»’÷ĺ żĺ›£¨≥¨Ļż’‚łŲ∂Ó∂»–Ť“™ ’∑—£©

Õ®Ļż»’÷ĺĹÝ–––‘ń‹≤‚ ‘ «∑«≥£≥£ľŻĶń£¨īęÕ≥Ķń“≤ «‘ŕ“™∑÷őŲĶńīķ¬Žī¶£¨◊Ę»Ž–‘ń‹»’÷ĺ£¨»Ľļů‘ŕ≥Ő–Ú‘ň––ļů£¨∂‘–ī»ŽĶń–‘ń‹ żĺ›ĹÝ––∑÷őŲ°£ Ļ”√Splunk£¨∑Ĺ∑® «“Ľ—ýĶń£¨Ķę «”–“‘Ō¬√ųŌ‘ĶńłńĹÝ

SplunkŐŠĻ©īůŃŅ”—ļ√Ķń∑÷őŲ√ŁŃÓļÕÕľĪŪ£¨őř–ŤŃŪ––Ņ™∑Ę∑÷őŲ»’÷ĺĶń≥Ő–Ú

SplunkŅ…“‘ Ķ ĪĶń∂‘”¶”√≥Ő–Ú◊ų∑÷őŲ£¨Ņ…“‘‘ŕ≥Ő–ÚĶń‘ň––Ļż≥Ő÷–£¨“ĽĪŖ‘ň––£¨“ĽĪŖ∑÷őŲ

ő“Ō¬√śĺŔ“ĽłŲő“ŇŲĶĹĶńņż◊”°£

ő““™∑÷őŲĶń≥Ő–Ú «“ĽłŲī”AWS CloudWatch ’ľĮ żĺ›ĶńPython≥Ő–Ú°£ ’ľĮ żĺ› Ļ”√Ķń «AWSŐŠĻ©ĶńRestful API (Boto),ő™ŃňłŁłŖ–ßĶń ’ľĮ żĺ›£¨≥Ő–Ú Ļ”√∂ŗłŲŌŖ≥ŐņīĶų”√Restful API ĶńQueryĹ”Ņŕ°£ő“Ō£ÕŻÕ®Ļż–‘ń‹»’÷ĺŃňĹ‚√Ņ“ĽłŲ«Ž«ůīůłŇĶńļń Ī£¨“‘ĺŲ∂® Ļ”√∂ŗ…ŔłŲŌŖ≥Ő żļÕ∂‘”¶Ķń≤…ľĮľšłŰ°£

◊Ō»£¨–Ť“™–ī»’÷ĺ£ļ

logger.log(logging.DEBUG,

"PerfLog=QueryStart" )## Query Code

Goes Heredo_query_aws()##

Query

Completelogger.log(logging.DEBUG,

"PerfLog=QueryEnd,

Query Result) |

◊Ę“‚ Ļ”√Name=ValueĶń–ő ĹŅ…“‘įÔ÷ķSplunk‘ŕň—ňų Ī£¨ŐŠ»°“™∑÷őŲĶń◊÷∂ő°£

»Ľļů‘ň––≥Ő–Ú£¨≥Ő–Ú‘ň––“‘ļůĽŠ…ķ≥…»’÷ĺőńľĢ£¨į—ł√»’÷ĺőńľĢĶľ»ŽĶĹSplunk£¨Ņ™ ľ∑÷őŲ°£

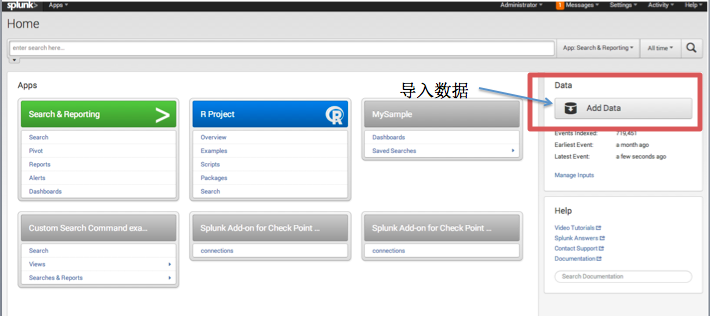

Ķ„ĽųAdd DataįīŇ•£¨»ĽļůłķňśSplunkĶń÷łĶľ£¨—°‘ŮA file or directory of files. Ķľ»Žń„Ķń»’÷ĺőńľĢ£¨Ķľ»ŽĻż≥Ő÷–£¨SplunkĽŠ“™«ůłÝń„Ķń»’÷ĺőńľĢ√Ł√Ż“ĽłŲsourcetype£¨ő“”√Ķń «°įcloud_watch_debug°Ī

Ķľ»Žļ√“‘ļůĺÕŅ…“‘Ņ™ ľň—ňųŃň°£

‘ŕň—ňųŅÚ÷– š»Ž

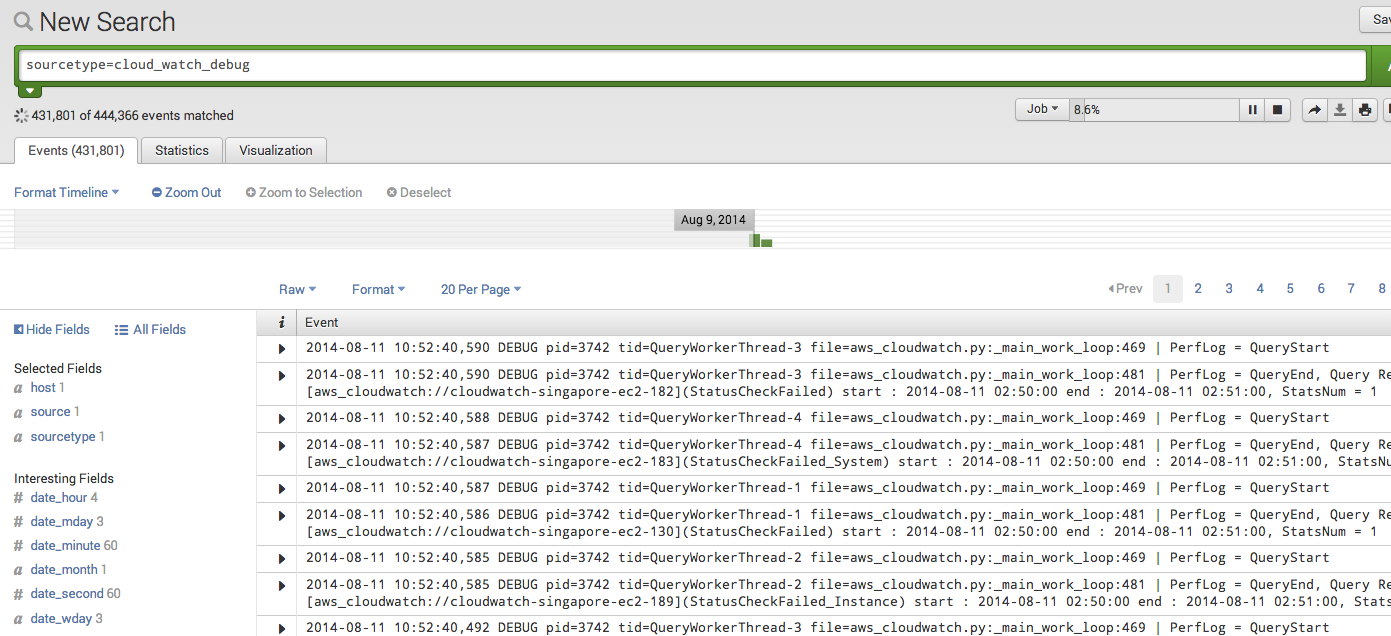

| sourcetype="cloud_watch_debug°Ī |

SplunkĽŠ Ķ ĪĶń∑ĶĽōňý”–Ķń»’÷ĺőńľĢ£¨≤Ęįī ĪľšĹ‚őŲő™“ĽłŲłŲĶń ¬ľĢ°£

SplunkĶńSPL£®Splunk Search Language£© «“ĽłŲņŗň∆SQLļÕUNIX CommandĶń◊ŘļŌŐŚ£¨Ņ…“‘∂‘ żĺ›ĹÝ––ň—ňų£¨∑÷őŲ£¨Õ≥ľ∆£¨…ķ≥…ÕľĪŪ£¨÷ß≥÷Ļ‹Ķņ£¨ Ļ”√∆ūņī∑«≥£∑ĹĪ„£¨Ĺ®“ťīůľ“Õ®ĻżĻŔ∑ĹőńĶĶņīŃňĹ‚°£

ő“√īĹŮŐž“™◊ŲĶń «–‘ń‹∑÷őŲ£¨ń«√īő“ĺÕ «“™Õ≥ľ∆“ĽŌ¬£¨∑ĘŃň∂ŗ…ŔłŲquery£¨√Ņ“ĽłŲquery”√Ńň∂ŗ…Ŕ Īľš°£

√Ņ“ĽŐű»’÷ĺĶńńŕ»›īů÷¬»ÁŌ¬

2014-08-11 10:52:40,587

DEBUG

pid=3742 tid=QueryWorkerThread-1

file=aws_cloudwatch.py:

_main_work_loop:469

| PerfLog = Qu |

Splunkń‹ĻĽŐŠ»°≥ŲīůŃŅĶń–ŇŌĘļÕ◊÷∂ő£®field£©£¨įŁņ® ¬ľĢ£¨pid£¨tid£¨fileĶ»Ķ»£¨ĽĻ”–ő“√«‘ŕ»’÷ĺ÷–ľ”»ŽĶń◊÷∂őPerfLog°£

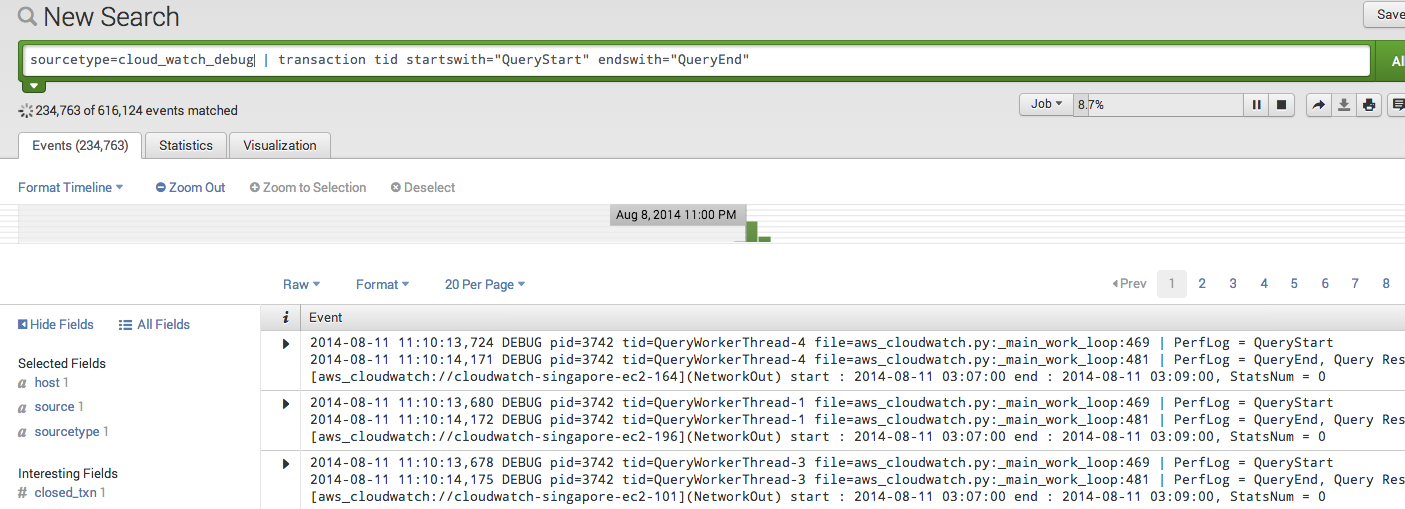

ŌŽ“™÷™Ķņ√Ņ“ĽłŲ≤ť—ĮňýĽ®∑—Ķń Īľš£¨Ņ…“‘Õ®ĻżSplunkŐŠĻ©Ķńtransaction√ŁŃÓ°£

sourcetype=cloud_watch_debug | transaction tid startswith="QueryStart" endswith="QueryEnd"

tidĪŪ ĺ√Ņ“ĽłŲtransaction–Ť“™”–ŌŗÕ¨Ķńtid£¨“≤ĺÕ «ňĶÕ¨“ĽłŲŌŖ≥Ő

startwithļÕendwithĪŪ ĺtransactionĶń∆š ĶļÕĹŠ ÝĪÍ÷ĺ

ł√√ŁŃÓ∑ĶĽōňý”–ĶńqueryĶńtransaction

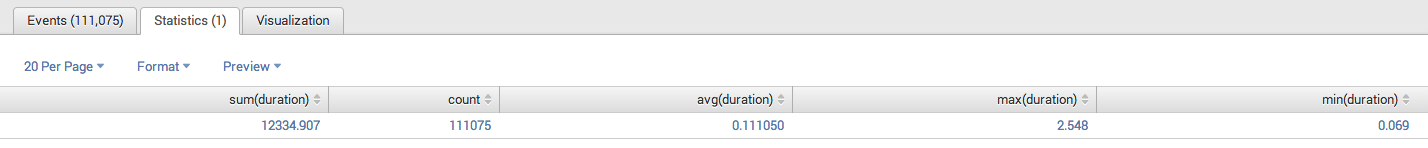

»Ľļůő“√«ĺÕŅ…“‘Õ≥ľ∆√Ņ“ĽłŲtransactionňý”√Ķń Īľš

sourcetype=cloud_watch_debug

|

transaction tid startswith="QueryStart"

endswith="QueryEnd"

| stats sum(duration),

count, avg(duration),max(duration),

min(duration) |

stats√ŁŃÓ”√”ŕ∂‘ żĺ›ĹÝ––Õ≥ľ∆

duration «Splunk∂‘transaction…ķ≥…Ķń ¬ľĢŅÁ∂»

sum,count,avg,max,min «Õ≥ľ∆√ŁŃÓ

‘ň––ĹŠĻŻ»ÁŌ¬£ļ

≥Ő–Ú“ĽĻ≤∑ĘňÕŃň111075łŲcloudwatchĶń«Ž«ů£¨◊Ó¬żĶń–Ť“™2.5√Ž£¨◊ÓŅžĶń0.06√Ž£¨∆ĹĺýīůłŇ0.11√Ž°£

ő“ĽĻŌŽ÷™ĶņqueryĶńļń Īňś ĪľšĶńĪšĽĮ£¨ő“Ņ…“‘…ķ≥…“ĽłŲtimechart

sourcetype=cloud_watch_debug

| transaction

tid startswith="QueryStart"

endswith="QueryEnd" |

timechart avg(duration) |

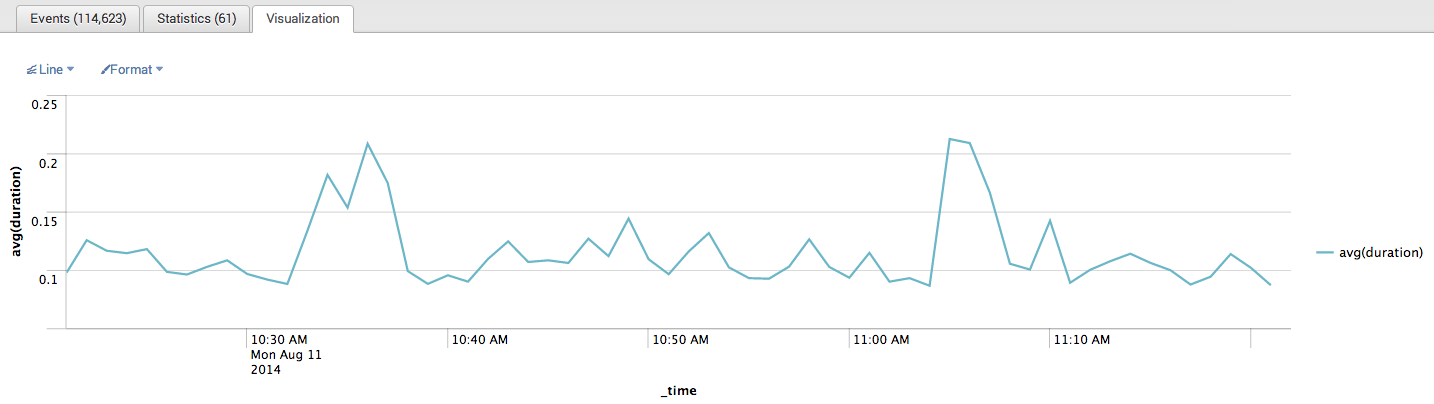

ĹŠĻŻ»ÁŌ¬£®◊ÓĹŁ1–° Ī£©£ļ

Õ®Ļżł√∑÷őŲ‘ŕĻż»•Ķń“ĽłŲ–° ĪņÔ10£ļ30ļÕ11£ļ00÷ģļůĶń ģ∑÷÷” Īľš∂ő£¨ļń Ī¬‘”–…Ō…ż£¨īůłŇ∑Ś÷Ķ0.2√Ž°£

◊‹ĹŠ£ļ

SplunkĶń»’÷ĺ∑÷őŲĻ¶ń‹∑«≥£«Ņīů£¨∂Ý«“500MĶń√‚∑—įśĽýĪĺń‹ĻĽ¬ķ◊„īů≤Ņ∑÷≥Ő–Ú‘Ī∂‘≥Ő–Ú»’÷ĺĶń∑÷őŲ“™«ů°£”––ßĶō Ļ”√SplunkņīĹÝ––»’÷ĺ∑÷őŲ£¨Ņ…“‘◊ŲĶĹ ¬įŽĻ¶Ī∂£¨–°ĽÔįť√«Ņžņī ‘”√į…£°

|