| БрМЭЦМі: |

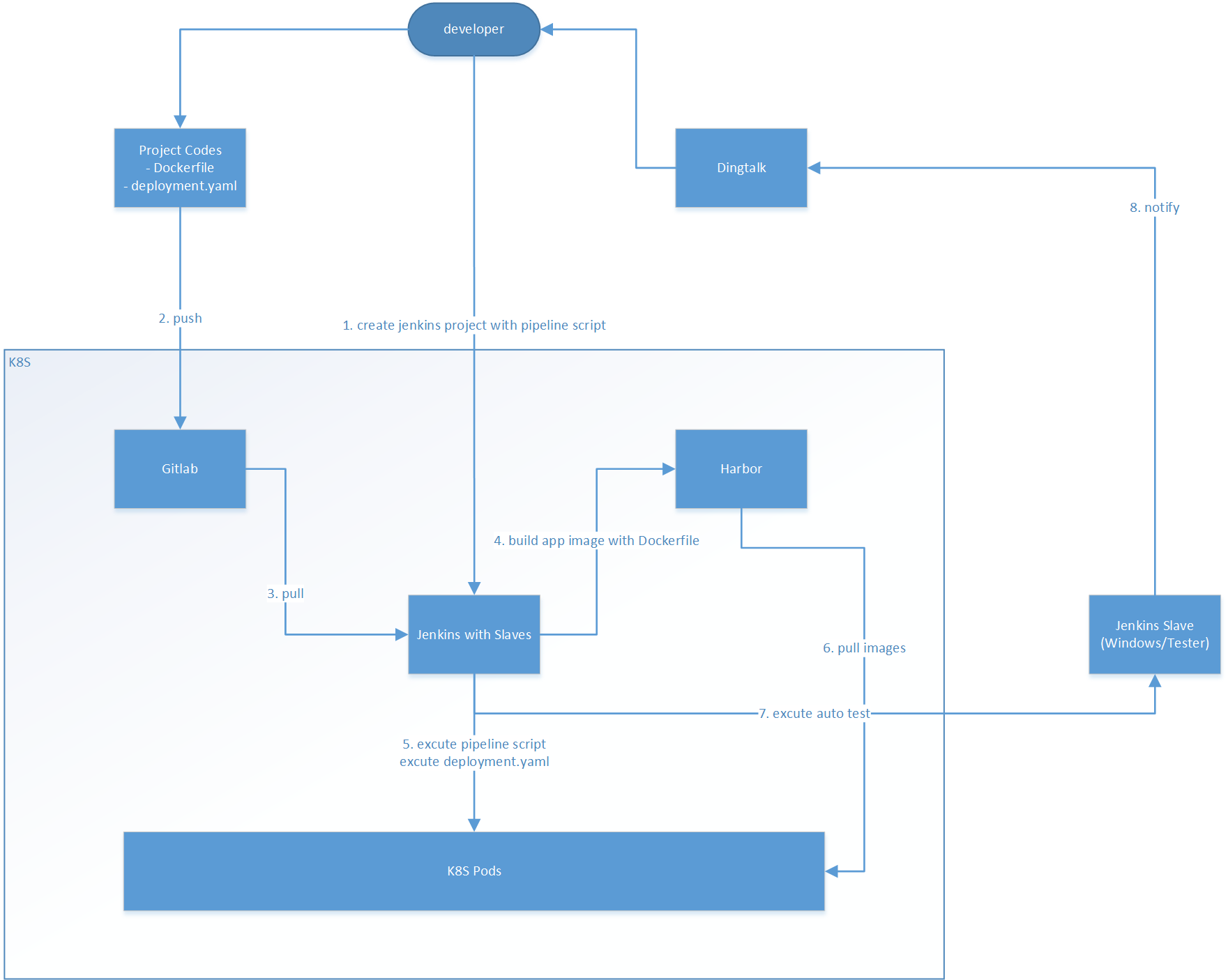

| БОЮФРДздгкдЦЩчЧј,БОЮФНЋЭЈЙ§ЪЕМЪАИР§ДЎСЊЫљгаЕФЛљДЁШэМўЗўЮёЃЌЛљгкK8SзіDevOpsЃЌЯЃЭћБОЮФЖдФњЕФбЇЯАгаЫљАяжњЁЃ |

|

ећЬхЕФвЕЮёСїГЬШчЯТЭМЫљЪОЃК

вЛЁЂвЛЛњЖрJenkins Slave

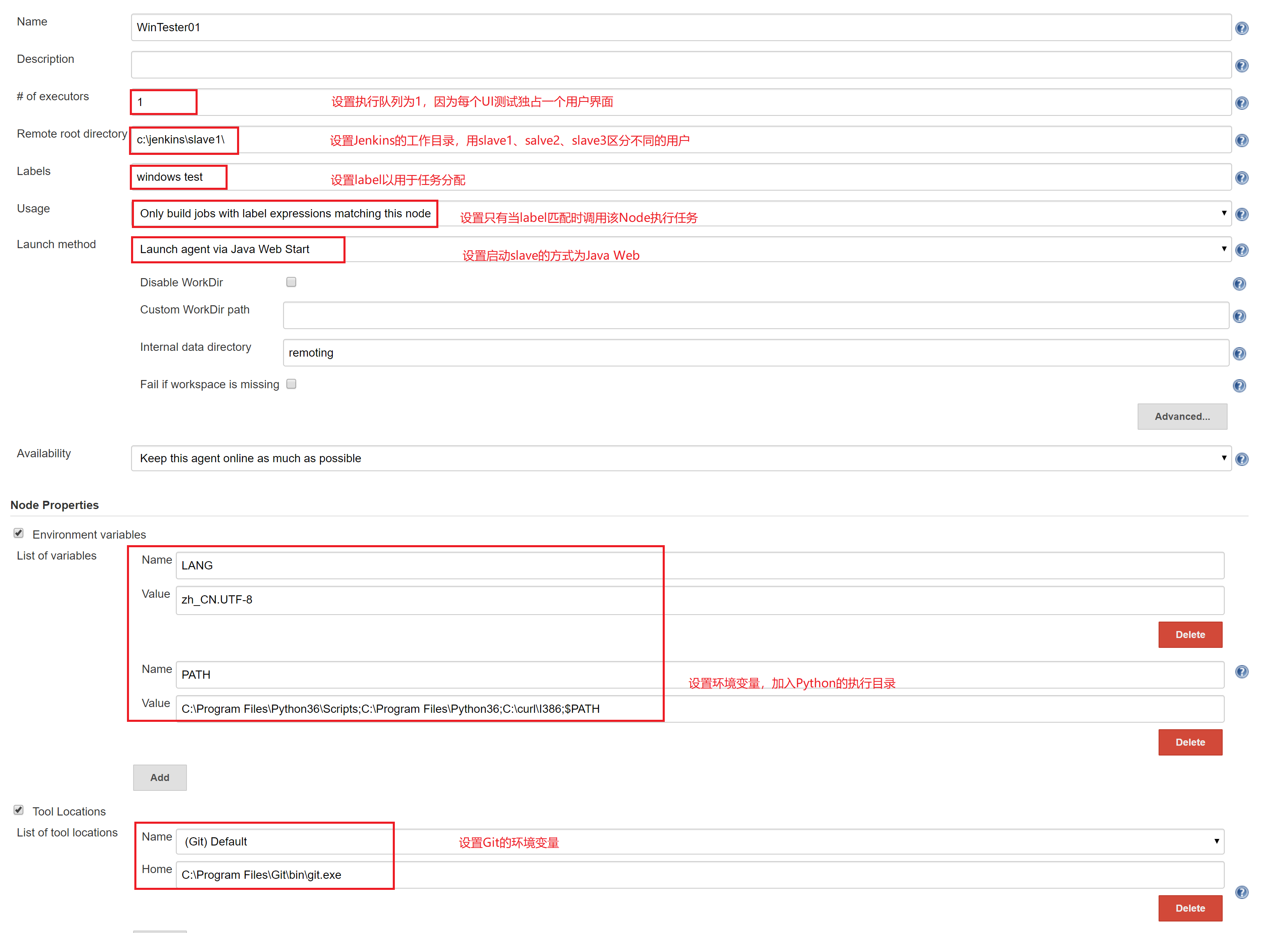

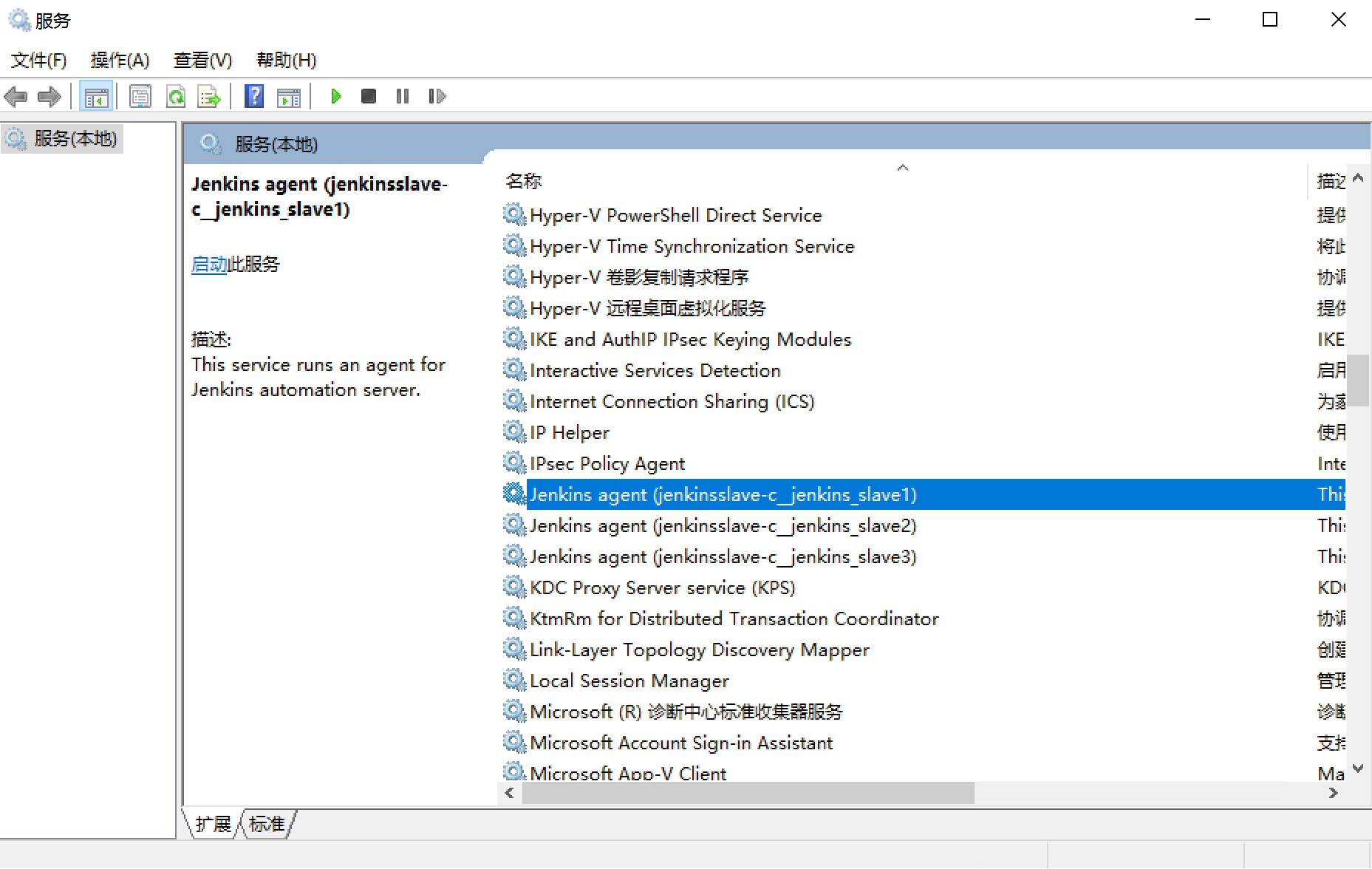

гЩгквЕЮёашвЊЃЌЮвУЧЕФздЖЏЛЏВтЪдашвЊЛљгкwindowsзіwebЙІФмВтЪдЃЌУПвЛИіВтЪдШЮЮёЖРеМвЛИіwindowsгУЛЇзРУцЃЌЫљвдЮвУЧЪзЯШвЊИјJenkinsХфжУМИИіWindowsЕФSlave

Node.дкЮвжЎЧАЕФpostЁЖГжајМЏГЩCIЪЕЪЉжИФЯШ§ЈCjenkinsМЏГЩВтЪдЁЗжаЯъЯИНВНтСЫИјJenkinsЬэМгNodeЕФЗНЗЈВНжшЁЃ

БОЦЊЮоашжиИДЃЌЕЋетРяжївЊНВЕФЪЧЃЌШчКЮдквЛЬЈWindowsЗўЮёЦїЩЯДюНЈЖрИіJenkins NodeЃЌЙЉЖргУЛЇЪЙгУЁЃ

дкФПБъЛњЩЯНЈСЂЖрИігУЛЇЃЌШчЯТЭМЫљЪОЃК

гУAdministratorгУЛЇАВзАJDK

дкJenkinsЕФНкЕуЙмРэНЈСЂШ§ИіNodeЃЌЗжБ№ЮЊWinTester01ЁЂWinTester02ЁЂWinTester03ЃЌХфжУШчЯТ

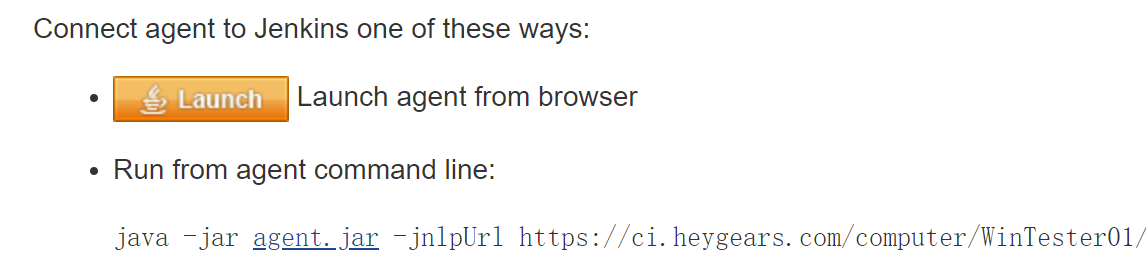

дкФПБъЛњЕФAdministratorЃЌгУIEДђПЊJenkinsВЂНјШыНкЕуЙмРэЃЌдк

WinTester01ЁЂWinTester02ЁЂWinTester03 жаЗжБ№ЕуЛїЁАLaunchЁБЦєЖЏSlave

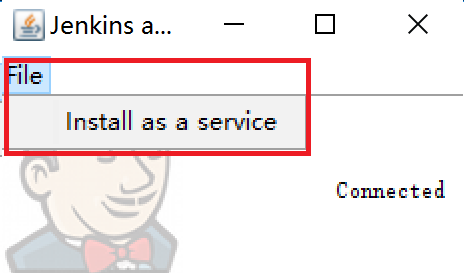

ШЗШЯЦєЖЏГЩЙІКѓЃЌЕуЛїЁАFileЁБЯТЕФЁАInstall as serviceЁБ

Ш§ИіSlaveЖМЦєЖЏКѓЃЌПЩвддкЗўЮёЙмРэЦїПДЕН

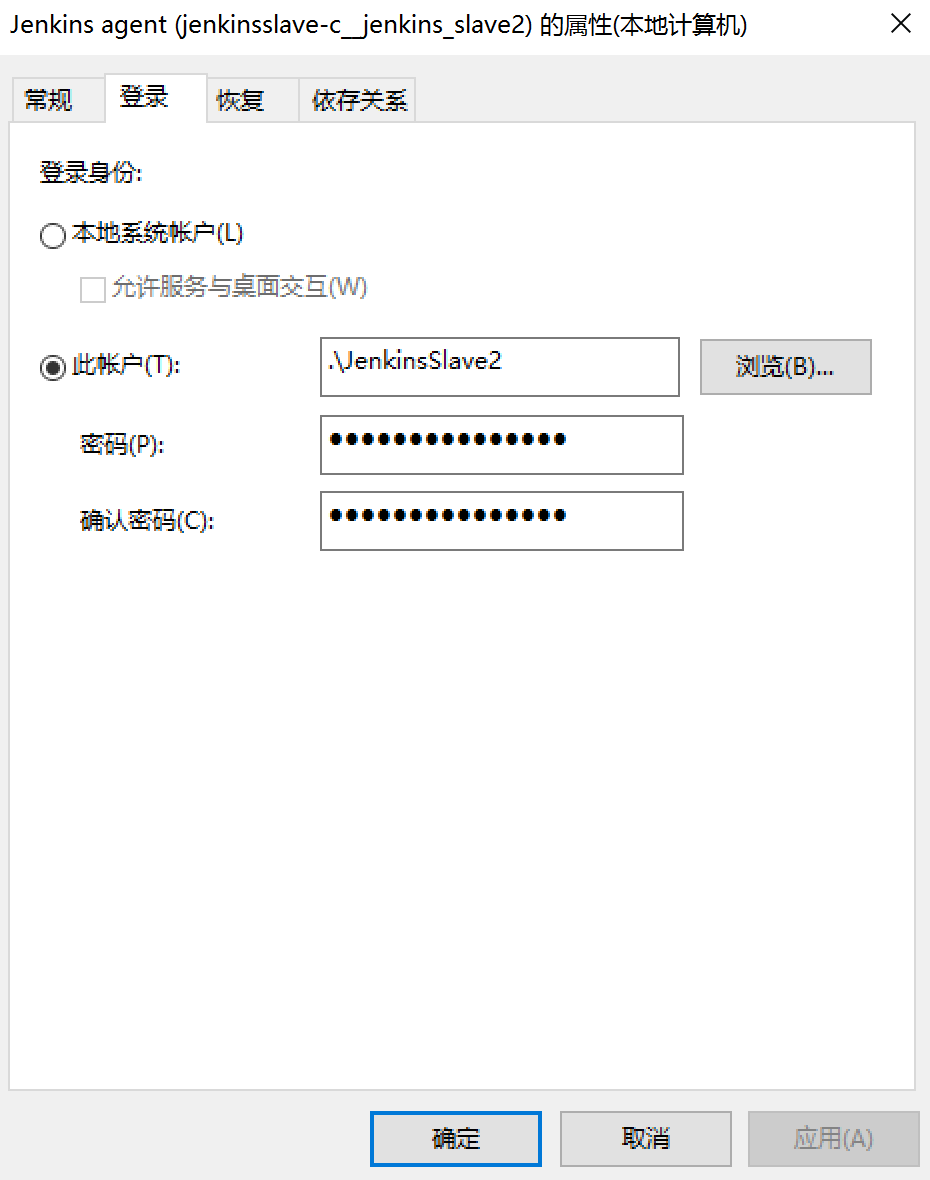

Г§СЫJenkins Slave1ЮоашХфжУЃЌSlave2КЭSlave3ЖМашвЊгвМќНјШыЪєадЃЌаоИФЕЧТМгУЛЇЗжБ№ЮЊJenkinsSlave2КЭJenkinsSlave3

ЭЈЙ§ЩЯУцЕФХфжУЃЌПЩвддквЛЬЈФПБъЛњВПЪ№Ш§ИігУЛЇЖдгІШ§ИіJenkins SlaveвдТњзуЮвУЧЕФвЕЮёашЧѓЁЃ

ЖўЁЂ ЖўДЮПЊЗЂJenkins ЖЄЖЄЭЈжЊВхМў

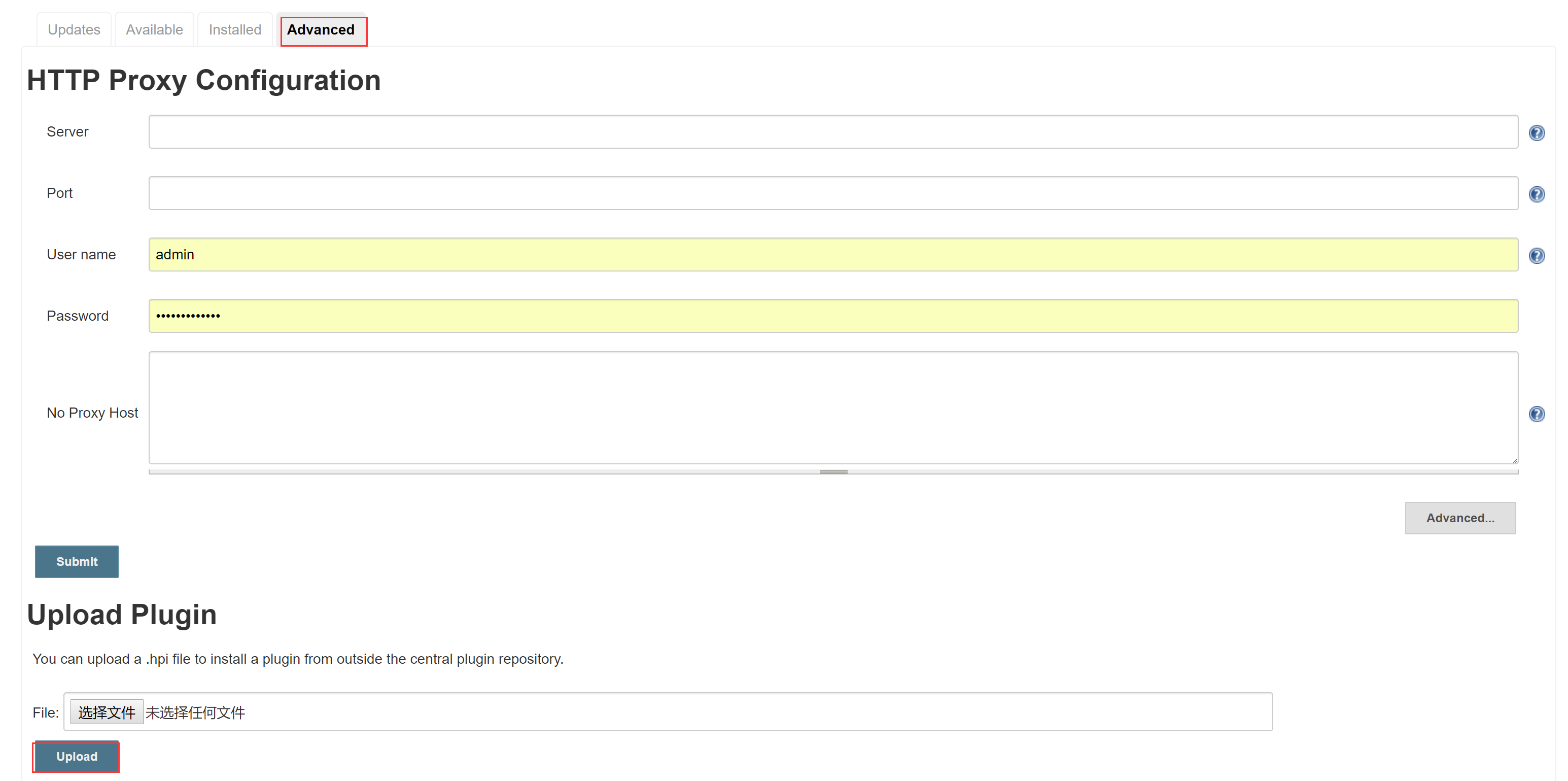

дкећИіDevOpsЕФвЕЮёСїГЬЭМЩЯЃЌЮвУЧЯыЪЙгУЖЄЖЄзїЮЊЭЈжЊЗНЪНЃЌЯрБШгЪМўЖјбдЃЌЪЕЪБадКЭРЉеЙадЖМКмИпЁЃдк2018Фъ4дТЃЌJenkinsЕФЖЄЖЄЭЈжЊВхМўгаСНПюЃЌЗжБ№ЪЧDingding

JSON PusherКЭDingding notification pluginЃЌЧАепГЄЦкЮДИќаТЃЌвбОВЛФмЪЙгУЃЌКѓепПЩвддкЗЧPipelineФЃЪНЯТЪЙгУЃЌЖдгкPipelineдђгавЛаЉЮЪЬтЁЃЫфШЛФПЧАЃЌDingding

notification pluginвбОИќаТЕН1.9АцБОВЂжЇГжСЫPipelineЃЌЕЋдкЕБЪБЃЌЮвУЧВЛЕУВЛдк1.4АцБОЕФЛљДЁЩЯзіЖўДЮПЊЗЂЁЃ

ећЬхПЊЗЂОЙ§ВЮПМЁЖJenkinsЯюФПЪЕеНжЎ-ЖЄЖЄЬсабВхМўЖўДЮПЊЗЂОйР§ЁЗЃЌзмЬхРДЫЕЛЙЪЧБШНЯМђЕЅЃК

аоИФЁБsrc/main/java/com/ztbsuper/dingtalk

/ DingTalkNotifier . java ЁБЃЌЖЄЖЄЕФЯћЯЂAPIРраЭгаЮФБОЁЂlinkЁЂmarkdownЁЂcardЕШЃЌЮвУЧетРяАбЭЈжЊНгПкИФГЩЮФБОРраЭ

public class

DingTalkNotifier extends Notifier implements SimpleBuildStep

{

?

private String accessToken;

private String message;

private String imageUrl;

private String messageUrl;

?

@DataBoundConstructor

public DingTalkNotifier(String accessToken, String

message, String imageUrl, String messageUrl) {

this.accessToken = accessToken; //ЖЄЖЄЕФaccesstoken

this.message = message; //ЯћЯЂжїЬх

this.imageUrl = imageUrl; //ЫѕТдЭМ

this.messageUrl = messageUrl; //ЯћЯЂЕФСДНгРДдДЃЌвЛАуЪЧjenkinsЕФbuild

url

}

?

public String getAccessToken() {

return accessToken;

}

public String getMessage() {

return message;

}

public String getImageUrl() {

return imageUrl;

}

public String getMessageUrl() {

return messageUrl;

}

?

@Override

public void perform(@Nonnull Run<?, ?> run,

@Nonnull FilePath filePath, @Nonnull Launcher

launcher, @Nonnull TaskListener taskListener)

throws InterruptedException, IOException {

String buildInfo = run.getFullDisplayName();

if (!StringUtils.isBlank(message)) {

sendMessage(LinkMessage.builder()

.title(buildInfo)

.picUrl(imageUrl)

.text(message)

.messageUrl(messageUrl)

.build());

}

}

?

private void sendMessage(DingMessage message)

{

DingTalkClient dingTalkClient = DingTalkClient.getInstance();

try {

dingTalkClient.sendMessage(accessToken, message);

} catch (IOException e) {

e.printStackTrace();

}

}

?

@Override

public BuildStepMonitor getRequiredMonitorService()

{

return BuildStepMonitor.NONE;

}

?

@Symbol("dingTalk")

@Extension

public static final class DescriptorImpl extends

BuildStepDescriptor<Publisher> {

?

@Override

public boolean isApplicable(Class<? extends

AbstractProject> aClass) {

return true;

}

?

@Nonnull

@Override

public String getDisplayName() {

return Messages.DingTalkNotifier_DescriptorImpl_DisplayName();

}

}

} |

гУmavenДђАќ

mavenашвЊАВзАjavaЛЗОГЃЌЮЊСЫЗНБуЃЌЮвжБНгrunвЛИіmavenЕФdocker imageЃЌБрвыЭъГЩКѓАбhpiЮФМўsendГіРД

дкjenkinsЕФВхМўЙмРэвГУцЩЯДЋhpiЮФМў

дкЖЄЖЄШКжаПЊЦєздЖЈвхЛњЦїШЫ

евЕНaccesstoken

дкjenkins pipelineжаПЩвдЪЙгУвдЯТУќСюЗЂЫЭаХЯЂЕНЖЄЖЄШК

| dingTalk accessToken:"2fccafaexxxx",message:"аХЯЂ",imageUrl:"ЭМЦЌЕижЗ",messageUrl:"ЯћЯЂСДНг"

|

Ш§ЁЂ DevOpsНтОіЗНАИ

еыЖдУПвЛИіШэМўЯюФПдіМгВПЪ№ФПТМЃЌФПТМНсЙЙШчЯТЃК

_deploy

master

deployment.yaml

Dockerfile

other files

test

deployment.yaml

Dockerfile

other files

|

masterКЭtestЮФМўМагУгкЧјЗжВтЪдЛЗОГгыЩњВњЛЗОГЕФВПЪ№ХфжУ

DockerfileКЭother filesгУгкЩњГЩгІгУЛђЗўЮёЕФОЕЯё

ШчЧАЖЫvueКЭnodejsЯюФПЕФDockerfileЃК

# ЧАЖЫЯюФПдЫааЛЗОГЕФImageЃЌДгHarborЛёШЁ

FROM xxx/xxx/frontend:1.0.0

RUN mkdir -p /workspace/build && mkdir

-p /workspace/run

COPY . /workspace/build

# БрвыЃЌЩњГЩжДааЮФМўЃЌВЂЩОГ§дДЮФМў

RUN cd /workspace/build/frontend && \

cnpm install && \

npm run test && \

cp -r /workspace/build/app/* /workspace/run &&

\

rm -rf /workspace/build && \

cd /workspace/run && \

cnpm install

# дЫааЯюФПЃЌгУnpm run testЛђrun prodЧјЗжВтЪдКЭЩњВњЛЗОГ

CMD cd /workspace/run && npm run test

|

гжШчdotnet coreЯюФПЕФDockerfileЃК

# dotnetЯюФПБрвыЛЗОГЕФImageЃЌДгHarborЛёШЁ

FROM xxx/xxx/aspnetcore-build:2 AS builder

WORKDIR /app

COPY . .

# Брвы

RUN cd /app/xxx

RUN pwd && ls -al && dotnet restore

RUN dotnet publish -c Release -o publish

?

# dotnetЯюФПдЫааЛЗОГЕФImageЃЌДгHarborЛёШЁ

FROM xxx/xxx/aspnetcore:2

WORKDIR /publish

COPY --from=builder /app/xxx/publish .

# жиУќУћХфжУЮФМўЃЌжазКtestЁЂprodгУгкЧјЗжВтЪдЛЗОГКЭЩњВњЛЗОГ

RUN mv appsettings.test.json appsettings.json

# дЫаа

ENTRYPOINT ["dotnet", "xxx.dll"]

|

deployent.yamlгУгкжДаагІгУЛђЗўЮёдкk8sЩЯЕФВПЪ№

гЩгкdeploymentгаКмЖрХфжУЯюПЩвдГщРыГЩЙЋЙВХфжУЃЌЫљвдdeploymentЕФХфжУгаКмЖреМЮЛБфСПЃЌеМЮЛБфСПгУСНИі#жаМфМгБфСПУћБэЪОЃЌШчЯТЫљЪОЃК

apiVersion: v1

kind: Namespace

metadata:

name: #namespace#

labels:

name: #namespace#

---

apiVersion: v1

data:

.dockerconfigjson: xxxxxxxxxxxxxxxxxxxxxx

kind: Secret

metadata:

name: regcred

namespace: #namespace#

type: kubernetes.io/dockerconfigjson

---

apiVersion: extensions/v1beta1

kind: Deployment

metadata:

name: #app#-deploy

namespace: #namespace#

labels:

app: #app#-deploy

spec:

replicas: #replicas#

strategy:

type: Recreate

template:

metadata:

labels:

app: #app#

spec:

containers:

- image: #image#

name: #app#

ports:

- containerPort: #port#

name: #app#

securityContext:

privileged: #privileged#

volumeMounts:

- name: log-volume

mountPath: #log#

- image: #filebeatImage#

name: filebeat

args: [

"-c", "/etc/filebeat.yml"

]

securityContext:

runAsUser: 0

volumeMounts:

- name: config

mountPath: /etc/filebeat.yml

readOnly: true

subPath: filebeat.yml

- name: log-volume

mountPath: /var/log/container/

volumes:

- name: config

configMap:

defaultMode: 0600

name: filebeat-config

- name: log-volume

emptyDir: {}

imagePullSecrets:

- name: regcred

---

apiVersion: v1

kind: ConfigMap

metadata:

name: filebeat-config

namespace: #namespace#

labels:

app: filebeat

data:

filebeat.yml: |-

filebeat.inputs:

- type: log

enabled: true

paths:

- /var/log/container/*.log

output.elasticsearch:

hosts: ["#es#"]

tags: ["#namespace#-#app#"]

---

apiVersion: v1

kind: Service

metadata:

name: #app#-service

namespace: #namespace#

labels:

app: #app#-service

spec:

ports:

- port: 80

targetPort: #port#

selector:

app: #app#

---

apiVersion: extensions/v1beta1

kind: Ingress

metadata:

name: #app#-ingress

namespace: #namespace#

annotations:

nginx.ingress.kubernetes.io/proxy-body-size: "0"

nginx.ingress.kubernetes.io/rewrite-target: /

spec:

rules:

- host: #host#

http:

paths:

- path: #urlPath#

backend:

serviceName: #app#-service

servicePort: 80 |

ЦфжаМИИіЙиМќБфСПЕФНтЪЭШчЯТЃК

dockerconfigjsonЃКвђЮЊЫљгаЕФОЕЯёашвЊДгHarborЛёШЁЃЌЖјHarborЕФОЕЯёШчЙћЩшжУЮЊЫНгаШЈЯоЃЌОЭашвЊЬсЙЉЩэЗнбщжЄЃЌетРяЕФ

dockerconfigjson ОЭЪЧHarborЕФЩэЗнаХЯЂЁЃЩњГЩdockerconfigjsonЕФЗНЗЈШчЯТЃК

НјШыK8SШЮКЮвЛИіНкЕуЃЌЩОГ§ЁБ ~/.docker/config.json ЁБ ЮФМў

ЪЙгУУќСюЁБ docker login harborЕижЗЁБЕЧТМharbor

ЭЈЙ§УќСюЁБ cat ~/.docker/config.json ЁА

ПЩвдПДЕНharborЕФЩэЗнбщжЄаХЯЂ

ЪЙгУУќСюЁБ cat /root/.docker/config.json | base64 -w 0

ЁАЖдаХЯЂБрТыЃЌНЋЩњГЩКѓЕФБрТыЬюаДЕНdeployment.yamlЕФdockerconfigjsonНкЕуМДПЩ

namespaceЃКЭЌвЛИіЯюФПЕФВЛЭЌk8sзщМўгІжУгкЭЌвЛИіnamespaceЃЌЫљвдnamespaceПЩЭГвЛХфжУЃЌдкЮвУЧЕФЯюФПЪЕМљжаЃЌЩњВњЛЗОГЕФnamespaceЮЊЁБ

ЯюФПУћ ЁАЃЌВтЪдЛЗОГЕФnamespaceЮЊЁБ ЯюФПУћ-test ЁА

appЃКгІгУЛђЗўЮёУћГЦ

imageЃКгІгУЛђЗўЮёЕФОЕЯёЕижЗ

replicasЃКИББОЪ§СП

portЃКгІгУЛђЗўЮёЕФPodПЊЗХЖЫПк

logЃКгІгУЛђЗўЮёЕФШежОТЗОЖЃЌдкБОЯЕСаЕФЕкЖўЦЊЮФеТжаЃЌЬсЕНЮвУЧЕФШежОЗНАИЪЧИјУПИігІгУЛђЗўЮёХфвЛИіfilebeatЃЌЗХдкЭЌвЛPodжаЃЌетРяжЛашИцжЊгІгУЛђЗўЮёЕФШежОЕФОјЖдТЗОЖЃЌfilebeatОЭФмНЋШежОДЋЕнЕНESжаЃЌШежОЕФtagУќУћЗНЪНЮЊЁБ

namespace-appЁБ

hostЃКдкБОЯЕСаЕФЕквЛЦЊЮФеТжаЃЌНВСЫЪЙгУnginx ingressзіЗўЮёБЉТЖгыИКдиЁЃетРяЕФhostОЭЪЧИјnginx

ingress ЩшжУЕФгђУћЃЌЖЫПкФЌШЯЖМЪЧ80ЃЌШчЙћашвЊhttpsЃЌдђдкЭтВуЪЙгУАЂРядЦSLBзЊЗЂ

urlPathЃККмЖрЧщПіЯТЃЌШчЮЂЗўЮёЃЌашвЊЭЈЙ§ЯрЭЌЕФгђУћЃЌВЛЭЌЕФвЛМЖФПТМНЋЧыЧѓЗжЗЂЕНВЛЭЌЕФКѓЬЈЃЌдкnginxжаЃЌОЭЪЧlocationЕФХфжУгыЗДЯђДњРэЃЌБШШчhostЕФХфжУЪЧШЗЖЈСЫгђУћaaa.bbb.comЃЌЖјurlPathЕФХфжУЪЧШЗЖЈ

aaa .bbb.com/user /getuser НЋЛсБЛзЊЗЂЕНгУЛЇЗўЮё podIP:podPort

/ getuserжа

вдЩЯЫљгаЕФеМЮЛБфСПЖМЪЧдкPipeline ScriptжаИГжЕЃЌЙигк

Jenkins Pipeline ЕФЯрЙиФкШнНщЩметРяВЛдйЖрНВЃЌЛЙЪЧШЅПДЙйЗНЮФЕЕППЦзЁЃЮвУЧетРяНЋk8sЕФВПЪ№ЮФМўdeployment.yamlгыJenkinsfileНсКЯЃЌМДПЩзіЕНвЛИіdeployment.yamlФмЪЪХфЫљгаЯюФПЃЌвЛИіPipeline

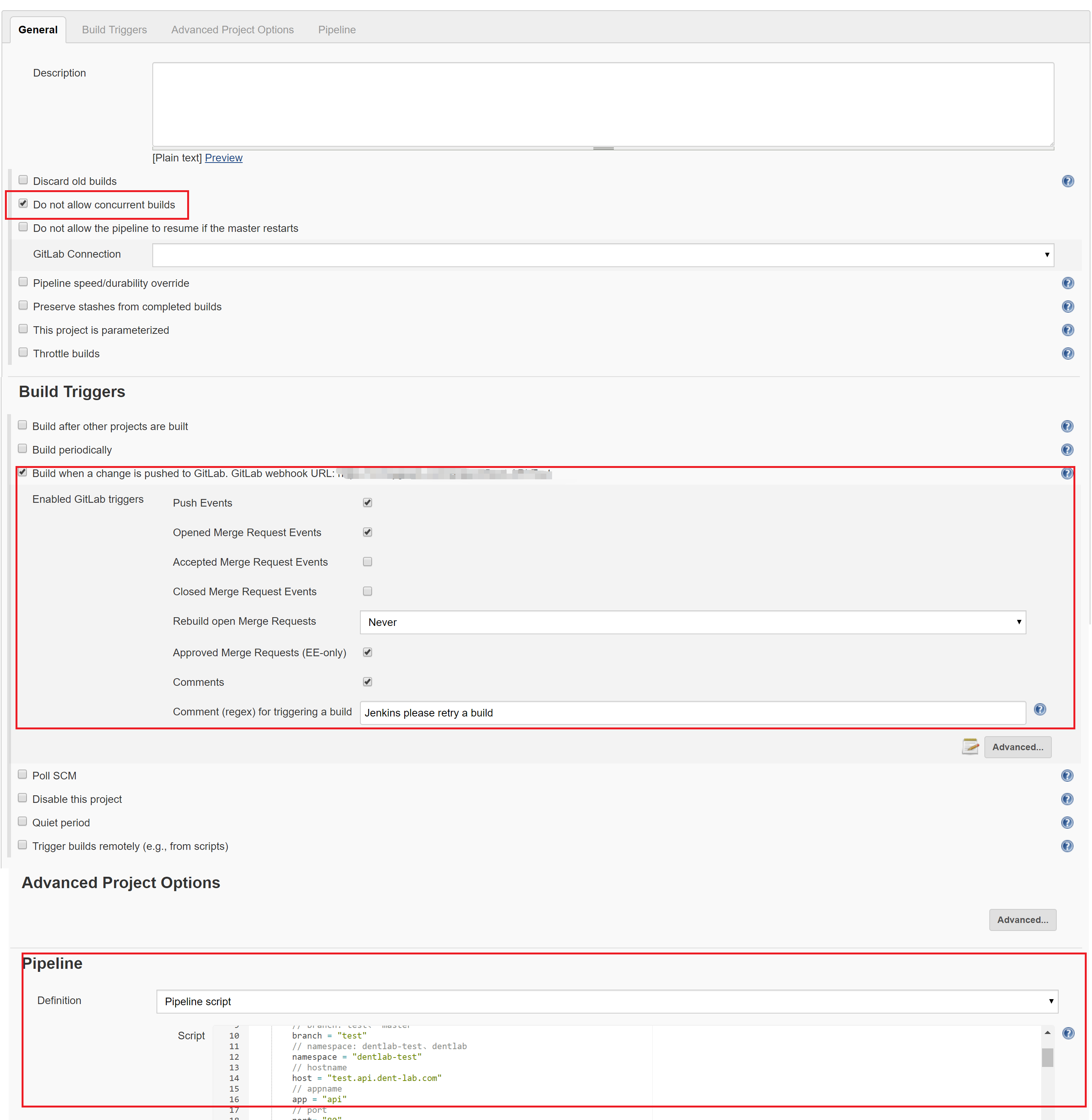

ScriptФЃАхФмЪЪХфЫљгаЯюФПЃЌеыЖдВЛЭЌЕФЯюФПЃЌжЛашдкPipeline ScriptжаИјеМЮЛБфСПИГжЕЃЌДѓДѓНЕЕЭСЫХфжУИДдгЖШЁЃЯТУцЪЧвЛИіЯюФПЕФJenkinsХфжУЪОР§ЃК

ЖдгквЛИіЯюФПЃЌЮвУЧжЛашХфжУTriggerКЭPipelineЃЌЩЯЭМЁАDo not allow concurrent

builds ЁБвВЪЧЭЈЙ§PipelineЕФХфжУЩњГЩЕФЁЃPipeline ScriptЪОР§ШчЯТЃК

pipeline {

// жИЖЈЯюФПдкlabelЮЊjnlp-agentЕФНкЕуЩЯЙЙНЈЃЌ

вВОЭЪЧJenkins Slave in Pod

agent { label 'jnlp-agent' }

// ЖдгІDo not allow concurrent builds

options {

disableConcurrentBuilds()

}

environment {

// ------ вдЯТФкШнЃЌУПИіЯюФППЩФмОљгаВЛЭЌЃЌАДашаоИФ

------

//authorЃКгУгкЖЄЖЄЭЈжЊ

author="еХШ§"

// branch: ЗжжЇЃЌвЛАуЪЧtestЁЂ masterЃЌЖдгІgitДгФФИі

ЗжжЇРШЁДњТыЃЌвВЖдгІОПОЙжДаа_deployЮФМўМаЯТЕФtest

ХфжУЛЙЪЧmasterХфжУ

branch = "test"

// namespace: myproject-test, myprojectЃЌУќУћПеМфвЛ

АуЪЧЯюФПУћГЦЃЌ

ВтЪдЛЗОГМгtest

namespace = "myproject-test"

// hostnameЃКЖдгІdeploymentжаЕФhost

host = "test.aaa.bbb.com"

// appnameЃКЖдгІdeploymentжаЕФapp

app = "myserver"

// portЃКЖдгІdeploymentжаЕФport

port= "80"

// replicasЃКЖдгІdeploymentжаЕФreplicas

replicas = 2

//git repo pathЃКgitЕФЕижЗ

git="git@git.aaa.bbb.com/xxx.git"

//logЃКЖдгІdeploymentжаЕФlog

log="/publish/logs/"

// ------ вдЯТФкШнЃЌвЛАуЫљгаЕФЯюФПЖМвЛбљЃЌВЛОГЃаоИФ

------

// harbor inner address

repoHost = "192.168.0.1:23280"

// harborЕФеЫКХУмТыаХЯЂЃЌдкjenkinsжаХфжУгУЛЇУћ

/УмТыаЮЪНЕФШЯжЄаХЯЂЃЌУќУћГЩharborМДПЩ

harborCreds = credentials('harbor')

// filebeatЕФОЕЯёЕижЗ

filebeatImage="${repoHost}/common/filebeat:6.3.1"

// esЕФФкЭјЗУЮЪЕижЗ

es="elasticsearch-logging.kube-system:9200"

}

// ------ вдЯТФкШнЮоашаоИФ ------

stages {

// ПЊЪМЙЙНЈЧАЧхПеЙЄзїФПТМ

stage ("CleanWS"){

steps {

script {

try{

deleteDir()

}catch(err){

echo "${err}"

sh 'exit 1'

}

}

}

}

// РШЁ

stage ("CheckOut"){

steps {

script {

try{

checkout([$class: 'GitSCM', branches: [[name:

"*/${branch}"]], doGenerateSubmoduleConfigurations:

false, extensions: [],

submoduleCfg: [], userRemoteConfigs: [[credentialsId:

'gitlab', url: "${git}"]]])

}catch(err){

echo "${err}"

sh 'exit 1'

}

}

}

}

// ЙЙНЈ

stage ("Build"){

steps {

script {

try{

// ЕЧТМ harbor

sh "docker login -u ${harborCreds_USR}

-p ${harborCreds_PSW}

${repoHost}"

sh "date +%Y%m%d%H%m%S > timestamp"

// ОЕЯёtagгУЪБМфДСДњБэ

tag = readFile('timestamp').replace("\n",

"").replace

("\r", "")

repoPath = "${repoHost}/${namespace}/${app}:${tag}"

// ИљОнЗжжЇЃЌНјШы_deployЯТЖдгІЕФВЛЭЌЮФМўМаЃЌЭЈЙ§dockerfileДђАќОЕЯё

sh "cp _deploy/${branch}/* ./"

sh "docker login -u ${harborCreds_USR}

-p ${harborCreds_PSW}

${repoHost}"

sh "docker build -t ${repoPath} ."

}catch(err){

echo "${err}"

sh 'exit 1'

}

}

}

}

// ОЕЯёЭЦЫЭЕНharbor

stage ("Push"){

steps {

script {

try{

sh "docker push ${repoPath}"

}catch(err){

echo "${err}"

sh 'exit 1'

}

}

}

}

// ЪЙгУpipeline scriptжаИДжЦЕФБфСПЬцЛЛdeployment.yaml

жаЕФеМЮЛБфСПЃЌжДааdeployment.yamlНјааВПЪ№

stage ("Deploy"){

steps {

script {

try{

sh "sed -i 's|#namespace#|${namespace}|g'

deployment

.yaml"

sh "sed -i 's|#app#|${app}|g' deployment.yaml"

sh "sed -i 's|#image#|${repoPath}|g' deployment.yaml"

sh "sed -i 's|#port#|${port}|g' deployment.yaml"

sh "sed -i 's|#host#|${host}|g' deployment.yaml"

sh "sed -i 's|#replicas#|${replicas}|g'

deployment

.yaml"

sh "sed -i 's|#log#|${log}|g' deployment.yaml"

sh "sed -i 's|#filebeatImage#|${filebeatImage}|g'

deployment.yaml"

sh "sed -i 's|#es#|${es}|g' deployment.yaml"

sh "sed -i 's|#redisImage#|${redisImage}|g'

deployment.yaml"

sh "cat deployment.yaml"

sh "kubectl apply -f deployment.yaml"

}catch(err){

echo "${err}"

sh 'exit 1'

}

}

}

}

}

post {

// ЪЙгУЖЄЖЄВхМўНјааЭЈжЊ

always {

script {

def msg = "ЁО${author}ЁПФуАбЗўЮёЦїИуЙвСЫЃЌ

РЯеВКАФуЛиМвИФBUGЃЁ"

def imageUrl = "https://www.iconsdb.com/icons/

preview/red

/x-mark-3-xxl-2.png"

if (currentBuild.currentResult=="SUCCESS"){

imageUrl= "http://icons.iconarchive.com/icons/paomedia

/small-n-flat/1024/sign-check-icon-2.png"

msg ="ЁО${author}ЁПЗЂВМГЩЙІЃЌИЩЕУВЛДэЃЁ"

}

dingTalk accessToken:"xxxx",message:"${msg}",imageUrl:"$

{imageUrl}",

messageUrl:"${BUILD_URL}"

}

}

}

} |

ЗЂВМЭъГЩКѓЃЌПЩвдВЮПМЁЖГжајМЏГЩCIЪЕЪЉжИФЯШ§ЈCjenkinsМЏГЩВтЪдЁЗЃЌзіГжајВтЪдЃЌВтЪдНсЙћвВПЩЭЈЙ§ЖЄЖЄЭЈжЊЁЃзюКѓЮвУЧРћгУздНЈЕФдЫЮЌЦНЬЈЃЌМрПиАЂРядЦECSзДЬЌЁЂK8SИїзщМўзДЬЌЁЂМрПиESжаЕФШежОВЂзівьГЃзЅШЁКЭБЈОЏЁЃаЮГЩвЛећЬзDevOpsФЃЪНЁЃ

злЩЯЃЌЖдгкУПИіЯюФПЃЌЮвУЧжЛашЮЌЛЄDockerfileЃЌВЂдкJenkinsДДНЈГжајМЏГЩЯюФПЪБЃЌЬюаДЯюФПЫљашЕФВЮЪ§БфСПЁЃНјНзЧщПіЯТЃЌвВПЩЖЈжЦадЕФаоИФdeploymentЮФМўгыpipeline

scriptЃЌТњзуВЛЭЌЕФвЕЮёашвЊЁЃжСДЫЃЌЭъНсЃЌШіЛЈЃЁ

|