| БрМЭЦМі: |

БОЮФжївЊНщЩмСЫ ЪЙгУTensorBoardеЙЪОЪ§Он,НЋИїжжРраЭЕФЪ§ОнЛузмВЂМЧТМЕНШежОЮФМўжа,зюКѓНЋМЦЫуЭМжаЕФЭМБъНјаазмНс.ЯЃЭћЖдФњЕФбЇЯАгаЫљАяжњЁЃ

БОЮФРДздгкCSDNЃЌгЩЛ№СњЙћШэМўAliceБрМЁЂЭЦМіЁЃ

|

|

TensorBoardЪЧTensorflowЕФПЩЪгЛЏЙЄОпЃЌЫќЭЈЙ§ЖдTensoflowГЬађдЫааЙ§ГЬжаЪфГіЕФШежОЮФМўНјааПЩЪгЛЏTensorflowГЬађЕФдЫаазДЬЌЁЃ

ЪЙгУTensorBoardеЙЪОЪ§ОнЃЌашвЊдкжДааTensorflowМЦЫуЭМЕФЙ§ГЬжаЃЌНЋИїжжРраЭЕФЪ§ОнЃЈsummary

protobufЃЉЛузмВЂМЧТМЕНШежОЮФМўжаЁЃШЛКѓЪЙгУTensorBoardЖСШЁетаЉШежОЮФМўЃЌНтЮіЪ§ОнВЂЩњВњЪ§ОнПЩЪгЛЏЕФWebвГУцЃЌШУЮвУЧПЩвддкфЏРРЦїжаЙлВьИїжжЛузмЪ§ОнЁЃ

зЂЃКtensorflow --version 1.4.0

TensorBoard

ЕБЩњГЩСЫШежОЮФМўКѓЃЌдкУќСюаажаЪЙгУtensorboard --logdir=ШежОЮФМўФПТМЦєЖЏвЛИіЗўЮёЃЌдкфЏРРЦїжаЪЙгУhttp://DESKTOP-JGL4HV5:6006ВщПДПЩЪгЛЏНсЙћЁЃ

етРягавЛЕуашвЊзЂвтЃЌШежОЮФМўФПТМвЊЪЙгУОјЖдТЗОЖЃЌМДДгФГИіХЬПЊЪМЕФТЗОЖЃЈШчЙћВЛааЕФЛАНЋ/БфГЩ//дйЪдЪдЃЉЁЃЭЌЪБЪЙгУ360фЏРРЦїПЩФмЮоЗЈЯдЪОЁЃ

ЯТУцКьПђжаЪЧПЩЪгЛЏЕФЖЅВПЃК

TensorBoardвГУц

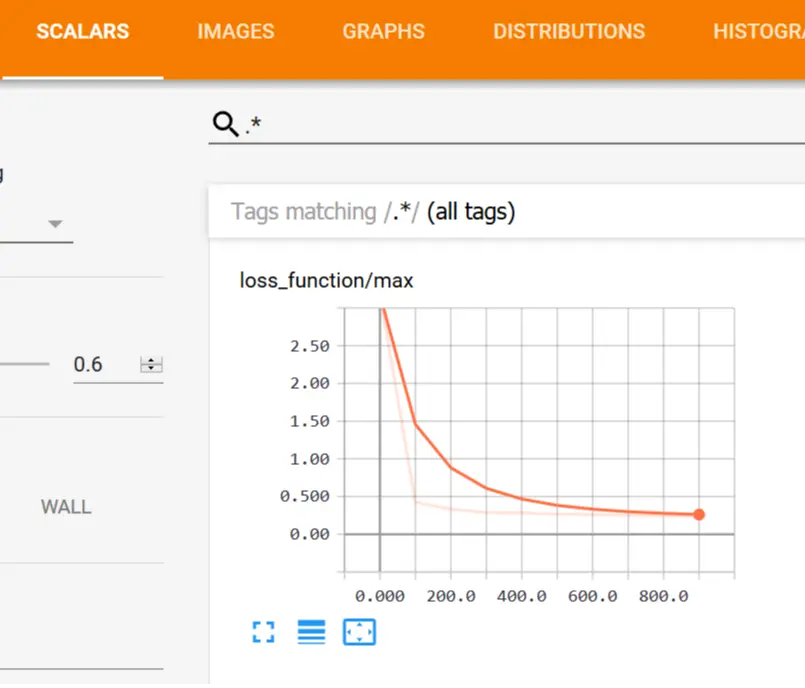

SCALARSЃЌЖдБъСПЪ§ОнНјааЛузмКЭМЧТМ

ЪЙгУЗНЗЈЃКtf.summary.scalar(tags, values,

collections=None, name=None)

scalar

вЛАудкПЬЛlossКЭaccuracyЪБЛсгУЕНЃЌПЩвдМЦЫуБъСПЕФзюДѓзюаЁжЕЛђепБъзМВюЕШ

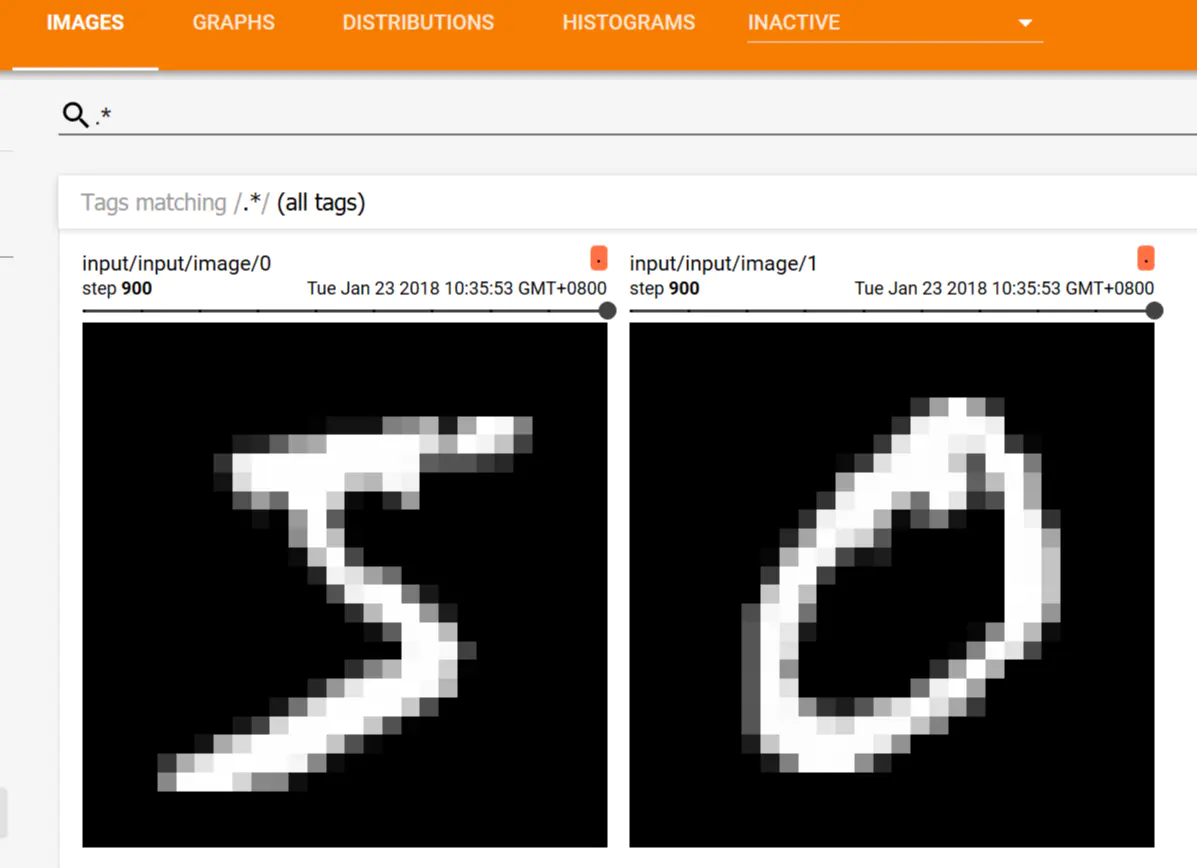

IMAGESЃЌ ЛузмЪ§ОнжаЕФЭМЯёЃЌР§ШчMNISTжаПЩвдНЋЪфШыЕФЯђСПЛЙдГЩЭМЦЌЕФЯёЫиОиеѓ

ЪЙгУЗНЗЈЃКtf.summary.image(tag, tensor, max_images=3, collections=None,

name=None)

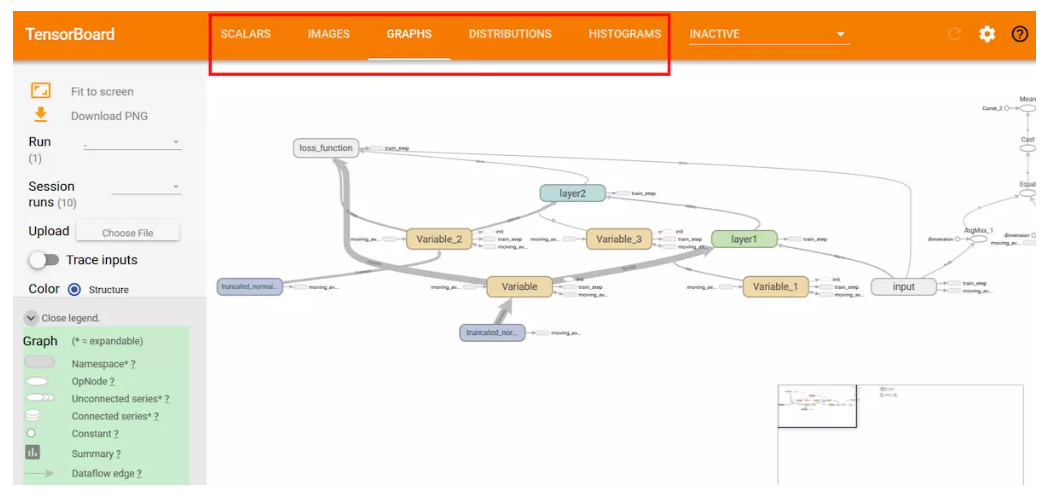

GRAPHSЃЌ ПЩЪгЛЏTensorflowМЦЫуЭМЕФНсЙЙМАМЦЫуЭМЩЯЕФаХЯЂ

ЪЙгУЗНЗЈЃКtf.summary.FileWriter(logdir, graph)

ЦфЪЕетИіЗНЗЈЪЧНЋЕБЧАsummary protobufаДНќШежОЮФМўжаЃЌЕЋЪЧЛсздЖЏЩњГЩМЦЫуЭМЁЃ

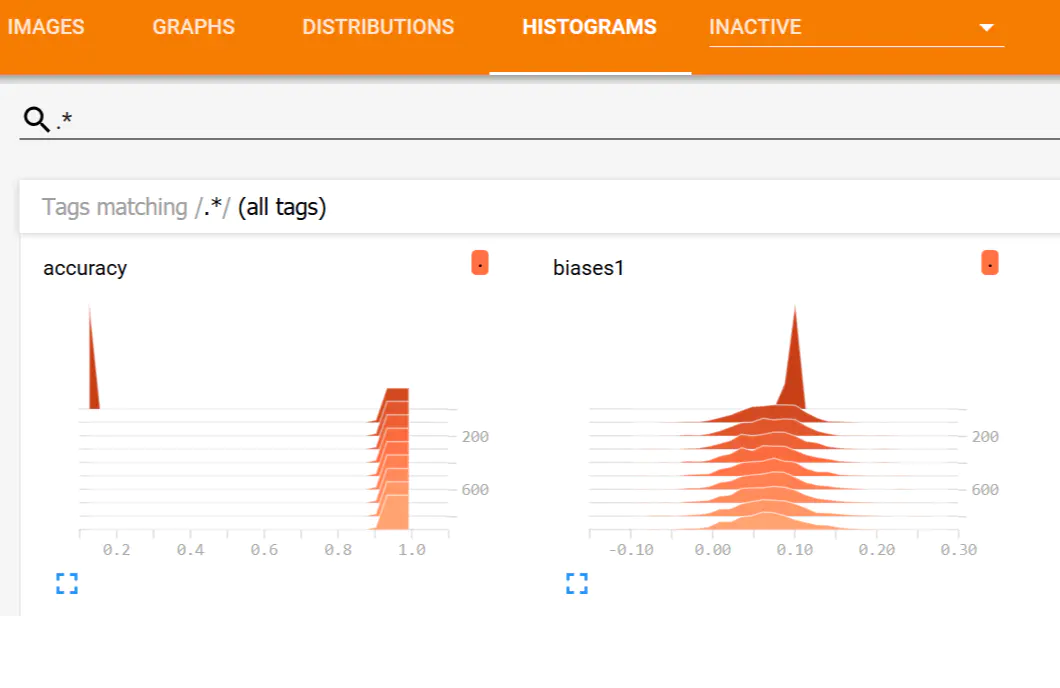

HISTOGRAMSЃЌМЧТМБфСПЕФжБЗНЭМ(еХСПжадЊЫиЕФШЁжЕЗжВМЃЉ

ЪЙгУЗНЗЈЃКtf.summary.histogram(tag, values, collections=None,

name=NoneЃЉ

МЦЫуЭМ

МЦЫуЭМПЩвдКмКУеЙЯжећИіЩёОЭјТчЕФНсЙЙЁЃЯТРДНЋМЦЫуЭМжаЕФЭМБъНјаазмНсЃК

БпЃЌМЦЫуЭМжаЕФНкЕужЎМфгаСНжжВЛЭЌЕФБпЃК

ЪЕЯпЃКПЬЛСЫЪ§ОнЕФДЋЪфЃЌМ§ЭЗДњБэЗНЯђ

ащЯпЃКБэДяСЫМЦЫужЎМфЕФвРРЕЙиЯЕ

гааЉБпЩЯЕФМ§ЭЗЪЧЫЋЯђЕФБэЪОвЛИіНкЕуПЩФмЛсаоИФСэвЛИіНкЕуЃЌЭЌЪББпЩЯЛЙБъзЂСЫеХСПЕФЮЌЖШаХЯЂЃЌБпЩЯЕФДжЯИБэЪОСЫСНИіНкЕужЎМфДЋЪфЕФБъСПЮЌЖШЕФзмДѓаЁЃЈВЛЪЧДЋЪфЕФБъСПИіЪ§ЃЉЁЃ

ЭМЃЌ TensorBoardЛсжЧФмЕФЕїећПЩЪгЛЏаЇЙћЭМЩЯЕФНкЕуЃЌНЋМЦЫуЭМЗжГЩСЫжїЭМЃЈMain GraphЃЉКЭИЈжњЭМЃЈAuxiliary

nodesЃЉЁЃвВПЩвдЪжЖЏЕїећЃЌЖдЭМжаЕФНкЕуНјаавЦГ§ЃЈВЛЛсБЃДцЪжЙЄаоИФНсЙћЃЌЫЂаТКѓЛЙдЃЉЁЃ

НкЕуЃЌЕБЕуЛїПЩЪгЛЏЭМжаЕФНкЕуЪБЃЌНчУцгвЩЯНЧЛсЕЏГіИУНкЕуЕФЛљБОаХЯЂЃЈЪфШыЁЂЪфГіЁЂвРРЕЙиЯЕвдМАЯћКФЪБМфКЭФкДцаХЯЂЕШЃЉЁЃ

ПеаФаЁЭждВЃКЖдгІМЦЫуЭМЩЯвЛИіМЦЫуНкЕу

ОиаЮЃКЖдгІСЫМЦЫуЭМЩЯЕФвЛИіУќУћПеМф

НкЕуаХЯЂ

ИеЫЕНкЕуЕФЛљБОаХЯЂжаАќКЌЯћКФЪБМфКЭФкДцаХЯЂЃЌПЩвдЭЈЙ§вдЯТЗНЗЈНЋЦфЬэМгЕНШежОЮФМўВЂНјааеЙЪОЁЃ

for i in range(TRAINING_STEPS):

# УП1000ДЮОЭдкбщжЄМЏЩЯВтЪдбЕСЗЕФФЃаЭОЋЖШ

if i % 100 == 0:

# ХфжУдЫааЪБвЊМЧТМЕФаХЯЂ

run_options = tf.RunOptions(trace_level=tf.RunOptions.FULL_TRACE)

# дЫааЪБМЧТМдЫаааХЯЂЕФproto

run_metadata = tf.RunMetadata()

# НЋХфжУаХЯЂКЭдЫааМЧТМаХЯЂЕФprotoДЋШыдЫааЙ§ГЬЃЌДгЖјНјааМЧТМ

validate_acc, sum = sess.run([accuracy, summ],

feed_dict=validate_feed, options=run_options,

run_metadata=run_metadata)

# НЋНкЕуЕФдЫаааХЯЂаДШыШежОЮФМў

writer.add_run_metadata(run_metadata, 'step%03d'

% i) |

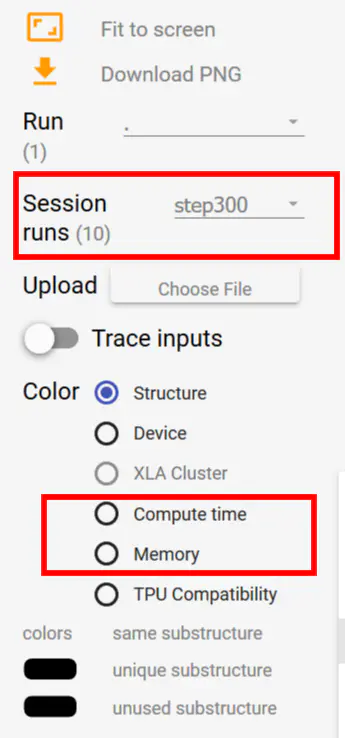

дкTensorBoardПЩЪгЛЏЕФGraphsвГУцжаЃЌзѓВрЕФSession

runsЛсГіЯжвЛИіЯТРВЫЕЅЃЌМЧТМСЫЫљгадЫааДЮЪ§ЃЌбЁдёвЛДЮдЫааКѓЃЌColorРИжаЛсГіЯжCompute

timeКЭMemoryЃЌЗжБ№ЖдгІСЫМЦЫуНкЕуЕФдЫааЪБМфКЭЯћКФЕФФкДцЁЃ

GRAPHSЕФзѓБпПђ

merge_all()

КЭTensorflowРрЫЦЃЌtf.summaru.histograms()ЕШКЏЪ§ВЛЛсСЂМДжДааЃЌашвЊЭЈЙ§sess.run()РДУїШЗЕїгУЃЌЕБШежОГЬађжаЖЈвхаДШежОЕФВйзїБШНЯЖрЪБЃЌПЩвдЪЙгУsumm

= tf.summary.merge_all()КЏЪ§РДећРэЫљгаЕФШежОЩњГЩВйзїЃЌзюКѓжЛашвЊsess.run(summ)МДПЩНЋЖЈвхжаЕФЫљгаШежОЩњГЩВйзївЛДЮжДааЁЃ

TensorBoardЕФЪЙгУСїГЬ

ЬэМгМЧТМНкЕуЃКtf.summary.scalar/image/histogram()ЕШ

ЛузмМЧТМНкЕуЃКmerged = tf.summary.merge_all()

дЫааЛузмНкЕуЃКsummary = sess.run(merged)ЃЌЕУЕНЛузмНсЙћ

ШежОЪщаДЦїЪЕР§ЛЏЃКsummary_writer = tf.summary.FileWriter(logdir,

graph=sess.graph)ЃЌЪЕР§ЛЏЕФЭЌЪБДЋШы graph НЋЕБЧАМЦЫуЭМаДШыШежО

ЕїгУШежОЪщаДЦїЪЕР§ЖдЯѓsummary_writerЕФadd_summary(summary, global_step=i)ЗНЗЈНЋЫљгаЛузмШежОаДШыЮФМў

ЕїгУШежОЪщаДЦїЪЕР§ЖдЯѓsummary_writerЕФclose()ЗНЗЈаДШыФкДцЃЌЗёдђЫќУПИє120sаДШывЛДЮ

ЯТУцЪЧвЛИіЭъећЕФЪЙгУTensorBoardЕФДњТыЃК

# _*_ coding:utf-8

_*_

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import

input_data

# ЖЈвхЩёОЭјТчЕФЩёОдЊЪ§ФП

INPUT_NODE = 784

LAYER1_NODE = 500

OUTPUT_NODE = 10

# УПДЮбЕСЗЪ§ОнЕФИіЪ§

BATCH_SIZE = 100

# ЫЅМѕбЇЯАТЪЕФВЮЪ§

LEARNING_RATE_BASE = 0.8

LEARNING_RATE_DECAY = 0.99

# е§дђЛЏЯюЕФЯЕЪ§ |

|