| БрМЭЦМі: |

БОЮФРДздгкcsdnЃЌБОЮФНЋЭЈЙ§вдOCRЃЈЙтбЇзжЗћЪЖБ№ЃЉЕФГЁОАРДНщЩмЩюЖШбЇЯАдкМЦЫуЛњЪгОѕжаЕФгІгУЁЃ

|

|

вЛЃЌЕЅБфСПЯпадЛиЙщЃК

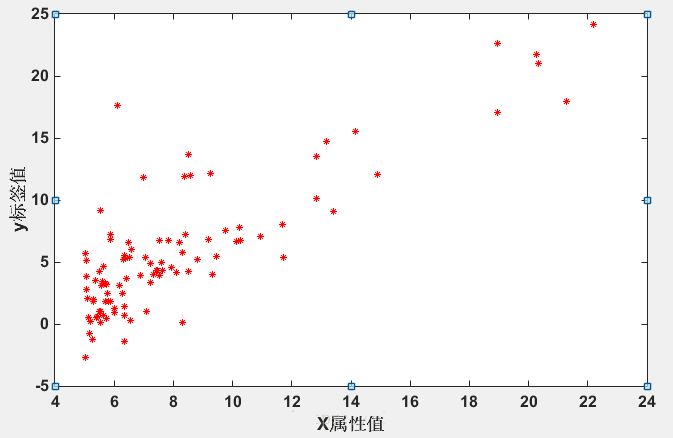

1. Ъ§ОнЗжВМЃЌxжсЪЧЪєадГЧЪаШЫПкЃЌyжсЪЧБъЧЉжЕгЏРћЃК

2. ФПЕФЃКЪЙгУвЛИіЯпадКЏЪ§ШЅФтКЯЩЯУцетаЉЪ§ОнЃЛ

ИУЯпадКЏЪ§ШчЯТжЛгаСНИіВЮЪ§ЃЌРћгУЬнЖШЯТНЕевГіЪЙЫ№ЪЇжЕзюаЁЪБЃЌЖдгІЕФСНИіВЮЪ§жЕЃЌМДЕУЕНСЫЯпадКЏЪ§ЁЃ

ЫуЗЈШ§вЊЫиЃК

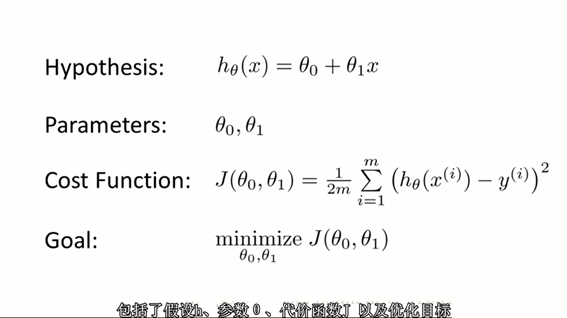

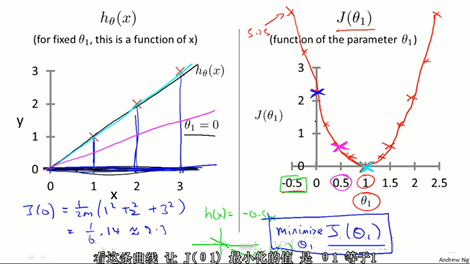

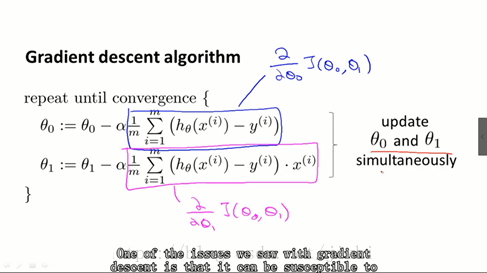

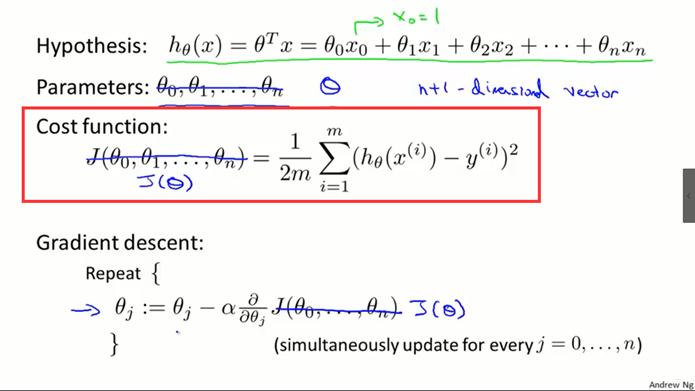

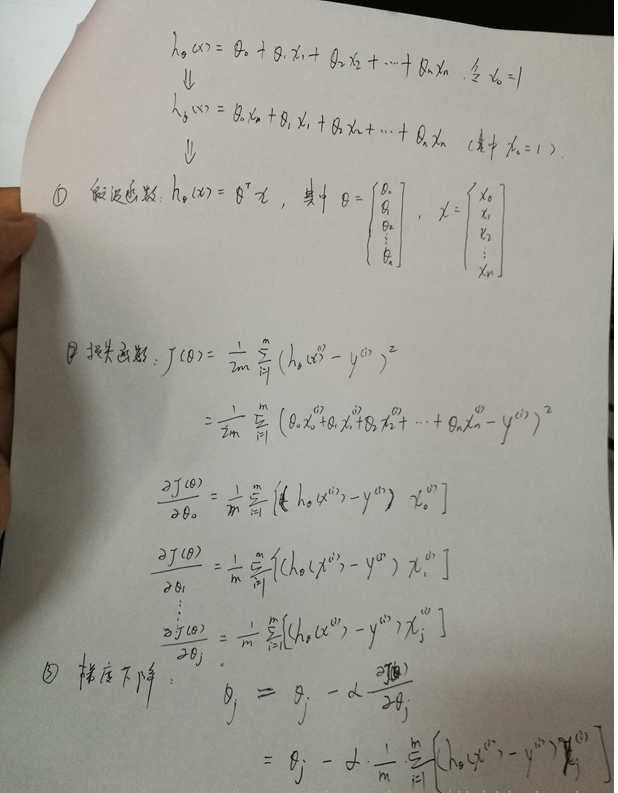

1ЃЉЩшжУЯпадКЏЪ§ЃЌМДМйЩшКЏЪ§(Hypothesis)ЃЛ

2ЃЉбЁЖЈЫ№ЪЇКЏЪ§ JЃЌ

3ЃЉЬнЖШЯТНЕЃЌевЕНЪЙЕУJжЕзюаЁЪБЃЌЖдгІЕФtheta_0, theta_1ЁЃ

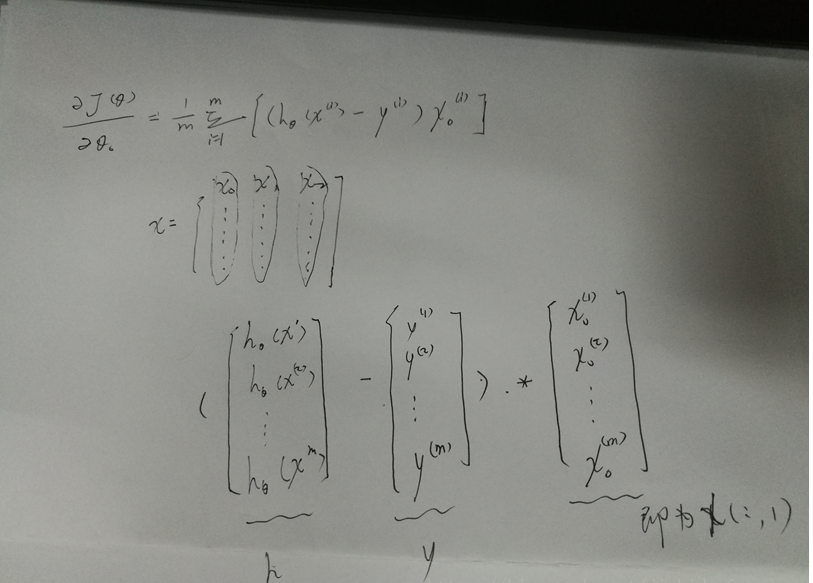

JжЕзюаЁЃЌдЄВтЕФh_theta(x)жЕОЭЛсдННгНќБъЧЉжНy

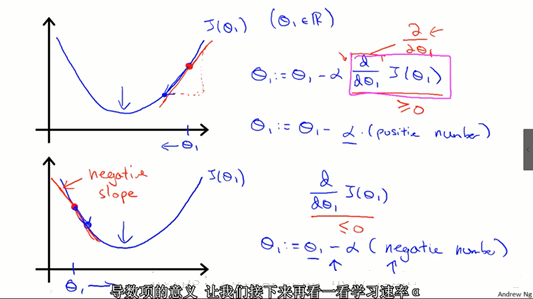

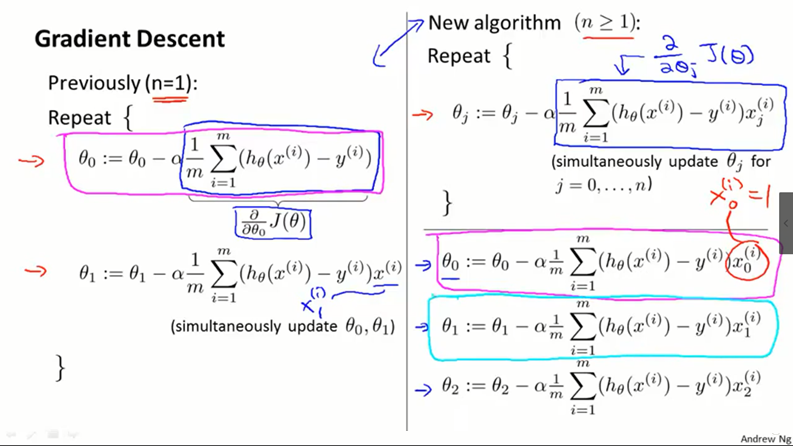

3. ЬнЖШЯТНЕЃК

евЫ№ЪЇКЏЪ§JЕФзюаЁжЕЃЌИпЪ§жЊЪЖПЩжЊЖдКЏЪ§ЧѓЕМЕШгкСуЃЌЖдгІЕФЕуМДЮЊМЋжЕЕуЃЌЕЋгааЉКЏЪ§ВЛФмжБНгЧѓГіЕЙЪ§жЕЃЌЫљвдашвЊЬнЖШЯТНЕж№НЅЕФЧїЯђзюаЁжЕЁЃ

ЬнЖШЯТНЕЙ§ГЬШчЯТЫљЪОЃЌБугкЗжЮіЃЌетРяМйЩшЯпадКЏЪ§ЮЊ theta_1

* x, УЛга theta_0ЃЌtheta = theta - alpha * K, KМДЮЊаБТЪЃЌЕќДњБфЛЏ\theta_1жЕЃЌЪЙЕУJжЕЮЊ0

ЦфжаЃЌЕќДњЙ§ГЬЃК

4. MatlabЪЕЯжЃК

clc;

clear;

data

= load('D:/Code/Data/ex1data1.txt');

X = data(:,1);

y

= data(:,2);

figure,plot(X, y, 'r*', 'MarkerSize',

5); % 5ПижЦ*ЕФДѓаЁ

% xМгСЫвЛСа,БфГЩ (97,2)

m = length(y);

X = [ones(m, 1), data(:,1)];

% ГѕЪМЛЏВЮЪ§

theta = zeros(2,

1);

% Some gradient descent settings

iterations

= 1500;

alpha = 0.01;% ЬнЖШЯТНЕЃЌевЕНзюМбВЮЪ§

theta = gradientDescent(X,

y, theta, alpha, iterations);

hold on;

% keep

previous plot visible

plot(X(:,2), X*theta, '-')

legend('Training

data', 'Linear regression')

hold off

|

function theta

= gradientDescent(X, y, theta, alpha, num_iters)

m = length(y);

% бљБОЪ§СП

for iter = 1:num_iters

H

= X * theta;

%(97,2)*(2*1)=(97,1)

Sum = [0 ; 0];

%(2,1)ЃЌМЧТМЦЋЕМЃЌЧѓКЭ

% theta_0ИќаТ

for i = 1 : m

Sum(1,1)

= Sum(1,1) + (H(i) - y(i));

end

% theta_1ИќаТ

for

i = 1 : m

Sum(2,1) = Sum(2,1) + (H(i) - y(i))

* X(i,2)';

end

theta = theta - (alpha * Sum) /

m;

end

end

|

ЙиМќДњТыЃК

Sum = [0 ; 0];

%(2,1)ЃЌМЧТМЦЋЕМЃЌЧѓКЭ

% theta_0ИќаТ

for i = 1 : m

Sum(1,1)

= Sum(1,1) + (H(i) - y(i));

end

% theta_1ИќаТ

for

i = 1 : m Sum(2,1) = Sum(2,1) + (H(i) - y(i))

* X(i,2)';

end

theta = theta - (alpha * Sum) /

m;

|

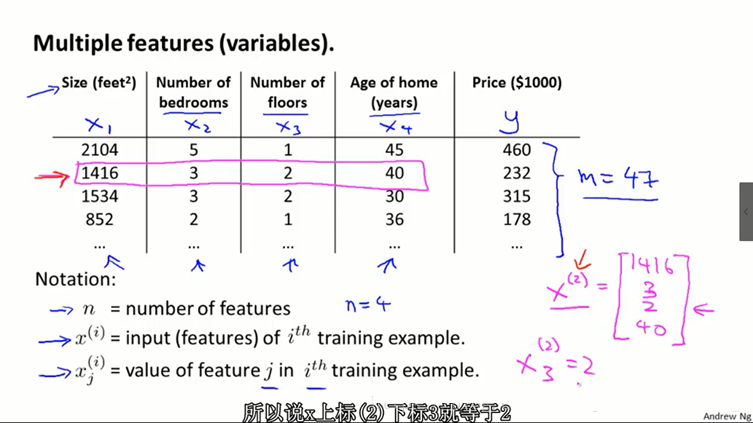

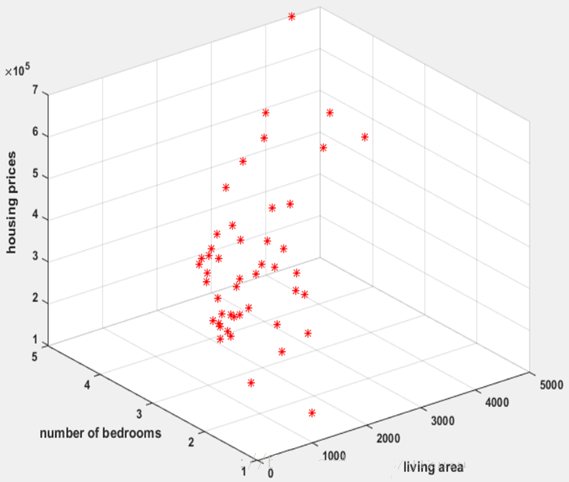

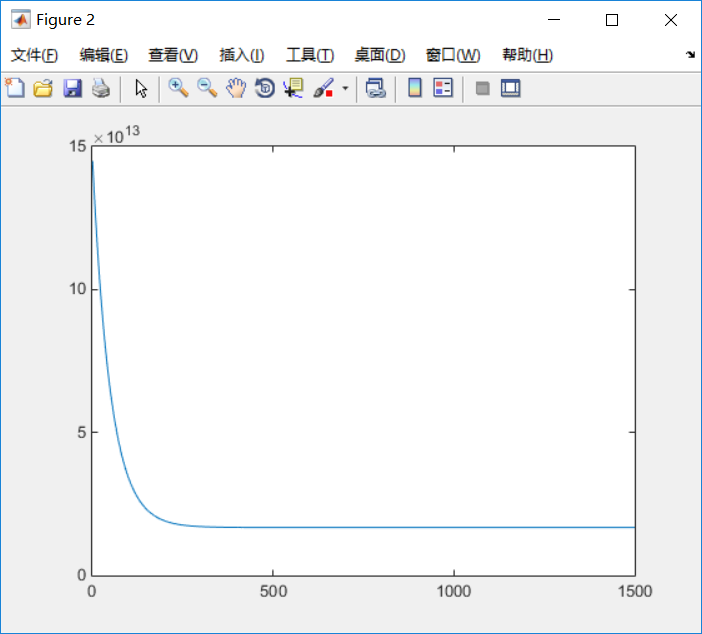

5. аЇЙћШчЯТЃК

ЖўЃЌЖрБфСПЕФЯпадЛиЙщ

1. ЖрБфСПЕФР§згЃЌШчЯТ

2. Ъ§ОнМЏЯТдиЕуЛїДђПЊСДНгЃЌУмТыЃКibtbЃК

ЛГіЪ§ОнЗжВМЃК

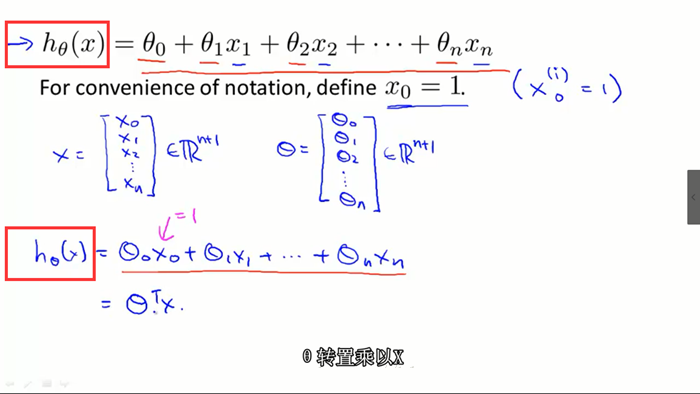

3. ЖрБфСПЕФМйЩшКЏЪ§ЖЈвхЃК

4. ЖрБфСПЕФЫ№ЪЇКЏЪ§ЃК

5. ЕќДњЙ§ГЬШчЯТЃК

ЪжЭЦвЛАбЃК

6. ЖрБфСПЕФЯпадЛиЙщЃЌMatlabЪЕЯжЃК

clear;

clc;

% 1ЃЌЖСШЁЪ§Он

x

= load('D:\Code\Data\ex3Data\ex3x.dat'); % СНИіБфСПЗПзгУцЛ§ЃЌКЭЮдЪвЪ§ФПЃЌвЛаавЛИібљБО

y

= load('D:\Code\Data\ex3Data\ex3y.dat'); % ЗПзгМлИё

%

plot3(x(:,1), x(:,2), y, 'r*');% grid on % ЛЩЯЭјИё

%

hold on; % КѓУцНЋЛЩЯФтКЯЕФЯп

% 2, ДІРэЪ§Он

m = length(x(:,1));

% бљБОЪ§

x = [ones(m,1), x]; % x0 ЮЊ1

x(:,2) = (x(:,2)

- mean(x(:,2))) ./ std(x(:,2));

x(:,3) = (x(:,3)

- mean(x(:,3))) ./ std(x(:,3));

plot3(x(:,1), x(:,2),

y, 'r*');

grid on % ЛЩЯЭјИё

hold off;

% 3ЃЌВЮЪ§ЩшжУ

iter

= 1500; % ЕќДњДЮЪ§

theta = zeros(1,3); % ЯпадКЏЪ§ЕФВЮЪ§ЃЌЮЊааЯђСП

alpha

= 0.01;

J = zeros(m,1);

for i = 1:iter % вдЕќДњДЮЪ§ЮЊжежЙЬѕМў

% ЧѓвдЕБЧАthetaЮЊЯпадКЏЪ§ЕФВЮЪ§ЪБЃЌЦфЫ№ЪЇжЕ

h = x * theta';

% МйЩшКЏЪ§ J(i) = 1/2*m * sum((h - y).^2); % МЧТМУПДЮЕќДњКѓЫ№ЪЇжЕЧщПіЃЌЕЋЖдЕќДњжежЙУЛгагАЯь

theta(1,1) = theta(1,1) - alpha*(1/m)* sum((h

- y) .* x(:,1)); % x(:,1)МДЮЊx_0

theta(1,2) =

theta(1,2) - alpha*(1/m)* sum((h - y) .* x(:,2));

theta(1,2) = theta(1,3) - alpha*(1/m)* sum((h

- y) .* x(:,3));

% theta = theta - alpha*(1/m)*

sum(x'*(h - y)); % вЛДЮадДІРэЫљгаtheta

end figure,

% ЛГіЫ№ЪЇКЏЪ§ЫцЕќДњДЮЪ§ЕФБфЛЏЧщПі

plot(1:iter, J);

|

Ы№ЪЇКЏЪ§БфЛЏЧщПіЃК

ЙиМќДњТыНтЪЭЃК

theta(1,1) = theta(1,1) - alpha*(1/m)* sum((h - y)

.* x(:,1)); % x(:,1)МДЮЊx_0

Ш§ЃЌе§ЙцЗНГЬЃЈnormal equationЃЉ

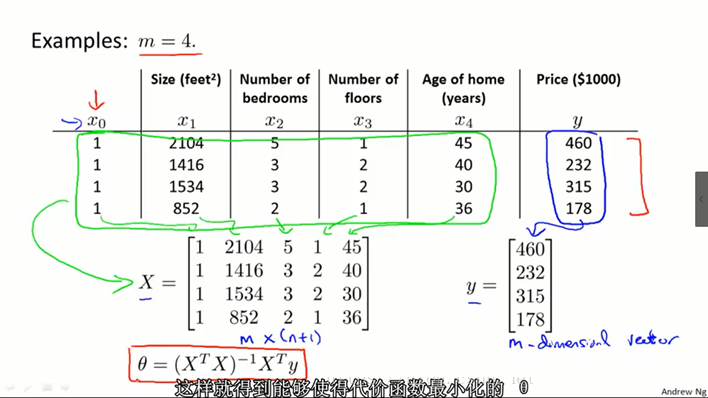

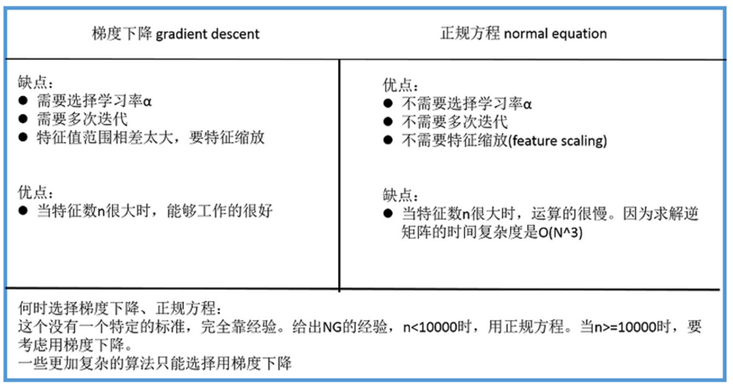

1. ЧѓзюМбЕФВЮЪ§thetaЃЌГ§СЫЪЙгУЬнЖШЯТНЕЗЈЃЌвВПЩвдЪЙгУе§ЙцЗНГЬЃЌОпЬхЗНЪНЃЌЫљгабљБОзщГЩвЛИіОиеѓXЃЌОиеѓЕФУПвЛааЮЊвЛИібљБОЃЌ

ВЮЪ§thetaжБНгЪЙгУЯТУцЕФе§ЙцЙЋЪНМДПЩЕУЕНЃК

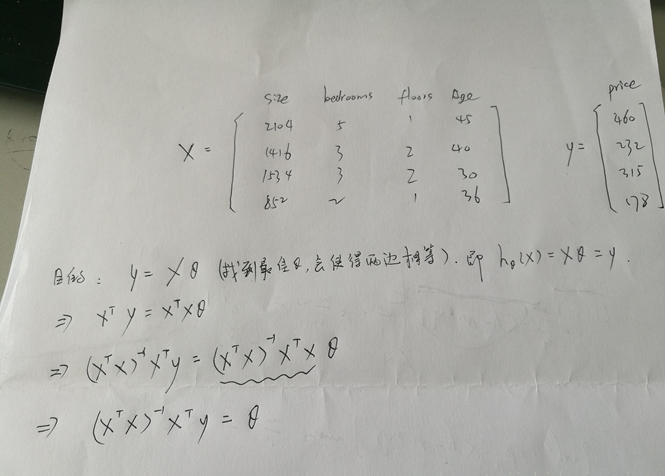

2. ЬнЖШЯТНЕЗЈКЭе§ЙцЗНГЬЖдБШЃКNGЭЦМіЬиеїЪ§аЁгквЛЭђЪБЃЌВЩгУе§ЙцЗНГЬ

3. е§ЙцЗНГЬЕФЭЦЕМЙ§ГЬЃКШчЙћ y = X * thetaЃЌдђЫ№ЪЇКЏЪ§жЕЮЊ0ЃЌМДевЕНзюМбthetaЁЃМДвбжЊy

= X * thetaЃЌЧѓthetaЃП

|