| БрМЭЦМі: |

БОЮФНщЩмШчКЮАбTiDB

зїЮЊбЁаЭЕФЪзбЁЖдЯѓеЙПЊСЫВтЪдКЭЪдгУвдМАЧЈвЦКЭTiDB ЯпЩЯЙцФЃМАКѓајЙцЛЎЃЌЯЃЭћЖдФњЕФбЇЯАгаЫљАяжњЁЃ

БОЮФРДздгкCSDNЃЌгЩЛ№СњЙћШэМўAliceБрМЁЂЭЦМіЁЃ |

|

вЛЁЂЙЋЫОМАвЕЮёМмЙЙНщЩм

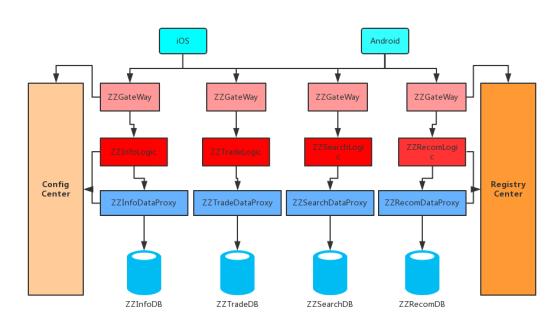

зЊзЊЖўЪжНЛвзЭј ЁЊЁЊ АбМвРяВЛгУЕФЖЋЮїТєСЫБфГЩЧЎЃЌвЛИіАяФузЌЧЎЕФЭјеОЁЃгЩЬкбЖгы58МЏЭХЙВЭЌЭЖзЪЁЃЮЊКЃСПгУЛЇЬсЙЉвЛИігаЕЃБЃЁЂБуНнЕФЖўЪжНЛвзЦНЬЈЁЃзЊзЊЪЧ2015Фъ11дТ12Шее§ЪНЭЦГіЕФ

APPЃЌзёбЁАгУЛЇЕквЛЁБЕФКЫаФМлжЕЙлЃЌвдЁАШУзЪдДжиаТХфжУЃЌШУШЫгыШЫИќаХШЮЁБЮЊЦѓвЕдИОАЃЌЬсГЋецЪЕИіШЫНЛвзЁЃ

зЊзЊЖўЪжНЛвзКИЧЪжЛњЁЂ3C Ъ§ТыЁЂФИгЄгУЦЗЕШШ§ЪЎгрИіЦЗРрЁЃдкЯЕЭГЩшМЦЩЯЃЌзЊзЊећЬхМмЙЙВЩгУЮЂЗўЮёМмЙЙЃЌЪзЯШАДеевЕЮёСьгђФЃаЭДЙжБВ№ЗжГЩгУЛЇЁЂЩЬЦЗЁЂНЛвзЁЂЫбЫїЁЂЭЦМіЮЂЗўЮёЁЃЖдУПвЛИіЙІФмЕЅдЊЃЈЩЬЦЗЕШЃЉЃЌМЬајНјааЫЎЦНВ№ЗжЃЌЗжЮЊЩЬЦЗЭјЙиВуЁЂЩЬЦЗвЕЮёТпМВуЁЂЩЬЦЗЪ§ОнЗУЮЪВуЁЂЩЬЦЗ

DB / CacheЃЌШчЯТЭМЫљЪОЃК

ЖўЁЂЯюФПБГОА

1ЁЂУцСйЕФЮЪЬт

зЊзЊКѓЖЫвЕЮёЯжНзЖЮжївЊЪЙгУ MySQL Ъ§ОнПтДцДЂЪ§ОнЃЌЛЙгаЩйВПЗжвЕЮёЪЙгУMongoDBЁЃЫфШЛФПЧАЧщПіЯТЪЙгУетСНжжДцДЂЛљБОПЩвдТњзуЮвУЧЕФашЧѓЃЌЕЋЫцзХвЕЮёЕФдіГЄЃЌЙЋЫОЕФЪ§ОнЙцФЃж№НЅБфДѓЃЌЮЊСЫгІЖдДѓЪ§ОнСПЯТвЕЮёЗўЮёЗУЮЪЕФадФмЮЪЬтЃЌMySQL

Ъ§ОнПтГЃгУЕФЗжПтЁЂЗжБэЗНАИЛсЫцзХ MySQL ShardingЃЈЗжЦЌЃЉ ЕФдіЖрЃЌвЕЮёЗУЮЪЪ§ОнПтТпМЛсдНРДдНИДдгЁЃЖјЧвЖдгкФГаЉгаЖрЮЌЖШВщбЏашЧѓЕФБэЃЌЮвУЧзмашвЊв§ШыЖюЭтЕФДцДЂЛђЮўЩќадФмРДТњзуЮвУЧЕФВщбЏашЧѓЃЌетбљЛсЪЙвЕЮёТпМЛсдНРДдНжиЃЌВЛРћгкВњЦЗЕФПьЫйЕќДњЁЃ

ДгЪ§ОнПтдЫЮЌНЧЖШНВЃЌДѓЪ§ОнСПЕФЧщПіЯТЃЌMySQL Ъ§ОнПтдкУПДЮ DDL ЖМЛсЖддЫЮЌШЫдБдьГЩКмДѓЕФЙЄзїСПЃЌЕБНкЕуЙЪеЯКѓЃЌгЩгкЪ§ОнСПНЯДѓЃЌЛжИДЪБМфНЯГЄЁЃЕЋетжж

M-S МмЙЙжЛФмЭЈЙ§жїДгЧаЛЛВЂЧвашвЊЖюЭтЕФИпПЩгУзщМўРДБЃеЯИпПЩгУЃЌЭЌЪБдкЧаЛЛЙ§ГЬгЩгкашвЊШЗЖЈжїПтзДЬЌЁЂаТжїПтбЁОйЁЂаТТЗгЩЯТЗЂЕШдвђЃЌЛЙЪЧЛсДцдкЖЬднЕФвЕЮёЗУЮЪжаЖЯЕФЧщПіЁЃ

злЩЯЫљЪіЃЌЮвУЧУцСйЕФжївЊЮЪЬтПЩЙщФЩЮЊЃК

Ъ§ОнСПДѓЃЌШчКЮПьЫйЫЎЦНРЉеЙДцДЂЃЛ

ДѓЪ§ОнСПЯТЃЌШчКЮПьЫй DDLЃЛ

ЗжПтЗжБэдьГЩвЕЮёТпМЗЧГЃИДдгЃЛ

ГЃЙц MySQL жїДгЙЪеЯзЊвЦЛсЕМжТвЕЮёЗУЮЪЖЬднВЛПЩгУЁЃ

2ЁЂЮЊЪВУДбЁдё TiDB

еыЖдЩЯеТЬсЕНЕФЮЪЬтЃЌзЊзЊЛљДЁМмЙЙВПКЭ DBA ЭХЖгПМТЧзЊзЊвЕЮёЪ§ОндіЫйЃЌЖЈЮЛМђЛЏвЕЮёЭХЖгЪ§ОнПтЪЙгУЗНАИЃЌИќКУЕФжњСІвЕЮёЗЂеЙЃЌОіЖЈЦєЖЏаТаЭДцДЂЗўЮёЃЈNewSQLЃЉЕФбЁаЭЕїбаЙЄзїЁЃ

TiDB Ъ§ОнПтЃЌНсКЯСЫЙиЯЕПтгы KV ДцДЂЕФгХЕуЃЌЖдгкЪЙгУЗНЃЌЭъШЋПЩвдЕБзі MySQL РДгУЃЌЖјЧвВЛгУПМТЧЪ§ОнСПДѓСЫКѓЕФЗжПтЗжБэвдМАЮЊСЫжЇГжЗжПтЗжБэКѓЕФЖрЮЌЖШВщбЏЖјНЈСЂЕФ

Mapping БэЃЌПЩвдАбОЋСІШЋВПЗХдквЕЮёашЧѓЩЯЁЃЫљвдЮвУЧАб TiDB зїЮЊбЁаЭЕФЪзбЁЖдЯѓеЙПЊСЫВтЪдКЭЪдгУЁЃ

Ш§ЁЂTiDB ВтЪд

1ЁЂTiDB ЙІФмВтЪд

TiDB жЇГжОјДѓЖрЪ§ MySQL гяЗЈЃЌвЕЮёПЩвдНЋЛљгк MySQL ЕФПЊЗЂЃЌЮоЗьЧЈвЦжС TiDBЁЃВЛЙ§ФПЧА

TiDB ВЛжЇГжВПЗж MySQL ЬиадЃЌШчЃКДцДЂЙ§ГЬЁЂздЖЈвхКЏЪ§ЁЂДЅЗЂЦїЕШЁЃ

2ЁЂTiDB бЙСІВтЪд

ЭЈЙ§ВтЪдЙЄОпФЃФтВЛЭЌЕФГЁОАЕФЧыЧѓЃЌЖд TiDB Ъ§ОнПтНјаабЙСІВтЪдЃЌЭЈЙ§бЙСІВтЪдНсЙћЕФЖдБШЃЌПЩвдЬсЙЉ

RD ЪЙгУ TiDB ЕФКЯЪЪвЕЮёГЁОАвдМА TiDB ЕФЪЙгУНЈвщЁЃ

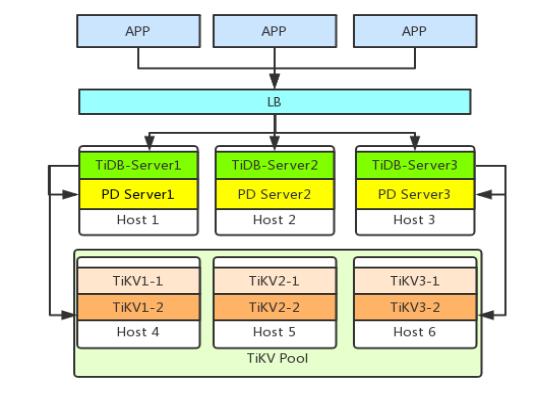

ДЫДЮбЙСІВтЪдЃЌзмЙВЪЙгУ 6 ЬЈЮяРэЗўЮёЦїЃЌЦфжа 3 ЬЈ CPU УмМЏаЭЗўЮёЦїЃЌгУгкЦєЖЏ TiDB-ServerЁЂPD

ЗўЮёЃЛСэЭт 3 ЬЈЮЊ IO / CPU УмМЏаЭЕФ PCIE ЗўЮёЦїЃЌгУгкЦєЖЏ TiKV ЗўЮёЁЃ

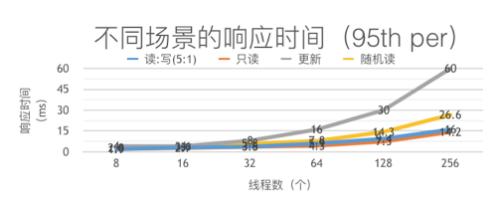

ЪЙгУ sysbench-1.0.11 ВтЪдЪ§ОнДѓаЁЮЊ 200 G ЕФ TiDB МЏШКЃЌдкВЛЭЌГЁОАЯТ

TiDB ЕФЯьгІЪБМфЃЈ95th perЃЉЃК

3ЁЂНсЙћећРэ

ЫГађЩЈУшЕФаЇТЪЪЧБШНЯИпЕФЃЌСЌајЕФааДѓИХТЪЛсДцДЂдкЭЌвЛЬЈЛњЦїЕФСкНќЮЛжУЃЌУПДЮХњСПЕФЖСШЁКЭаДШыЕФаЇТЪЛсИпЃЛ

ПижЦВЂЗЂдЫааЕФЯпГЬЪ§ЃЌЛсМѕЩйЧыЧѓЯьгІЪБМфЃЌЬсИпЪ§ОнПтЕФДІРэадФмЁЃ

4ЁЂГЁОАНЈвщ

ЪЪКЯЯпЩЯвЕЮёЛьКЯЖСаДГЁОАЃЛ

ЪЪКЯЫГађаДЕФГЁОАЃЌБШШчЃКЪ§ОнЙщЕЕЁЂВйзїШежОЁЂЬЏЯњСїЫЎЁЃ

5ЁЂTiDB дЄЩЯЯп

НЋ TiDB ЙвдиЕНЯпЩЯ MySQLЃЌзїЮЊ MySQL ДгПтЭЌВНЯпЩЯЪ§ОнЃЌШЛКѓвЕЮёНЋВПЗжЯпЩЯЖССїСПЧаЛЛЕН

TiDBЃЌПЩвдЖд TiDB МЏШКЪЧЗёТњзувЕЮёЗУЮЪзіКУдЄХаЁЃ

ЫФЁЂвЕЮёНгШы

1ЁЂЧЈвЦЙ§ГЬ

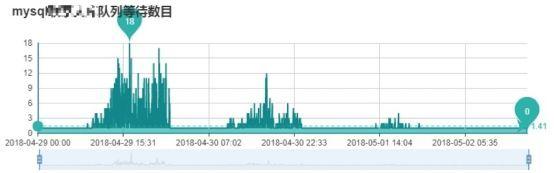

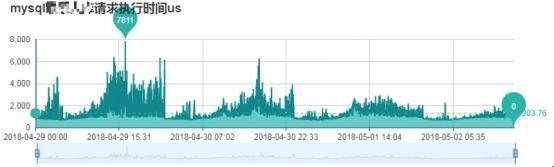

ЮвУЧЕквЛИіНгШы TiDB ЕФвЕЮёЯпЪЧзЊзЊЯћЯЂЗўЮёЁЃЯћЯЂзїЮЊзЊзЊзюживЊЕФЛљДЁЗўЮёжЎвЛЃЌЪЧБЃжЄЦНЬЈЩЯТђТєЫЋЗНгааЇЙЕЭЈЁЂДйНјНЛвзДяГЩЕФживЊзщМўЃЌЦфЪ§ОнСПКЭЗУЮЪСПЖМЗЧГЃДѓЁЃЦ№ГѕЮвУЧЪЙгУЕФЪЧ

MySQLЪ§ОнПтЃЌЖдЦфЫљгаЕФвЕЮёЖМзіСЫПтЕФДЙжБВ№ЗжвдМАБэЕФЫЎЦНВ№ЗжЁЃФПЧАЯпЩЯгаМИЪЎ TB ЕФЪ§ОнЃЌМЧТМЪ§ОнДяЕНСЫМИАйвкЁЃЫфЖд

MySQL зіСЫЗжПтЗжБэЃЌЕЋЪЕР§вбОПЊЪМгжгаХМЗЂЕФадФмЮЪЬтЃЌашвЊТэЩЯЖдЪ§ОнНјааЖўДЮВ№ЗжЃЌЖјЖўДЮВ№ЗжЕФжДааГЩБОвВБШНЯИпЃЌетвВЪЧЮвУЧЪзЯШЧЈвЦЯћЯЂЪ§ОнПтЕФдвђжЎвЛЁЃ

ЯћЯЂЗўЮёгаМИИіКЫаФвЕЮёБэЃКСЊЯЕШЫСаБэЁЂЯћЯЂБэЁЂЯЕЭГЯћЯЂБэЕШЕШЁЃСЊЯЕШЫСаБэзїЮЊећИіЯћЯЂЯЕЭГЕФЪрХІЃЌГадизХОоДѓЕФЗУЮЪбЙСІЁЃвЕЮёГЁОАЯрЖдЦфЫћБэзюИДдгЕФЃЌвВЪЧетИіБэЕФЪЕЧóЯжСЫадФмЮЪЬтЃЌЫљвдЮвУЧОіЖЈЯШЧЈвЦСЊЯЕШЫСаБэЁЃ

ећИіЧЈвЦЙ§ГЬЗжШ§ВНЃКВтЪдЃЈХаЖЯ TiDB ЪЧЗёТњзувЕЮёГЁОАЃЌадФмЪЧЗё OKЃЉЃЛЭЌВНЪ§ОнЃЛЧаСїСПЁЃ

ВтЪдЃКЪзЯШЮвУЧФЃФтЯпЩЯЕФЪ§ОнКЭЧыЧѓЖдЁАСЊЯЕШЫСаБэЁБзіСЫДѓСПЙІФмКЭадФмЕФбщжЄЃЌЖјЧвЛЙНЋЯпЩЯЕФЪ§ОнКЭСїСПв§ЕНЯпЯТЃЌЖдЪ§ОнПтзіСЫецЪЕСїСПЕФбщжЄЃЌВтЪдНсЙћжЄУї

TiDB ЭъШЋТњзуЯћЯЂвЕЮёЕФашЧѓЁЃв§СїЙЄзїЃЌЮвУЧЪЧЭЈЙ§зЊзЊздбаЕФЯћЯЂЖгСаЃЌНЋЯпЩЯЪ§ОнПтЕФСїСПв§вЛЗнЕНВтЪдЛЗОГЁЃВтЪдЛЗОГЯћЗбЯћЯЂЖгСаЕФЪ§ОнЃЌзЊЛЛГЩЪ§ОнПтЗУЮЪЧыЧѓЗЂЫЭЕНTiDBВтЪдМЏШКЁЃЭЈЙ§ЗжЮіЯпЩЯКЭВтЪдЛЗОГСНИіЪ§ОнЗУЮЪФЃПщЕФШежОПЩвдГѕВНХаЖЯTiDBЪ§ОнПтЪЧЗёПЩвде§ГЃДІРэвЕЮёЧыЧѓЁЃЕБШЛНіНіетбљЪЧВЛЙЛЕФЃЌDBAЭЌбЇЛЙашвЊаЃбщTiDBЪ§ОнЕФе§ШЗад(ЪЧЗёгыЯпЩЯMySQLПтвЛжТ)ЁЃбщжЄЫМТЗЪЧГщбљбщжЄMySQLПтБэМЧТМКЭTiDBЕФМЧТМChecksumжЕЪЧЗёвЛжТЁЃ

ЭЌВНЪ§ОнЃКDBA ЭЌбЇВПЪ№ TiDB МЏШКзїЮЊ MySQL ЪЕР§ЕФДгПтЃЌНЋ MySQL ЪЕР§жаЕФСЊЯЕШЫСаБэЃЈЕЅЪЕР§ЗжСЫ

1024 ИіБэЃЉЕФЪ§ОнЭЌВНЕН TiDB ЕФвЛеХДѓБэжаЁЃ

ЧаСїСПЃКЧаСїСПЗжЮЊШ§ВНЃЌУПСНВНжЎМфЖМгавЛжмзѓгвЕФЙлВьЦкЃЌЕквЛВННЋЖССїСПЛвЖШЧаЕН TiDB ЩЯЃЛЕкЖўВНЖЯПЊ

TiDB гы MySQL ЕФжїДгЭЌВНЃЌвЕЮёПЊЫЋаДЃЈЭЌЪБаД MySQL КЭ TiDBЃЌБЃжЄСНПтЪ§ОнвЛжТЃЉШЗБЃвЕЮёСїСППЩвдЫцЪБЛиЙіЕН

MySQLЃЛЕкШ§ВНЭЃжЙ MySQL аДШыЃЌЕНДЫвЕЮёСїСПЭъШЋЧаЛЛЕН TiDB Ъ§ОнПтЩЯЁЃЧЈвЦЙ§ГЬжазюживЊЕФЕуОЭЪЧШЗБЃСНИіЪ§ОнПтЪ§ОнвЛжТЃЌетбљЖСаДСїСПЫцЪБПЩвдЧаЛиMySQLЃЌвЕЮёТпМВЛЪмШЮКЮгАЯьЁЃЪ§ОнПтЫЋаДЕФЗНАИгыЩЯЮФЬсЕНЕФв§СїВтЪдРрЫЦЃЌЪЙгУЯћЯЂЖгСав§вЛЗнаДШыСїСПЃЌTiDBЗУЮЪФЃПщЯћЗбЯћЯЂЖгСаЪ§ОнЃЌаДПтЁЃЕЋНіНіетбљЪЧВЛФмБЃжЄСНИіПтЪ§ОнвЛжТЕФЃЌвђЮЊетИіЗНАИЮоЗЈБЃжЄСНИіаДПтВйзїЕФдзгадЁЃЫљвдЮвУЧашвЊвЛИіИќбЯНїЕФЗНАИЃЌзЊзЊЕФЯћЯЂЖгСаЛЙЬсЙЉСЫЪТЮёЯћЯЂЕФжЇГжЃЌПЩвдБЃжЄБОЕиВйзїКЭЗЂЫЭЯћЯЂЕФдзгадЁЃРћгУетвЛЬиаддйМгЩЯвьВНВЙГЅВпТд(РыЯпЩЈУшШежОЃЌШчЙћгаЪЇАмЕФаДШыЧыЧѓЃЌаое§Ъ§Он)БЃжЄУПИіЯћЯЂЖМБЛГЩЙІЯћЗбЧвСНИіПтУПДЮаДШыНсЙћЖМЪЧвЛжТЕФЃЌДгЖјБЃжЄСЫMySQLгыTiDBСНИіПтЕФЪ§ОнвЛжТЁЃ

2ЁЂгіЕНЮЪЬт

АДееЩЯЪіЕФЗНАИЃЌЮвУЧвбОНЋЯћЯЂЫљгаЕФвЕЮёЖМЧаЕН TiDB Ъ§ОнПтЩЯЁЃЧЈвЦЙ§ГЬжавВВЛЖМЪЧЫГЗчЫГЫЎЃЌвВгіЕНСЫЮЪЬтЃЌЙ§ГЬжавВЕУЕНСЫ

TiDB ЙйЗНЭХЖгЕФДѓСІжЇГжЁЃетРяжївЊНщЩмСНИіЮЪЬтЃК

ЃЈ1ЃЉTiDB зїЮЊЗжВМЪНДцДЂЃЌЦфЫјЛњжЦКЭ MySQL гаКмДѓВЛЭЌЁЃЮвУЧгавЛИіВЂЗЂСПКмДѓЃЌПЩФмЭЌЪБИќаТвЛЬѕМЧТМЕФГЁОАЃЌЮвУЧгУСЫ

MySQL ЕФЮЈвЛЫїв§БЃжЄСЫФГИі Key жЕЕФЮЈвЛадЃЌЕЋШчЙћвЕЮёЧыЧѓЪЙгУФЌШЯжЕОЭЛсДѓСПУќжаЮЈвЛЫїв§ЃЌЛсдьГЩ

N ЖрЧыЧѓЖМШЅИќаТЭЌвЛЬѕМЧТМЁЃдк MySQL ГЁОАЯТЃЌУЛгаадФмЮЪЬтЃЌЫљвдвЕЮёЩЯвВУЛзігХЛЏЁЃЕЋЕБЮвУЧгУетИіГЁОАВтЪд

TiDB ЪБЃЌЗЂЯж TiDB ДІРэВЛЬЋКУЃЌгЩгкЦфЪЙгУЕФРжЙлЫјЃЌЪ§ОнПтЪфГіДѓСПЕФжиЪдЕФШежОЁЃвЕЮёГіЯжМИЪЎУыЕФЧыЧѓбгГйЃЌдьГЩЖгСажаДѓСПЧыЧѓБЛХзЦњЁЃPingCAP

ЕФЭЌбЇНЈвщЕїећ retry_limit ЕЋвВУЛгаЭъШЋЩњаЇЃЈИУ BUG вбОдк 2.0 RC 5аоИДЃЉЃЌзюКѓвЕЮёНјаагХЛЏЃЈЙ§ТЫЪЙгУФЌШЯжЕЕФЧыЧѓЃЉКѓЮЪЬтЕУЕННтОіЁЃ

ЃЈ2ЃЉЕкЖўИіЮЪЬтЪЧдЫЮЌЗНУцЕФЃЌDBA ЭЌбЇАДееЪЙгУ MySQL ЕФдЫЮЌОбщЃЌЖдвЛИіЩЯНќ T ЕФБэзіСЫ

Truncate ВйзїЃЌВйзїКѓЃЌЦ№ГѕЪ§ОнПтБэЯже§ГЃЃЌЕЋМИЗжжгКѓЃЌПЊЪМГіЯжГЌЪБЃЌTiKV ИКдиБфИпЁЃзюКѓЧыНЬ

PingCAP ЭЌбЇЗжЮіЃЌЖЈЮЛЪЧВйзїДЅЗЂСЫЦЕЗБЛиЪе RegionЕФ BUGЃЈИУ BUG TiDB 2.0

АцБОвбОаоИДЃЉЁЃ

ЮхЁЂЯпЩЯаЇЙћЖдБШ

1ЁЂЖгСаЕШД§ЧщПіЖдБШ

ЪЙгУ TiDB Ъ§ОнПтЃЌвЕЮёФЃПщЖгСаЧыЧѓЪ§ЛљБОБЃГж 1 ИіЃЌMySQL ЛсгаНЯДѓЖЖЖЏЁЃ

2ЁЂЧыЧѓбгГйЧщПіЖдБШ

ЪЙгУ TiDB Ъ§ОнПтЃЌећЬхЯьгІбгЪБЗЧГЃЮШЖЈЃЌВЛЪмвЕЮёСїСПИпЗхгАЯьЃЌЕЋ MySQL ВЈЖЏКмДѓЁЃ СэЭтдкРЉеЙадЗНУцЃЌЮвУЧПЩвдЭЈЙ§ЮоЗьРЉеЙ

TiDB КЭ TiKV ЪЕР§ЬсЩ§ЯЕЭГЕФЭЬЭТСПЃЌетИіЬиад MySQL ЪЧВЛОпБИЕФЁЃ

3ЁЂвЕЮёбгГйКЭДэЮѓСПЖдБШ

НгШы TiDB Ъ§ОнПтКѓвЕЮёТпМВуЗўЮёНгПкКФЪБЮШЖЈЮоЖЖЖЏЃЌЧвУЛгаЗЂЩњЖЊЦњЕФЧщПіЃЈЯТЭМДэЮѓДѓЖргЩЪ§ОнЗУЮЪВуЗўЮёЖгСаЖбЛ§ЗЂЩњЧыЧѓЖЊЦњдьГЩЃЉЁЃ

СљЁЂTiDB ЯпЩЯЙцФЃМАКѓајЙцЛЎ

ФПЧАзЊзЊЯпЩЯвбОНгШыЯћЯЂЁЂЗчПиСНЬз OLTP вдМАвЛЬзЗчПи OLAP МЏШКЁЃ

МЏШКМмЙЙШчЯТЃКФПЧАзЊзЊЯпЩЯ TiDB МЏШКЕФзмШнСПМИАй TBЃЌЯпЩЯ TiDB БэЯжКмЮШЖЈЃЌЮвУЧЛсМЬајНгШыИќЖрЕФвЕЮёЃЈСєбдЃЌЦРТлЁЂЫбЫїЁЂЩЬЦЗЁЂНЛвзЕШЕШЃЉЁЃ

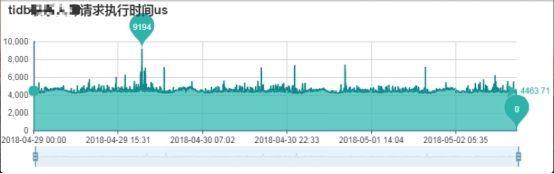

1ЁЂTiDB КѓајЙцЛЎ

ЖрИіе§дкПЊЗЂЕФаТвЕЮёдкПЊЗЂКЭВтЪдЛЗОГжаЪЙгУ TiDBЃЌЯпЩЯЛсжБНгЪЙгУ TiDBЃЛ

зЊзЊКЫаФЕФСєбдЁЂЦРТлЁЂЫбЫїЁЂЩЬЦЗЁЂНЛвзЖЉЕЅПтМЦЛЎЧЈвЦЕН TiDBЃЌвбОПЊЪМЪсРэвЕЮёЃЌзМБИеЙПЊВтЪдЃЛ

МЦЛЎдкКѓај TiDB ЕФЪЙгУжаЃЌTiKV ЗўЮёЦїГиЛЏЃЌАДашЗжХф TiKV НкЕуЁЃ

2ЁЂTiDB ЪЙгУГЩЙћ

РћгУ TiDB ЫЎЦНРЉеЙЬиадЃЌБмУтЗжПтЗжБэДјРДЕФЮЪЬтЃЌЪЙЕУвЕЮёПьЫйЕќДњЃЛ

TiDB МцШн MySQL гяЗЈКЭавщЃЌАДееФПЧАЯпЩЯ MySQL ЪЙгУЙцЗЖЃЌПЩвдЮоЗьЕФЧЈвЦЙ§ШЅЃЌЮоаш

RD зіЕїећЃЌЗћКЯдЄЦкЃЛ

дкЪ§ОнСПНЯДѓЕФЧщПіЯТЃЌTiDB ЯьгІНЯПьЃЌгХгк MySQLЃЛ

МЏШКГіЯжЙЪеЯЖдгУЛЇЮоИажЊЃЛ

TiDB здДјСЫЭъЩЦЕФМрПиЯЕЭГЃЌЪЙЕУдЫЮЌГЩБОДѓДѓНЕЕЭЁЃ |