| ���������ԭ��

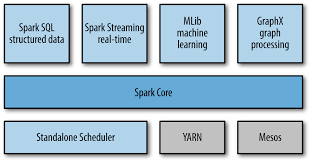

���ȣ�Ҫ�����Spark�ļ������������ԭ����ϵͳ�����ܵ�����̸��

ÿһ̨host������Բ���N��worker��ÿһ��worker������Բ���M��executor��task�ǻᱻ���䵽executor����ȥִ�С�Stageָ����һ�鲢�����е�task��stage�ڲ��Dz��ܳ���shuffle�ģ���Ϊshuffle�ľ������һ����ֹ�˲���task�����У�����shuffle����ζ�ŵ���stage�ı߽硣

CPU��core������ÿ��executor����ռ��һ������core������ͨ���۲�CPU��ʹ���ʱ仯���˽������Դ��ʹ����������磬�ܳ�����һ���˷���һ��executorռ���˶��core�������ܵ�CPUʹ����ȴ���ߣ���Ϊһ��executor�������ܳ�����ö�˵������������ʱ����Կ�����ô��executorռ�ø��ٵ�core��ͬʱworker�������Ӹ����executor������һ̨host�������Ӹ����worker�����Ӳ���ִ�е�executor���������Ӷ�����CPU�����ʡ���������executor��ʱ����Ҫ���Ǻ��ڴ����ģ���Ϊһ̨�������ڴ�����Խ���executor��ÿ��executor���ڴ��ԽС�����³��ֹ��������spill

over����out of memory�������

partition��parallelism��partitionָ�ľ������ݷ�Ƭ��������ÿһ��taskֻ�ܴ���һ��partition�����ݣ����ֵ̫С�˻ᵼ��ÿƬ������̫�����ڴ�ѹ�����������executor�ļ������������ó�֣��������̫������ᵼ�·�Ƭ̫�ִ࣬��Ч�ʽ��͡���ִ��action���Ͳ�����ʱ�������reduce��������partition��������ѡ��parent

RDD��������һ������parallelism��ָ������RDD����reduce�������ʱ��Ĭ�Ϸ������ݵ�paritition���������ڽ���map�������ʱ��partition����ͨ��ȡ��parent

RDD�нϴ��һ��������Ҳ�����漰shuffle��������parallelism�IJ���û��Ӱ�죩������˵������������������أ������漰�����ݷ�Ƭ�ģ����÷�ʽ��ʵ��ͳһ�ġ�ͨ��spark.default.parallelism��������Ĭ�ϵķ�Ƭ���������ܶ�RDD�IJ���������ָ��һ��partition��������ʽ���ƾ���ķ�Ƭ������

����������ԭ���Ͽ������ܼ�����ȴ�dz���Ҫ������Ӳ������������ѡ��ͬ��ȡֵ����Ҫȡһ����֮�ĺ������������Dz���ʵ�ġ��������������ӣ�

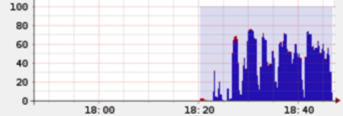

��1��ʵ�����ܵ�EMR Spark job���е��ر������鿴CPU�����ʺܵͣ����Ǿͳ��Լ���ÿ��executorռ��CPU

core�����������Ӳ��е�executor������ͬʱ������ӷ�Ƭ��������������CPU�������ʣ��ӿ����ݴ����ٶȡ�

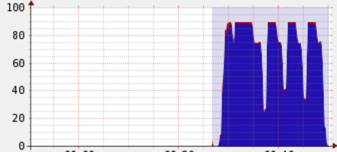

��2������ijjob���������ڴ���������Ǿ������Ƭ�������Ӷ�������ÿƬ���ݵĹ�ģ��ͬʱ�����ٲ��е�executor������������ͬ���ڴ���Դ������������ٵ�executor���൱��������ÿ��task���ڴ���䣬���������ٶȿ�������Щ�������ܱ�OOMǿ��

��3���������ر��٣��д�����С�ļ����ɣ��ͼ����ļ���Ƭ��û��Ҫ������ô��task��������������ֻ����ԭʼ��input�Ƚ�С��һ�㶼�ܱ�ע������ǣ����������������У�����Ӧ��ij��reduceBy����ij��filter�Ժ����ݴ������٣����ֵ�Ч����ͺ��ٱ������

����ٲ���һ�㣬���Ų��������õı仯�����ܵ�ƿ���DZ仯�ģ��ڷ��������ʱ��Ҫ���ǡ�������ÿ̨�����ϲ����executor�������ӵ�ʱ������һ��ʼ�����ӵģ�ͬʱҲ�۲쵽CPU��ƽ��ʹ���������ӣ��������ŵ�̨�����ϵ�executorԽ��Խ�࣬�����½��ˣ���Ϊ����executor���������ӣ������䵽ÿ��executor���ڴ�������С�����ڴ���ֱ�Ӳ�����Խ��Խ�٣�spill

over�������ϵ�����Խ��Խ�࣬��Ȼ���ܾͱ���ˡ�

���������һ��ֱ�۵����ӣ���ǰ�ܵ�cpu�����ʲ����ߣ�

���Ǿ�����������ԭ��ĵĵ���֮������������cpu�������������ˣ�

��Σ��漰���ܵ������Ǿ���Ҫ�����ã���Spark���������ֳ��������÷�ʽ����Ȼ��Щ�����������ǿ��Ի��������������Ϊ���ʵ����������Ҫ��ѭ��ͬ��������ʹ�ò�ͬ�����ã�

1.���û������������ַ�ʽ��Ҫ���ںͻ�����Ӳ����ص����ã�

2.�����в��������ַ�ʽ��Ҫ���ڲ�ͬ�ε����лᷢ���仯�IJ�������˫���߿�ͷ��

3.�������棨����Scala����ʽ���ã�SparkConf������������ͨ����application��������ã�һ�㲻�ı䡣

��һ�����õľ������ӡ�slave��worker��executor֮��ı������������Ǿ�����Ҫ�������е�executor����������ô��˵�����ַ�ʽ��

1.ÿ��worker��ʼ����һ��executor�����ǵ�����̨slave�ϲ��е�worker�����������磬SPARK_WORKER_INSTANCES��������ÿ��slave��worker�������������ڸı����������ʱ����ij�2��һ��Ҫ��Ӧ����SPARK_WORKER_CORES��ֵ����ÿ��workerʹ��ԭ��һ���core����������������workerһͬ������

2.ÿ̨slave��ʼ��ֻ����һ��worker������worker�ڲ�����executor����������YARN����²������������ʵ��executor�����ı�ģ�һ�ֵ��Ͱ취�ǣ�һ��hostֻ��һ��worker��Ȼ������spark.executor.coresΪhost��CPU

core��N��֮һ��ͬʱҲ����spark.executor.memoryΪhost�Ϸ����Spark�����ڴ��N��֮һ���������host�Ͼ��ܹ�����N��executor��

�е������ڲ�ͬ��MR���/�������Dz�һ���ģ�����YARN���еIJ�����Ĭ��ȡֵ�Ͳ�ͬ�������Ҫע�⡣

��ȷ��Щ�����������Ժ�����һ��һ����ܵ��ŵ�Ҫ�㡣

�ڴ�

Memory Tuning��Java�����ռ��ԭʼ����2~5����������Ŀռ䡣��õļ������ڴ����ĵİ취���Ǵ���RDD��Ȼ��ŵ�cache����ȥ��Ȼ����UI���濴storage�ı仯����ȻҲ����ʹ��SizeEstimator�����㡣ʹ��-XX:+UseCompressedOopsѡ�����ѹ��ָ�루8�ֽڱ��4�ֽڣ����ڵ���collect�ȵ�API��ʱ��ҲҪС�ġ�������������ڴ濽����ʱ������Ҫ������ڴ�Ҫ��һЩ������ϵͳ������20%��������Ҳ������OS��buffercache�����Ԥ����̫���ˣ�����������Ĵ���

�� Required executor memory (235520+23552

MB) is above the max threshold (241664 MB) of this cluster!

Please increase the value of ��yarn.scheduler.maximum-allocation-mb��.

���߸ɴ��û�������Ĵ�������Ȼ����Ϊ�ڴ治�㵼�µ����⣬�еĻ��о��棬���������

�� 16/01/13 23:54:48 WARN scheduler.TaskSchedulerImpl:

Initial job has not accepted any resources; check your

cluster UI to ensure that workers are registered and

have sufficient memory

�е�ʱ������������־�������������Ǽ���һЩ�����ԭ���executor��ʧ��Ϣ��

�� Exception in thread ��main�� org.apache.spark.SparkException:

Job aborted due to stage failure: Task 12 in stage 17.0

failed 4 times, most recent failure: Lost task 12.3

in stage 17.0 (TID 1257, ip-10-184-192-56.ec2.internal):

ExecutorLostFailure (executor 79 lost)

Reduce Task���ڴ�ʹ�á���ijЩ�����reduce task�ر������ڴ棬���統shuffle���ֵ�ʱ����sortByKey��groupByKey��reduceByKey��join�ȣ�Ҫ���ڴ����潨��һ�����hash

table������һ������취������level of parallelism������ÿ��task�������ģ����Ӧ��С�����⣬ע��shuffle���ڴ��������ã���ʱ�����㹻���ڴ棬����shuffle�ڴ治���Ļ�������Ҳ���ϲ�ȥ�ġ��������д�������join�Ȳ�����ʱ��shuffle���ڴ����������õ�executor��50%��

ע��ԭʼinput�Ĵ�С���кܶ����ʼ�ն�����Ҫij��ȫ���������ڴ�������ɵģ���ô����ƴ������parallelism��partition��ֵ�Ϳ����ڴ�ռ�ü��÷dz�С�ġ�����������ijЩ���ܵ�������OOM�����⣬�Ǹı����������������Ի���ġ����ǿ���ͨ������ÿ̨�������ڴ棬�������ӻ���������������ֱ�ӻ��������ڴ������������

��ѡ��EC2�������͵�ʱ��Ҫ��ȷƿ�������Խ��ɲ�������ȷ�������������������������ʹ��r3.8

xlarge��c3.8 xlargeѡ������⣬���������൱��ǰ�߱Ⱥ��߹�50%�������ڴ��Ǻ��ߵ�5����

���⣬��һЩRDD��API������cache��persist�����������ǿ�Ʒŵ��ڴ����棬���������ȷ�����������ĺô����Ͳ�Ҫ�����ǡ�

CPU

Level of Parallelism��ָ�����Ժ��ڽ���reduce���Ͳ�����ʱ��Ĭ��partition�������ͱ�ָ���ˡ����������ʵ�ʹ�����ͨ���DZز����ٵģ�һ�㶼Ҫ����input��ÿ��executor�ڴ�Ĵ�С��ȷ��������level

of parallelism��������spark.default.parallelism���ı䲢�м���ͨ����˵��ÿһ��CPU�˿��Է���2~3��task��

CPU core�ķ���ģʽ�ǹ������Ƕ�ռ����CPU���DZ�ͬһhost�ϵ�executor�������ǹϷֲ���ռ�����磬һ̨�����Ϲ���32��CPU

core����Դ��ͬʱ����������executor�����ڴ���50G����ôһ�ַ�ʽ������spark.executor.coresΪ16��spark.executor.memoryΪ20G�����������ڴ�����ƣ���̨�����ϻᲿ������executor��ÿ����ʹ��20G�ڴ棬���Ҹ�ʹ�á���ռ����16��CPU

core��Դ�������ڴ���Դ�����ǰ���£�Ҳ������������executor����������32��core�������ҵIJ��ԣ���ռģʽ������Ҫ�Ժ��빲��ģʽ��

GC���š���ӡGC��Ϣ��-verbose:gc -XX:+PrintGCDetails

-XX:+PrintGCTimeStamps��Ҫ�ǵ�Ĭ��60%��executor�ڴ���Ա�������ΪRDD�Ļ��棬���ֻ��40%���ڴ���Ա�������Ϊ�����Ŀռ䣬��һ�����ͨ������spark.storage.memoryFraction�ı䡣����кܶ�С������������Щ�����ڲ���ȫGC�Ĺ����оͿ��Ի��գ���ô����Eden������һ������������������HDFS�������ݣ��ڴ�������һ���Ĺ��㹫ʽ��������HDFS��block

size��64MB������������4��task�������ݣ�����ѹ��һ��blockҪ����3����С����ô�����ڴ����ľ��ǣ�4*3*64MB�����⣬������������������һ�����⣺GCĬ���������һ�����ƣ�Ĭ����GCʱ�䲻�ܳ���2%��CPUʱ�䣬�������������������Spark������׳��֣�����ģʽ����һ��RDDת��һ��RDD�����ͻᵼ�´�����GCʱ�䣬�Ӷ����֡�OutOfMemoryError:

GC overhead limit exceeded�����������������ͨ������-XX:-UseGCOverheadLimit�ص�����

���л��ʹ���

Data Serialization��Ĭ��ʹ�õ���Java Serialization���������Ա����Ϥ���������ܡ��ռ���ֶ��Ƚϲ����һ��ѡ����Kryo

Serialization�����죬ѹ����Ҳ���ߣ����Dz���֧������������л�����Spark UI���ܹ��������л�ռ����ʱ�俪���ı����������������ߵĻ����Կ����Ż��ڴ�ʹ�ú����л���

Broadcasting Large Variables����taskʹ�þ�̬������ʱ������broadcast��ȥ��Spark���ӡ���л���Ĵ�С��ͨ����˵���������20KB��ֵ����ô������һ�ֳ��������ǣ�һ�����joinһ��С������С��broadcast��������ݾͲ���Ҫ�ڸ���node֮����ܣ����������ش��ڱ��ص�С��broadcast�����ͺ��ˡ�

Data Locality�����ݺʹ���Ҫ�ŵ�һ����ܴ�����ͨ�������ܱ�����ҪСһЩ����˰Ѵ����͵���������졣Data

Locality�����ݺʹ����Ĵ���������ռ��Ͻӽ��ij̶ȣ�PROCESS_LOCAL��ͬһ��JVM����NODE_LOCAL��ͬһ��node������������HDFS�ϣ����Ǻʹ�����ͬһ��node����NO_PREF��RACK_LOCAL������ͬһ��server������ͬһ�����ܣ���ANY����Ȼ���ȼ��Ӹߵ��ͣ���������ڿ��е�executor����û��δ���������ˣ���ô��������ѡ��

��1��Ҫô�����æ��CPU���������������ܡ����ء������ݣ�

��2��Ҫô�Ͳ���ֱ������taskȥ�������Զ�̵����ݡ�

Ĭ�ϵ������������Spark���һ�����spark.locality���������ԣ�1���������æ��CPUͣ���������ͻ�ִ�в��ԣ�2����

������Դ��������á���task�������ô�����ʱ��ҪС�ģ���Ϊ��������task���л���ÿ���ڵ���ȥ�������������⡣ֻҪ���л��Ĺ��̲��׳��쳣�����ö������л���������ʵ�Ϻ��ٱ������ӡ��������������ȷʵ����Ҫ�ģ���ô�Ͳ���ɴ�������RDD���ˡ��������ʱ���ڴ��������л���Ϊ���Dz�֪���������ģ�����˵��Ԥ��֮��ģ����������ǵ���Ŀ��������һ�δ��룺

rdd.map(r => {

println(BackfillTypeIndex)

}) |

��ʵ�أ����ȼ���������

rdd.map(r => {

println(this.BackfillTypeIndex)

}) |

��ҪС�������this����ʱ���������л��Ƿdz���Ŀ�����

�������������⣬һ����ֱ�ӵĽ���������ǣ�

val dereferencedVariable = this.BackfillTypeIndex

rdd.map(r => println(dereferencedVariable)) // "this" is not serialized |

��صأ�ע��@transient������ʶij������Ҫ�����л�������ڽ����������л����������ų����Ǻ����õġ����⣬ע��class֮��ļ̳в㼶��ϵ����ʱ��һ��С��case

class��������һ�ô�����

�ļ���д

�ļ��洢�Ͷ�ȡ���Ż����������һЩcase���ԣ����ֻ��Ҫij���У�ʹ��rcfile��parquet�����ĸ�ʽ��������ļ���ȡ�ɱ������о��Ǵ洢�ļ���S3�ϻ���HDFS�ϣ����Ը������ѡ������ʵĸ�ʽ������ѹ���ʸ��ߵĸ�ʽ�����⣬�ر��Ƕ���shuffle�ر����������������һ�����Ķ����ڴ������ϵͳ��Ϊ����ϵͳ��buffer

cache�������ܹ�50G���ڴ棬JVM�����䵽40G��һ�㡣

�ļ���Ƭ��������S3�����֧���ļ��Է�Ƭ��ʽ��ţ�����partXX��ʹ��coalesce���������÷ֳɶ���Ƭ����������ɲ��м��������������������߶�д���ܡ�����̫��̫�Ͷ����ã�̫����û���������S3���ж�д��������̫��������С�ļ�̫�࣬Ԥ�������ϲ������ӽ����ȵȶ���ʱ�俪��������д�����׳���throttle��

����

Spark��Speculation��ͨ������spark.speculation�ȼ������ѡ�������Spark�ڷ���ijЩtaskִ���ر�����ʱ�����ڲ��ȴ���ɵ�����±�����ִ�У������ͬ��taskֻҪ��һ��ִ�����ˣ���ô���ִ������Ǹ�����ͻᱻ���ɡ�

����Shuffle����ʵSpark�ļ��������ܿ죬���Ǵ������������������IO���棬��shuffle����һ�����͡��ٸ����ӣ����(k,

v1) join (k, v2) => (k, v3)����ô�����������ʵSpark���Ż��÷dz��õģ���Ϊ��Ҫjoin�Ķ���һ��node��һ��partition���棬join�ܿ���ɣ����Ҳ����ͬһ��node����һϵ�в������Ա�����ͬһ��stage���棩������������ݽṹ�����Ϊ(obj1)

join (obj2) => (obj3)�������е�join����Ϊobj1.column1 ==

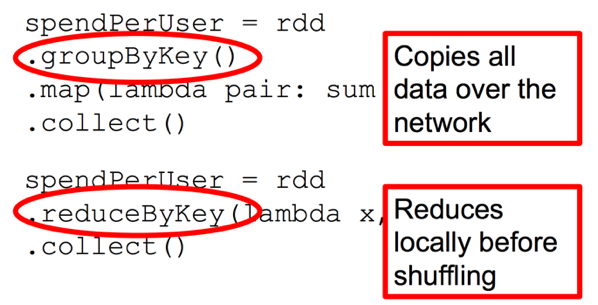

obj2.column1�����ʱ�������ͱ���shuffle�ˣ���Ϊ������ͬһ��keyʹ��������ͬһ��node�ϵ�ǿ��֤����һ��Ҫshuffle������£������ܼ���shuffleǰ�����ݹ�ģ�������������groupByKey�����ӡ���������Ƚϵ�ͼƬ����Spark

Summit 2013��һ���ݽ���������ͬһ�����飺

Repartition�����������������ʱ��ʱС��ѡ����ʵ�partition������ϵ�ش����̫��partition�͵����кܶ�С����Ϳ�������������̫������������Դû��������ã���Ҫʱ�����ʹ��repartition��������������Ҳ����û�д��۵ģ�����һ������Ҫ���۾���shuffle������һ���������������ݴ�С����̫�����������Ҫ�����ݵ�partition��key��ʵȡֵ����������ɵģ�Ĭ��ʹ��HashPartitioner������Ҫ�Ľ���һ�㣬������дhash�㷨�����Ե�ʱ����֪��partition���������Ե���rdd.partitions().size()��֪��

Taskʱ��ֲ�����עSpark UI����Stage������ҳ���ϣ����Կ��õ�shuffleд���ܿ�����GCʱ�䣬��ǰ����ջ������task��ʱ�仨�ѡ�����㷢��task��ʱ�仨�ѷֲ�̫ɢ������˵�еĻ���ʱ��ܳ����еḷ́ܶ����˵������ֲ���������Ҫ�����������ݷ�Ƭ��key��hash��task�ڲ��ļ������ȵȣ�ƿ�������ں�ʱ����task���档

������Դ���е���Դ���뿪�����������൱���ޣ����罨�����ӣ����Կ�����partition������ʱ��ʹ����ã�����ʹ��mapPartition����������������ÿ��partition�ڵ�ÿ��Ԫ�صIJ�������ֻҪ����������Ӿͺ��ˣ�����Ҫ���½������ӡ�

|