| БрМЭЦМі: |

БОЮФРДздгкcnblogsЃЌЮФеТжївЊАИР§ЮЊжїРДНщЩмActiveMQЯћЯЂЕФЯћЗбдРэЃЌДгЗНЗЈЕНЙ§ГЬвдМАЗНАИЕШЗНУцЯъЯИНщЩмЁЃ

|

|

ЯћЗбЖЫЯћЗбЯћЯЂЃК

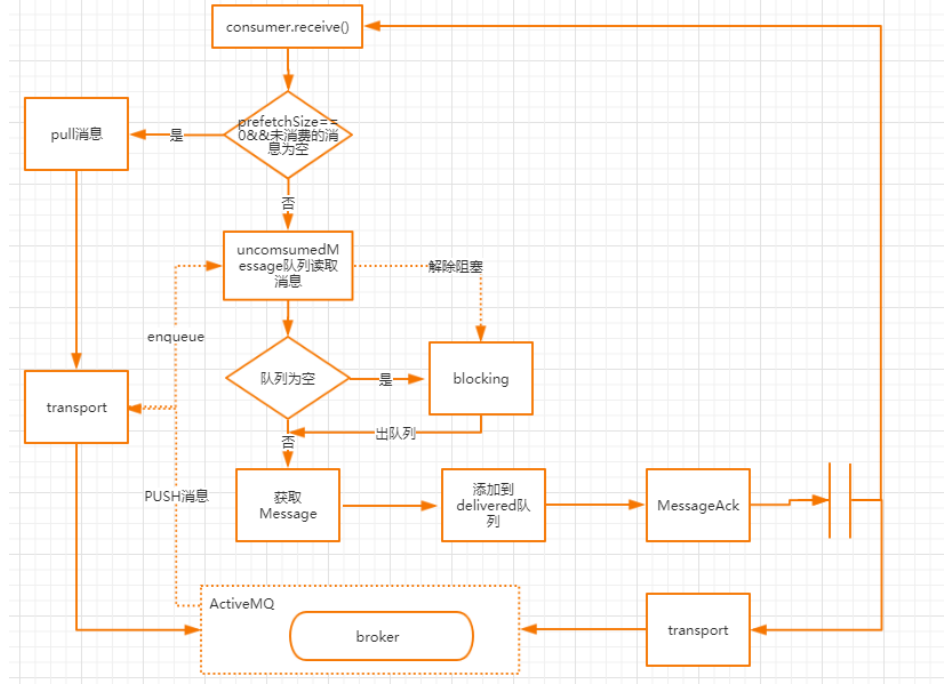

етРяЫЕСЫСНжжЗНЗЈЃЌСНжжЗНЗЈПЩвдНгЪеЯћЯЂЃЌвЛжжЪЧЪЙгУЭЌВНзшШћЕФActiveMQMessageConsumer#receiveЗНЗЈЁЃСэвЛжжЪЧЪЙгУЯћЯЂМрЬ§ЦїMessageListenerЁЃетРяашвЊзЂвтЕФЪЧЃЌдкЭЌвЛИіsessionЯТЃЌетСНепВЛФмЭЌЪБЙЄзїЃЌвВОЭЪЧЫЕВЛФмеыЖдВЛЭЌЯћЯЂВЩгУВЛЭЌЕФНгЪеЗНЪНЁЃЗёдђЛсХзГівьГЃЁЃжСгкЮЊЪВУДетУДзіЃЌзюДѓЕФдвђЛЙЪЧдкЪТЮёадЛсЛАжаЃЌСНжжЯћЗбФЃЪНЕФЪТЮёВЛКУЙмПиЁЃ

ЯШЭЈЙ§ActiveMQMessageConsumer#receive ЗНЗЈРДЖдЯћЯЂЕФНгЪмвЛЬНОПОЙЃК

public Message

receive() throws JMSException {

checkClosed();

//МьВщreceiveКЭMessageListenerЪЧЗёЭЌЪБХфжУдкЕБЧАЕФЛсЛАжаЃЌгадђХзГівьГЃ

checkMessageListener();

//ШчЙћPrefetchSizeSizeЮЊ0ВЂЧвunconsumerMessageЮЊПеЃЌдђЗЂЦ№pullУќСю

sendPullCommand(0);

MessageDispatch md = dequeue(-1);//ГіСаЃЌЛёШЁЯћЯЂ

if (md == null) {

return null;

}

beforeMessageIsConsumed(md);

//ЗЂЫЭackИјЕНbroker

afterMessageIsConsumed(md, false);

//ЛёШЁЯћЯЂВЂЗЕЛи

return createActiveMQMessage(md);

} |

ЯТУцМђЕЅЕФЫЕвЛЯТвдЩЯМИИіКЫаФЗНЗЈжазіСЫЪВУДВЛЮЊШЫжЊЕФЪТЃК

sendPullCommand(0) ЃКЗЂЫЭpullУќСюДгbrokerЩЯЛёШЁЯћЯЂЃЌЧАЬсЪЧprefetchSize=0ВЂЧвunconsumedMessagesЮЊПеЁЃunconsumedMessageБэЪОЮДЯћЗбЕФЯћЯЂЃЌетРяУцдЄЖСШЁЕФЯћЯЂДѓаЁЮЊprefetchSizeЕФжЕ

protected void

sendPullCommand(long timeout) throws JMSException

{

clearDeliveredList();

if (info.getCurrentPrefetchSize() == 0 &&

unconsumedMessages.isEmpty()) {

MessagePull messagePull = new MessagePull();

messagePull.configure(info);

messagePull.setTimeout(timeout);

//ЯђЗўЮёЖЫвьВНЗЂЫЭmessagePullжИСю

session.asyncSendPacket(messagePull);

}

} |

етРяЗЂЫЭвьВНЯћЯЂИњЯћЯЂЩњВњЕФдРэЪЧвЛбљЕФЁЃЭЈЙ§АќзАСДШЅЕїгУ Sokect ЗЂЫЭЧыЧѓЁЃ

clearDeliveredList()ЃК

дкЩЯУцЕФsendPullCommandЗНЗЈжаЃЌЛсЯШЕїгУclearDeliveredListЗНЗЈЃЌжївЊгУРДЧхРэвбОЗжЗЂЕФЯћЯЂСДБэdeliveredMessagesdeliveredMessagesЃЌДцДЂЗжЗЂИјЯћЗбепЕЋЛЙЮЊгІД№ЕФЯћЯЂСДБэ

ШчЙћsessionЪЧЪТЮёЕФЃЌдђЛсБщРњdeliveredMessageжаЕФЯћЯЂЗХШыЕНpreviouslyDeliveredMessageжаРДзіжиЗЂ

ШчЙћsessionЪЧЗЧЪТЮёЕФЃЌИљОнACKЕФФЃЪНРДбЁдёВЛЭЌЕФгІД№Вйзї

етЪЧИіЭЌВНЕФЙ§ГЬЃК

private void

clearDeliveredList() {

if (clearDeliveredList) {//ХаЖЯЪЧЗёЧхГў

synchronized (deliveredMessages) {//ВЩгУЫЋжиМьВщЫј

if (clearDeliveredList) {

if (!deliveredMessages.isEmpty()) {

if (session.isTransacted()) {//ЪЧЪТЮёЯћЯЂ

if (previouslyDeliveredMessages == null) {

previouslyDeliveredMessages = new PreviouslyDeliveredMap<MessageId,

Boolean>(session.getTransactionContext ().getTransactionId());

}

for (MessageDispatch delivered : deliveredMessages)

{

previouslyDeliveredMessages.put (delivered.getMessage().getMessageId(),

false);

}

LOG.debug("{} tracking existing transacted

{} delivered list ({}) on transport interrupt",

getConsumerId(), previouslyDeliveredMessages.transactionId,

deliveredMessages.size());

} else {

if (session.isClientAcknowledge()) {

LOG.debug("{} rolling back delivered list

({}) on transport interrupt", getConsumerId(),

deliveredMessages.size());

// allow redelivery

if (!this.info.isBrowser()) {

for (MessageDispatch md: deliveredMessages) {

this.session.connection.rollbackDuplicate (this,

md.getMessage());

}

}

}

LOG.debug("{} clearing delivered list ({})

on transport interrupt", getConsumerId(),

deliveredMessages.size());

deliveredMessages.clear();

pendingAck = null;

}

}

clearDeliveredList = false;

}

}

}

} |

dequeue(-1) ЃКДгunconsumedMessageжаШЁГівЛИіЯћЯЂЃЌдкДДНЈвЛИіЯћЗбепЪБЃЌОЭЛсЮЊетИіЯћЗбепДДНЈвЛИіЮДЯћЗбЕФЯћЯЂЭЈЕРЃЌетИіЭЈЕРЗжЮЊСНжжЃЌвЛжжЪЧМђЕЅгХЯШМЖЖгСаЗжЗЂЭЈЕРSimplePriorityMessageDispatchChannel

ЃЛСэвЛжжЪЧЯШНјЯШГіЕФЗжЗЂЭЈЕРFifoMessageDispatchChannel.жСгкЮЊЪВУДвЊДцдкетбљвЛИіЯћЯЂЗжЗЂЭЈЕРЃЌДѓМвПЩвдЯыЯѓвЛЯТЃЌШчЙћЯћЗбепУПДЮШЅЯћЗбЭъвЛИіЯћЯЂвдКѓдйШЅbrokerФУвЛИіЯћЯЂЃЌаЇТЪЪЧБШНЯЕЭЕФЁЃЫљвдЭЈЙ§етбљЕФЩшМЦПЩвддЪаэsessionФмЙЛвЛДЮадНЋЖрЬѕЯћЯЂЗжЗЂИјвЛИіЯћЗбепЁЃФЌШЯЧщПіЯТЖдгкqueueРДЫЕЃЌprefetchSizeЕФжЕЪЧ1000

private MessageDispatch

dequeue (long timeout) throws JMSException {

try {

long deadline = 0;

if (timeout > 0) {

deadline = System.currentTimeMillis() + timeout;

}

while (true) {//protected final MessageDispatchChannel

unconsumedMessages;

MessageDispatch md = unconsumedMessages.dequeue(timeout);

...........

} |

beforeMessageIsConsumed(md)ЃКетРяУцжївЊЪЧзіЯћЯЂЯћЗбжЎЧАЕФвЛаЉзМБИЙЄзїЃЌШчЙћACKРраЭВЛЪЧDUPS_OK_ACKNOWLEDGEЛђепЖгСаФЃЪНЃЈМђЕЅРДЫЕОЭЪЧГ§СЫTopicКЭDupAckетСНжжЧщПіЃЉЃЌЫљгаЕФЯћЯЂЯШЗХЕНdeliveredMessagesСДБэЕФПЊЭЗЁЃВЂЧвШчЙћЕБЧАЪЧЪТЮёРраЭЕФЛсЛАЃЌдђХаЖЯtransactedIndividualAckЃЌШчЙћЮЊtrueЃЌБэЪОЕЅЬѕЯћЯЂжБНгЗЕЛиackЁЃ

ЗёдђЃЌЕїгУackLaterЃЌХњСПгІД№, clientЖЫдкЯћЗбЯћЯЂКѓднЧвВЛЗЂЫЭACKЃЌЖјЪЧАбЫќЛКДцЯТРД(pendingACK)ЃЌЕШЕНетаЉЯћЯЂЕФЬѕЪ§ДяЕНвЛЖЈЗЇжЕЪБЃЌжЛашвЊЭЈЙ§вЛИіACKжИСюАбЫќУЧШЋВПШЗШЯЃЛетБШЖдУПЬѕЯћЯЂЖМж№ИіШЗШЯЃЌдкадФмЩЯвЊЬсИпКмЖрЁЃ

private void

beforeMessageIsConsumed(MessageDispatch md) throws

JMSException {

md.setDeliverySequenceId(session.getNextDeliveryId());

lastDeliveredSequenceId = md.getMessage().getMessageId().getBrokerSequenceId();

if (!isAutoAcknowledgeBatch()) {

synchronized(deliveredMessages) {

deliveredMessages.addFirst(md);

}

if (session.getTransacted()) {

if (transactedIndividualAck) {

immediateIndividualTransactedAck(md);

} else {

ackLater(md, MessageAck.DELIVERED_ACK_TYPE);

}

}

}

}ЁЁ |

afterMessageIsConsumedЃКетИіЗНЗЈЕФжївЊзїгУЪЧжДаагІД№ВйзїЃЌетРяУцзівдЯТМИИіВйзї

1.ШчЙћЯћЯЂЙ§ЦкЃЌдђЗЕЛиЯћЯЂЙ§ЦкЕФack

2. ШчЙћЪЧЪТЮёРраЭЕФЛсЛАЃЌдђВЛзіШЮКЮДІРэ

3. ШчЙћЪЧAUTOACKЛђепЃЈDUPS_OK_ACKЧвЪЧЖгСаЃЉЃЌВЂЧвЪЧгХЛЏackВйзїЃЌдђзпХњСПШЗШЯack

4.ШчЙћЪЧDUPS_OK_ACKЃЌдђзпackLaterТпМ

5.ШчЙћЪЧCLIENT_ACKЃЌдђжДааackLater

private void

afterMessageIsConsumed(MessageDispatch md, boolean

messageExpired) throws JMSException {

if (unconsumedMessages.isClosed()) {

return;

}

if (messageExpired) {

acknowledge(md, MessageAck.EXPIRED_ACK_TYPE);

stats.getExpiredMessageCount().increment();

} else {

stats.onMessage();

if (session.getTransacted()) {

// Do nothing.

} else if (isAutoAcknowledgeEach()) {

if (deliveryingAcknowledgements.compareAndSet(false,

true)) {

synchronized (deliveredMessages) {

if (!deliveredMessages.isEmpty()) {

if (optimizeAcknowledge) {

ackCounter++;

// AMQ-3956 evaluate both expired and normal msgs

as

// otherwise consumer may get stalled

if (ackCounter + deliveredCounter >= (info.getPrefetchSize()

* .65) || (optimizeAcknowledgeTimeOut > 0 &&

System.currentTimeMillis() >= (optimizeAckTimestamp

+ optimizeAcknowledgeTimeOut))) {

MessageAck ack = makeAckForAllDeliveredMessages (MessageAck.STANDARD_ACK_TYPE);

if (ack != null) {

deliveredMessages.clear();

ackCounter = 0;

session.sendAck(ack);

optimizeAckTimestamp = System.currentTimeMillis();

}

// AMQ-3956 - as further optimization send

// ack for expired msgs when there are any.

// This resets the deliveredCounter to 0 so that

// we won't sent standard acks with every msg

just

// because the deliveredCounter just below

// 0.5 * prefetch as used in ackLater()

if (pendingAck != null && deliveredCounter

> 0) {

session.sendAck(pendingAck);

pendingAck = null;

deliveredCounter = 0;

}

}

} else {

MessageAck ack = makeAckForAllDeliveredMessages (MessageAck.STANDARD_ACK_TYPE);

if (ack!=null) {

deliveredMessages.clear();

session.sendAck(ack);

}

}

}

}

deliveryingAcknowledgements.set(false);

}

} else if (isAutoAcknowledgeBatch()) {

ackLater(md, MessageAck.STANDARD_ACK_TYPE);

} else if (session.isClientAcknowledge() ||session.isIndividualAcknowledge())

{

boolean messageUnackedByConsumer = false;

synchronized (deliveredMessages) {

messageUnackedByConsumer = deliveredMessages.contains(md);

}

if (messageUnackedByConsumer) {

ackLater (md, MessageAck.DELIVERED_ACK_TYPE);

}

}

else {

throw new IllegalStateException("Invalid

session state.");

}

}

}ЁЁ |

ЦфЪЕдквдЩЯЯћЯЂЕФНгЪеЙ§ГЬжаЃЌЮвУЧНіНіФмПДЕНетИіЯћЯЂДгвЛИіБОЕиБфСПжаГіЖгЃЌВЂУЛгаЖддЖГЬЯћЯЂжааФЗЂЫЭЭЈбЖЛёШЁЃЌФЧУДетИіЯћЯЂЪБЪВУДЪБКђЙ§РДЕФФиЃПвВОЭЪЧЯћЯЂГіЖгжа

unconsumedMessages етИіЖЋЖЋЪБЪВУДЪБКђГѕЪМЛЏЕФФи ЃПФЧУДНгЯТШЅЮвУЧгІИУШЅЭЈЙ§ДДНЈСЌНгЕФЪБКђШЅПДПДСЫЃЌОпЬхСЌНгЕФЪБКђЖМзіСЫЪВУДФиЃКconnectionFactory.createConnection()

private void

afterMessageIsConsumed (MessageDispatch md, boolean

messageExpired) throws JMSException {

protected ActiveMQConnection createActiveMQConnection(String

userName, String password) throws JMSException

{

if (brokerURL == null) {

throw new ConfigurationException("brokerURL

not set.");

}

ActiveMQConnection connection = null;

try {// ЙћШЛЗЂЯжСЫетИіЖЋЖЋЕФГѕЪМЛЏ

Transport transport = createTransport();

// ДДНЈСЌНг

connection = createActiveMQConnection(transport,

factoryStats);

// ЩшжУгУЛЇУмТы

connection.setUserName(userName);

connection.setPassword(password);

// ЖдСЌНгзіАќзА

configureConnection(connection);

// ЦєЖЏвЛИіКѓЬЈДЋЪфЯпГЬ

transport.start();

// ЩшжУПЭЛЇЖЫЯћЗбЕФid

if (clientID != null) {

connection.setDefaultClientID(clientID);

}

return connection;

} ......

} |

ДДНЈСЌНгЕФЙ§ГЬОЭЪЧДДНЈГ§СЫвЛИіДјгаСДТЗАќзАЕФTcpTransport

ВЂЧвДДНЈСЌНгЃЌзюКѓЦєЖЏвЛИіДЋЪфЯпГЬЃЌЖјетРяЕФ transport.start() ЕїгУЕФгІИУЪЧTcpTransport

РяУцЕФЗНЗЈЃЌШЛЖјетИіРржаВЂУЛга startЃЌЖјЪЧдкИИРр

ServiceSupport.start()жаЃК

public void

start() throws Exception {

if (started.compareAndSet(false, true)) {

boolean success = false;

stopped.set(false);

try {

preStart();//вЛаЉГѕЪМЛЏ

doStart();

success = true;

} finally {

started.set(success);

}

for(ServiceListener l:this.serviceListeners) {

l.started(this);

}

}

} |

doStart ЗНЗЈЧАзіСЫвЛЯЕСаЕФГѕЪМЛЏЃЌШЛКѓЕїгУ TcpTransportЕФdoStart()

ЗНЗЈЃК

protected void

doStart() throws Exception {

connect();

stoppedLatch.set(new CountDownLatch(1));

super.doStart();

} |

МЬЖјЙЙНЈвЛИіСЌНг ЩшжУвЛИі CountDownLatch УХуХ ЃЌЕїгУИИРр

TransportThreadSupport ЕФЗНЗЈЃЌаТНЈСЫвЛИіОЋСщЯпГЬВЂЧвЦєЖЏЃК

protected void

doStart() throws Exception {

runner = new Thread(null, this, "ActiveMQ

Transport: " + toString(), stackSize);

runner.setDaemon(daemon);

runner.start();

} |

ЕїгУTransportThreadSupport.doStart().

ДДНЈСЫвЛИіЯпГЬЃЌДЋШыЕФЪЧ thisЃЌЕїгУзгРрЕФ run ЗНЗЈЃЌвВОЭЪЧ TcpTransport.run().

public void

run() {

LOG.trace("TCP consumer thread for "

+ this + " starting");

this.runnerThread=Thread.currentThread();

try {

while (!isStopped()) {

doRun();

}

} catch (IOException e) {

stoppedLatch.get().countDown();

onException(e);

} catch (Throwable e){

stoppedLatch.get().countDown();

IOException ioe=new IOException("Unexpected

error occurred: " + e);

ioe.initCause(e);

onException(ioe);

}finally {

stoppedLatch.get().countDown();

}

} |

run ЗНЗЈжївЊЪЧДг socket жаЖСШЁЪ§ОнАќЃЌжЛвЊ TcpTransport

УЛгаЭЃжЙЃЌЫќОЭЛсВЛЖЯШЅЕїгУ doRunЃКетРяУцЃЌЭЈЙ§ wireFormat ЖдЪ§ОнНјааИёЪНЛЏЃЌПЩвдШЯЮЊетЪЧвЛИіЗДађСаЛЏЙ§ГЬЁЃwireFormat

ФЌШЯЪЕЯжЪЧ OpenWireFormatЃЌactiveMQ здЖЈвхЕФПчгябдЕФwire авщ

protected void

doRun() throws IOException {

try {//ЭЈЙ§ readCommand ШЅЖСШЁЪ§Он

Object command = readCommand();

//ЯћЗбЯћЯЂ

doConsume(command);

} catch (SocketTimeoutException e) {

} catch (InterruptedIOException e) {

}

}

protected Object readCommand() throws IOException

{

return wireFormat.unmarshal(dataIn);

} |

doConsumeЃКСїГЬзпЕНСЫЯћЗбЯћЯЂЃК

public void

doConsume(Object command) {

if (command != null) {//БэЪОвбОФУЕНСЫЯћЯЂ

if (transportListener != null) {

transportListener.onCommand(command);

} else {

LOG.error("No transportListener available

to process inbound command: " + command);

}

}

} |

TransportSupport РржаЮЈвЛЕФГЩдББфСПЪЧ TransportListener

transportListener;ЃЌетвВвтЮЖзХвЛИі Transport жЇГжРрАѓЖЈвЛИіДЋЫЭМрЬ§ЦїРрЃЌДЋЫЭМрЬ§ЦїНгПк

TransportListener зюживЊЕФЗНЗЈОЭЪЧ void onCommand(Object command);ЃЌЫќгУРДДІРэУќСюЁЃФЧУДетИі

transportListener ЪЧдкФЧРяГѕЪМЛЏЕФФиЃППЩвдЫМПМвЛЯТ МШШЛЪЧTransportSupport

ЮЈвЛЕФГЩдББфСПЃЌЖјЮвУЧЫјДДНЈЕФTcpTransport ЪЧЫћЕФзгРрЃЌФЧУДЪЧВЛЪЧдкДДНЈИУtransportЕФЪБКђврЛђЪЧдкЖдЫћНјааАќзАДІРэЕФЪБКђзіСЫГѕЪМЛЏФиЃП

ЮвУЧЛсдкСїГЬжаПДЕНдкаТНЈ ActiveMQConnectionFactory ЕФЪБКђгавЛааЙиМќЕФДњТыЃК

| connection =

createActiveMQConnection(transport, factoryStats); |

дкетИіЗНЗЈСљУцзЗЫнЯТШЅЃКЛсНјШы ActiveMQConnection

ЕФЙЙдьЗНЗЈ

protected ActiveMQConnection (final

Transport transport, IdGenerator clientIdGenerator,

IdGenerator connectionIdGenerator, JMSStatsImpl

factoryStats) throws Exception {

this.transport = transport;

this.clientIdGenerator = clientIdGenerator;

this.factoryStats = factoryStats;

// Configure a single threaded executor who's

core thread can timeout if

// idle

executor = new ThreadPoolExecutor (1, 1, 5, TimeUnit.SECONDS,

new LinkedBlockingQueue<Runnable>(), new

ThreadFactory() {

@Override

public Thread newThread(Runnable r) {

Thread thread = new Thread(r, "ActiveMQ Connection

Executor: " + transport);

//Don't make these daemon threads - see https://issues.apache.org/jira/browse/AMQ-796

//thread.setDaemon(true);

return thread;

}

});

// asyncConnectionThread.allowCoreThreadTimeOut(true);

String uniqueId = connectionIdGenerator.generateId();

this.info = new ConnectionInfo (new ConnectionId(uniqueId));

this.info.setManageable(true);

this.info.setFaultTolerant (transport.isFaultTolerant());

this.connectionSessionId = new SessionId(info.getConnectionId(),

-1);

this.transport.setTransportListener(this);

this.stats = new JMSConnectionStatsImpl (sessions,

this instanceof XAConnection);

this.factoryStats.addConnection(this);

this.timeCreated = System.currentTimeMillis();

this.connectionAudit.setCheckForDuplicates (transport.isFaultTolerant());

} |

ДгвдЩЯДњТыЮвУЧЗЂЯж this.transport.setTransportListener(this);

ФЧУДетИіthisЪЧЪВУДФи ЃП е§ЪЧActiveMQConnection ЃЌПДСЫвЛблИУРрЃЌЗЂЯжетИіРрЪЕЯжСЫ

TransportListener ЃЌБОЩэОЭЪЧвЛИіTransportListenerЁЃЫљвдЩЯУц transportListener.onCommand(command);

ОЭЪЧ ActiveMQConnection.onCommand(command)ЁЃГ§СЫКЭ TransportЯрЛЅАѓЖЈЃЌЛЙЖдЯпГЬГижДааЦї

executor НјааСЫГѕЪМЛЏЁЃетИчжДааЦїЪЧКѓРДвЊНјааЯћЯЂДІРэЕФЁЃ

етРяУцЛсеыЖдВЛЭЌЕФЯћЯЂзіЗжЗЂЃЌдкActiveMQMessageConsumer#receiveЗНЗЈжаЫјdequeueЫљЗЕЛиЕФЖдЯѓЪЧMessageDispatch

ЁЃМйЩшетРяДЋШыЕФ command ЪЧMessageDispatchЃЌФЧУДетИі command ЕФ visit

ЗНЗЈОЭЛсЕїгУprocessMessageDispatch ЗНЗЈЁЃМєЧаГіЦфжаЕФДњТыЦЌЖЮЃК

public Response

processMessageDispatch (MessageDispatch md) throws

Exception {

// ЕШД§ Transport жаЖЯДІРэЭъГЩ

waitForTransportInterruptionProcessingToComplete();

// етРяЭЈЙ§ЯћЗбеп ID РДЛёШЁЯћЗбепЖдЯѓ

//ЃЈActiveMQMessageConsumer ЪЕЯжСЫ ActiveMQDispatcher

НгПкЃЉЃЌЫљвд

//MessageDispatch АќКЌСЫЯћЯЂгІИУБЛЗжХфЕНФЧИіЯћЗбепЕФгГЩфаХЯЂ

ActiveMQDispatcher dispatcher = dispatchers.get(md.getConsumerId());

if (dispatcher != null) {

// Copy in case a embedded broker is dispatching

via

// vm://

// md.getMessage() == null to signal end of queue

// browse.

Message msg = md.getMessage();

if (msg != null) {

msg = msg.copy();

msg.setReadOnlyBody(true);

msg.setReadOnlyProperties(true);

msg.setRedeliveryCounter(md.getRedeliveryCounter());

msg.setConnection(ActiveMQConnection.this);

msg.setMemoryUsage(null);

md.setMessage(msg);

}

// ЕїгУЛсЛАActiveMQSession здМКЕФ dispatch ЗНЗЈРДДІРэетЬѕЯћЯЂ

dispatcher.dispatch(md);

} else {

LOG.debug("{} no dispatcher for {} in {}",

this, md, dispatchers);

}

return null;

} |

Цфжа ActiveMQDispatcher dispatcher =

dispatchers.get(md.getConsumerId());етааДњТыЕФ dispatchers

ЪЧдк ЭЈЙ§session.createConsumer(destination); ЕФЪБКђЭЈЙ§ ActiveMQMessageConsumer

ЕФЙЙдьЗНЗЈжагавЛааДњТы ЃКthis.session.addConsumer(this); НЋ thisДЋШыЃЌМД

ActiveMQMessageConsumer ЖдЯѓЁЃЖјетИі addConsumer ЗНЗЈЃК

protected void

addConsumer (ActiveMQMessageConsumer consumer)

throws JMSException {

this.consumers.add(consumer);

if (consumer.isDurableSubscriber()) {

stats.onCreateDurableSubscriber();

}

this.connection.addDispatcher(consumer.getConsumerId(),

this);

} |

ПЩвдЗЂЯжетРяЕФГѕЪМЛЏСЫЃКthis.connection.addDispatcher(consumer.getConsumerId(),

this); етРяЕФthis МД ActiveMQSessionЁЃЫљвдЛиЕН ActiveMQConnection#onCommandЗНЗЈФк

processMessageDispatch етИіЗНЗЈзюКѓЕїгУСЫ dispatcher.dispatch(md);

етИіЗНЗЈЕФКЫаФЙІФмОЭЪЧДІРэЯћЯЂЕФЗжЗЂЁЃЃК

public void

dispatch(MessageDispatch messageDispatch) {

try {

executor.execute(messageDispatch);

} catch (InterruptedException e) {

Thread.currentThread().interrupt();

connection.onClientInternalException(e);

}

} |

етРяРыЮвУЧеце§вЊевЕФНјааЯћЯЂШыЖгЕФНсЙћКмНќСЫЃЌНјШыexecutor.execute(messageDispatch);етИіЗНЗЈЃК

void execute(MessageDispatch

message) throws InterruptedException {

...........

//ШчЙћЛсЛАВЛЪЧвьВНЗжЗЂВЂЧвУЛгаЪЙгУ sessionpool ЗжЗЂЃЌдђЕїгУ dispatch

ЗЂЫЭЯћЯЂ

if (!session.isSessionAsyncDispatch() &&

!dispatchedBySessionPool) {

dispatch(message);

} else {//НЋЯћЯЂжБНгЗХЕНЖгСаРя

messageQueue.enqueue(message);

wakeup();

}

} |

етРязюКѓжегкЗЂЯжСЫШыЖгЃЌХаЖЯЪЧЗёвьВНЗжЗЂЃЌВЛЪЧЕФЛАзпdispatch(message)

ЗёдђНјШывьВНЗжЗЂЁЃФЌШЯЪЧВЩгУвьВНЯћЯЂЗжЗЂЁЃЫљвдЃЌжБНгЕїгУ messageQueue.enqueueЃЌАбЯћЯЂЗХЕНЖгСажаЃЌВЂЧвЕїгУ

wakeup ЗНЗЈ:

public void

wakeup() {

if (!dispatchedBySessionPool) {//НјвЛВНбщжЄ

// //ХаЖЯ session ЪЧЗёЮЊвьВНЗжЗЂ

if (session.isSessionAsyncDispatch()) {

try {

TaskRunner taskRunner = this.taskRunner;

if (taskRunner == null) {

synchronized (this) {

if (this.taskRunner == null) {

if (!isRunning()) {

// stop has been called

return;

}

//ЭЈЙ§ TaskRunnerFactory ДДНЈСЫвЛИіШЮЮёдЫааРр taskRunnerЃЌетРяАбздМКзїЮЊвЛИі

task ДЋШыЕН createTaskRunner жаЃЌ

//ЫЕУїЕБЧАЕФРрвЛЖЈЪЧЪЕЯжСЫ Task НгПкЕФ. МђЕЅРДЫЕЃЌ ОЭЪЧЭЈЙ§ЯпГЬГиШЅжДаавЛИіШЮЮёЃЌЭъГЩвьВНЕїЖШ

//етРягЩгкexecutor != null ЫљвдетИіtaskЕФРраЭЪЧPooledTaskRunner

this.taskRunner = session.connection .getSessionTaskRunner().createTaskRunner(this,

"ActiveMQ Session: " + session.getSessionId());

}

taskRunner = this.taskRunner;

}

}

taskRunner.wakeup();

} catch (InterruptedException e) {

Thread.currentThread().interrupt();

}

} else {// вьВНЗжЗЂ

while (iterate()) {

}

}

}

} |

ЫљвдЃЌЖдгквьВНЗжЗЂЕФЗНЪНЃЌЛсЕїгУ ActiveMQSessionExecutor жаЕФ iterateЗНЗЈЃЌЮвУЧРДПДПДетИіЗНЗЈЕФДњТы

iterate ЃЈЃЉЃКетИіЗНЗЈРяУцзіСНИіЪТ

1.АбЯћЗбепМрЬ§ЕФЫљгаЯћЯЂзЊДцЕНД§ЯћЗбЖгСажа

2. ШчЙћ messageQueue ЛЙДцдквХСєЯћЯЂЃЌЭЌбљАбЯћЯЂЗжЗЂ(ЕїЖШ)ГіШЅ

public boolean

iterate() {

// Deliver any messages queued on the consumer

to their listeners.<br> // НЋЯћЗбепЩЯХХЖгЕФШЮКЮЯћЯЂДЋЕнИјЫќУЧЕФеьЬ§ЦїЁЃ

for (ActiveMQMessageConsumer consumer : this.session.consumers)

{

if (consumer.iterate()) {

return true;

}

}

// No messages left queued on the listeners..

so now dispatch messages

// queued on the session<br> // еьЬ§ЦїЩЯУЛгаСєЯТХХЖгЕШД§ЕФЯћЯЂЁЃЯждкЗжХЩЯћЯЂ

MessageDispatch message = messageQueue.dequeueNoWait();

if (message == null) {

return false;

} else {// ЗжЗЂ(ЕїЖШ)ЯћЯЂ

dispatch(message);

return !messageQueue.isEmpty();

}

} |

dispatch(message);ЯћЯЂШЗШЯЗжЗЂЁЃЭЈЙ§ActiveMQSessionExecutorЕФdispatch

ЗНЗЈЃЌзЊЕНСЫ ActiveMQMessageConsumer ЯћЗбепРрЕФ dispatch ЗНЗЈЃК

public void

dispatch(MessageDispatch md) {

MessageListener listener = this.messageListener.get();

try {

clearMessagesInProgress();

clearDeliveredList();

synchronized (unconsumedMessages.getMutex()) {

if (!unconsumedMessages.isClosed()) {// ХаЖЯЯћЯЂЪЧЗёЮЊжиЗЂЯћЯЂ

if (this.info.isBrowser() || !session.connection.isDuplicate(this,

md.getMessage())) {

if (listener != null && unconsumedMessages.isRunning())

{

//ЮветБпЭЈЙ§consumer.receive()ДІРэЯћЯЂЃЌЫљвдетРяlistenerЮЊПеЃЌзпЯТУц

} else {

if (!unconsumedMessages.isRunning()) {

// delayed redelivery, ensure it can be re delivered

session.connection.rollbackDuplicate(this, md.getMessage());

}

if (md.getMessage() == null) {

// End of browse or pull request timeout.

unconsumedMessages.enqueue(md);

} else {

if (!consumeExpiredMessage(md)) {

unconsumedMessages.enqueue(md);

if (availableListener != null) {

availableListener.onMessageAvailable(this);

}

ЁЁЁЁЁЁЁЁЁЁЁЁ.........

} |

зюжеЛсзпШы unconsumedMessages.enqueue(md);ЬэМгЯћЯЂЁЃетРяашвЊзЂвтЕФЪЧenqueue

ЗНЗЈЃКгЩгкЯћЗбепПЩФмДІгкзшШћзДЬЌЃЌетРязіСЫШыЖгКѓЛиЪЭЗХЫјЃЌвВОЭЪЧНгДЅзшШћЁЃ

public void

enqueue(MessageDispatch message) {

synchronized (mutex) {

list.addLast(message);

mutex.notify();

}

} |

ЕНетРяЮЊжЙЃЌЯћЯЂШчКЮНгЪмвдМАЫћЕФДІРэЗНЪНЕФСїГЬЃЌЮвУЧвбОИуЧхГўСЫЁЃЦфЪЕдкетИіЯћЯЂЯћЗбЕФСїГЬжаЃЌвбОдкНЈСЂСЌНгЃЌДДНЈЯћЗбепЕФЪБКђОЭвбОГѕЪМЛЏКУСЫЯћЯЂЖгСаСЫЁЃНсКЯЩЯУцЕФЙ§ГЬРДПДПДећИіЯћЗбСїГЬЕФСїГЬЭМ

ЯћЗбЖЫЕФ PrefetchSizeЃК дкЯћЯЂЗЂВМЕФЪБКђЮвУЧдјОбаОПЙ§ producerWindowSize ЁЃжївЊгУРДдМЪјдквьВНЗЂЫЭЪБproducerЖЫдЪаэЛ§бЙЕФ(ЩаЮДACK)ЕФЯћЯЂЕФДѓаЁЃЌЧвжЛЖдвьВНЗЂЫЭгавтвхЁЃЖдгкПЭЛЇЖЫЃЌвВЪЧРрЫЦДцдкетУДвЛИіЪєадРДдМЪјПЭЛЇЖЫЕФЯћЯЂДІРэЁЃactivemq

ЕФ consumer ЖЫвВгаДАПкЛњжЦЃЌЭЈЙ§ prefetchSize ОЭПЩвдЩшжУДАПкДѓаЁЁЃВЛЭЌЕФРраЭЕФЖгСаЃЌprefetchSize

ЕФФЌШЯжЕвВЪЧВЛвЛбљЕФ.

1. ГжОУЛЏЖгСаКЭЗЧГжОУЛЏЖгСаЕФФЌШЯжЕЮЊ 1000

2.ГжОУЛЏ topic ФЌШЯжЕЮЊ 100

3.ЗЧГжОУЛЏЖгСаЕФФЌШЯжЕЮЊ Short.MAX_VALUE-1

ВтЪдЗНЗЈЪЧдкMQЩЯЩњВњ1000ЬѕЯћЯЂЃЌЯШКѓЦєЖЏcomsumer1ЃЌcomsumer2 СНИіЯћЗбепВЂЧвбЛЗЕїгУ1000ДЮЯћЗбЃЌЮвТшЛсЗЂЯж

comsumer2 ФУВЛЕНЯћЯЂЃЌетИіЪБКђЮвУЧПЩвдЭЈЙ§debugНјШыcomsumer1 ЕФActiveMQConnectЛсЗЂЯжРяУцгаИіЪєадЕФsize=1000.ЦфЪЕОЭЪЧетИіprefetchSizeЃЌЗвыЙ§РДЪЧдЄШЁДѓаЁЃЌЯћЗбЖЫЛсИљОнprefetchSize

ЕФДѓаЁХњСПЛёШЁЪ§ОнЁЃвтЫМЪЧдкДДНЈСЌНгЕФЪБКђЛсШЁЛёШЁ1000ЬѕЯћЯЂдЄМгдиЕНЛКДцжаЕШД§ДІРэЃЌетбљзгЕМжТcomsumer2ШЅЛёШЁЯћЯЂЕФЪБКђ

brokerЩЯвбОПеСЫЁЃ

prefetchSize ЕФЩшжУЗНЗЈЃК

дк createQueue жаЬэМг consumer.prefetchSizeЃЌОЭПЩвдПДЕНаЇЙћ

| Destination destination=session.createQueue ("myQueue?consumer.prefetchSize=10"); |

МШШЛгаХњСПМгдиЃЌФЧУДвЛЖЈгаХњСПШЗШЯЃЌетбљВХЫуЪЧГЙЕзЕФгХЛЏЃЌетОЭЩцМАЕН optimizeAcknowledge optimizeAcknowledge

ActiveMQ ЬсЙЉСЫ optimizeAcknowledge РДгХЛЏШЗШЯЃЌЫќБэЪОЪЧЗёПЊЦєЁАгХЛЏACKЁБЃЌжЛгадкЮЊ

true ЕФЧщПіЯТЃЌprefetchSize вдМАoptimizeAcknowledgeTimeout

ВЮЪ§ВХЛсгавтвхгХЛЏШЗШЯвЛЗНУцПЩвдМѕЧс client ИКЕЃЃЈВЛашвЊЦЕЗБЕФШЗШЯЯћЯЂЃЉЁЂМѕЩйЭЈаХПЊЯњЃЌСэвЛЗНУцгЩгкбгГйСЫШЗШЯЃЈФЌШЯ

ack СЫ 0.65*prefetchSize ИіЯћЯЂВХШЗШЯЃЉЃЌетИідкдДТыжагаЬхЯжЁЃдкActiveMQMessageConsumer#receiveЗНЗЈФкЕФДІРэЯћЯЂКѓЕФ

afterMessageIsConsumed ЗНЗЈФкгавЛИіХаЖЯЃК

if (ackCounter

+ deliveredCounter >= (info.getPrefetchSize()

* .65) || (optimizeAcknowledgeTimeOut > 0 &&

System.currentTimeMillis() >= (optimizeAckTimestamp

+ optimizeAcknowledgeTimeOut))) {

MessageAck ack = makeAckForAllDeliveredMessages (MessageAck.STANDARD_ACK_TYPE);

if (ack != null) {

deliveredMessages.clear();

ackCounter = 0;

session.sendAck(ack);//ТњзуЬѕМўдђЗЂЫЭХњСПгІД№ACK

optimizeAckTimestamp = System.currentTimeMillis();

}

// AMQ-3956 - as further optimization send

// ack for expired msgs when there are any.

// This resets the deliveredCounter to 0 so that

// we won't sent standard acks with every msg

just

// because the deliveredCounter just below

// 0.5 * prefetch as used in ackLater()

if (pendingAck != null && deliveredCounter

> 0) {

session.sendAck(pendingAck);

pendingAck = null;

deliveredCounter = 0;

}

} |

broker дйДЮЗЂЫЭЯћЯЂЪБгжПЩвдХњСПЗЂЫЭШчЙћжЛЪЧПЊЦєСЫ prefetchSizeЃЌУПЬѕЯћЯЂЖМШЅШЗШЯЕФЛАЃЌbroker

дкЪеЕНШЗШЯКѓвВжЛЪЧЗЂЫЭвЛЬѕЯћЯЂЃЌВЂВЛЪЧХњСПЗЂВМЃЌЕБШЛвВПЩвдЭЈЙ§ЩшжУ DUPS_OK_ACKРДЪжЖЏбгГйШЗШЯЃЌ

ЮвУЧашвЊдк brokerUrl жИЖЈ optimizeACK бЁЯю

ConnectionFactory connectionFactory = new ActiveMQConnectionFactory

("tcp://192.168.11.153:61616? jms.optimizeAcknowledge =true&jms.optimizeAcknowledgeTimeOut=10000"); |

зЂвтЃЌШчЙћ optimizeAcknowledge ЮЊ trueЃЌФЧУД

prefetchSize БиаыДѓгк 0. ЕБ prefetchSize=0 ЕФЪБКђЃЌБэЪО consumer

ЭЈЙ§ PULL ЗНЪНДг broker ЛёШЁЯћЯЂ.

optimizeAcknowledge КЭ prefetchSize ЕФзїгУЃЌСНепаЭЌЙЄзїЃЌЭЈЙ§ХњСПЛёШЁЯћЯЂЁЂВЂбгГйХњСПШЗШЯЃЌРДДяЕНвЛИіИпаЇЕФЯћЯЂЯћЗбФЃаЭЁЃЫќБШНіМѕЩйСЫПЭЛЇЖЫдкЛёШЁЯћЯЂЪБЕФзшШћДЮЪ§ЃЌЛЙФмМѕЩйУПДЮЛёШЁЯћЯЂЪБЕФЭјТчЭЈаХПЊЯњ

ашвЊзЂвтЕФЪЧЃЌШчЙћЯћЗбЖЫЕФЯћЗбЫйЖШБШНЯИпЃЌЭЈЙ§етСНепзщКЯЪЧФмДѓДѓЬсЩ§

consumer ЕФадФмЁЃШчЙћ consumer ЕФЯћЗбадФмБОЩэОЭБШНЯТ§ЃЌЩшжУБШНЯДѓЕФ prefetchSize

ЗДЖјВЛФмгааЇЕФДяЕНЬсЩ§ЯћЗбадФмЕФФПЕФЁЃвђЮЊЙ§ДѓЕФprefetchSize ВЛРћгк consumer

ЖЫЯћЯЂЕФИКдиОљКтЁЃвђЮЊЭЈГЃЧщПіЯТЃЌЮвУЧЖМЛсВПЪ№ЖрИі consumer НкЕуРДЬсЩ§ЯћЗбЖЫЕФЯћЗбадФмЁЃетИігХЛЏЗНАИЛЙЛсДцдкСэЭтвЛИіЧБдкЗчЯеЃЌЕБЯћЯЂБЛЯћЗбжЎКѓЛЙУЛгаРДЕУМАШЗШЯЪБЃЌclient

ЖЫЗЂЩњЙЪеЯЃЌФЧУДетаЉЯћЯЂОЭгаПЩФмЛсБЛжиаТЗЂЫЭИјЦфЫћconsumerЃЌФЧУДетжжЗчЯеОЭашвЊ client

ЖЫФмЙЛШнШЬЁАжиИДЁБЯћЯЂЁЃ

ЯћЯЂЕФШЗШЯЙ§ГЬЃК ЯћЯЂШЗШЯгаЫФжж ACK_MODEЃЌЗжБ№ЪЧЃК

1. AUTO_ACKNOWLEDGE = 1 здЖЏШЗШЯ

2.CLIENT_ACKNOWLEDGE = 2 ПЭЛЇЖЫЪжЖЏШЗШЯ

3.DUPS_OK_ACKNOWLEDGE = 3 здЖЏХњСПШЗШЯ

4.SESSION_TRANSACTED = 0 ЪТЮёЬсНЛВЂШЗШЯ

ACK_MODE ЕФбЁдёгАЯьзХЯћЯЂЯћЗбСїГЬЕФзпЯђЁЃЫфШЛ Client ЖЫжИЖЈСЫ ACK ФЃЪН,ЕЋЪЧдк

Client гы broker дкНЛЛЛ ACK жИСюЕФЪБКђ,ЛЙашвЊИцжЊ ACK_TYPE,ACK_TYPE

БэЪОДЫШЗШЯжИСюЕФРраЭЃЌВЛЭЌЕФACK_TYPE НЋДЋЕнзХЯћЯЂЕФзДЬЌЃЌbroker ПЩвдИљОнВЛЭЌЕФ ACK_TYPE

ЖдЯћЯЂНјааВЛЭЌЕФВйзїЁЃ

ACK_TYPEгІД№РраЭЃК DELIVERED_ACK_TYPE = 0 ЯћЯЂ"вбНгЪе"ЃЌЕЋЩаЮДДІРэНсЪј

STANDARD_ACK_TYPE = 2 "БъзМ"РраЭ,ЭЈГЃБэЪОЮЊЯћЯЂ"ДІРэГЩЙІ"ЃЌbroker

ЖЫПЩвдЩОГ§ЯћЯЂСЫ

POSION_ACK_TYPE = 1 ЯћЯЂ"ДэЮѓ",ЭЈГЃБэЪО"ХзЦњ"ДЫЯћЯЂЃЌБШШчЯћЯЂжиЗЂЖрДЮКѓЃЌЖМЮоЗЈе§ШЗДІРэЪБЃЌЯћЯЂНЋЛсБЛЩОГ§Лђеп

DLQ(ЫРаХЖгСа)ЃЌдкЯћЯЂДІРэЕФЪБКђЃЌdispatchЗНЗЈФкЛсХаЖЯИУЯћЯЂЪЧЗёЮЊжиЗЂЯћЯЂ

if (this.info.isBrowser()

|| !session.connection.isDuplicate(this, md.getMessage()))

{

if (listener != null && unconsumedMessages.isRunning())

{

// етЖЮЮЊЗЧжиЗЂЯћЯЂЃЌзпelse

} else {

// deal with duplicate delivery

ConsumerId consumerWithPendingTransaction;

if (redeliveryExpectedInCurrentTransaction(md,

true)) {

LOG.debug("{} tracking transacted redelivery

{}", getConsumerId(), md.getMessage());

if (transactedIndividualAck) {

immediateIndividualTransactedAck(md);

} else {

session.sendAck(new MessageAck(md, MessageAck.DELIVERED_ACK_TYPE,

1));

}

} else if ((consumerWithPendingTransaction = redeliveryPendingInCompetingTransaction(md))

!= null) {

LOG.warn("{} delivering duplicate {}, pending

transaction completion on {} will rollback",

getConsumerId(), md.getMessage(), consumerWithPendingTransaction);

session.getConnection().rollbackDuplicate(this,

md.getMessage());

dispatch(md);

} else {// зпPOSION_ACK_TYPE ЬэМгActive_DLQ ЫРаХЖгСа

LOG.warn("{} suppressing duplicate delivery

on connection, poison acking: {}", getConsumerId(),

md);

posionAck(md, "Suppressing duplicate delivery

on connection, consumer " + getConsumerId());

}

} |

REDELIVERED_ACK_TYPE = 3 ЯћЯЂаш"жиЗЂ"ЃЌБШШч consumer

ДІРэЯћЯЂЪБХзГіСЫвьГЃЃЌbroker ЩдКѓЛсжиаТЗЂЫЭДЫЯћЯЂ

INDIVIDUAL_ACK_TYPE = 4 БэЪОжЛШЗШЯ"ЕЅЬѕЯћЯЂ",ЮоТлдкШЮКЮ

ACK_MODE ЯТ

UNMATCHED_ACK_TYPE = 5 дк Topic жаЃЌШчЙћвЛЬѕЯћЯЂдкзЊЗЂИјЁАЖЉдФепЁБЪБЃЌЗЂЯжДЫЯћЯЂВЛЗћКЯ

Selector Й§ТЫЬѕМўЃЌФЧУДДЫЯћЯЂНЋ ВЛЛсзЊЗЂИјЖЉдФепЃЌЯћЯЂНЋЛсБЛДцДЂв§ЧцЩОГ§(ЯрЕБгкдк Broker

ЩЯШЗ ШЯСЫЯћЯЂ)ЁЃ

Client ЖЫдкВЛЭЌЕФ ACK ФЃЪНЪБ,НЋвтЮЖзХдкВЛЭЌЕФЪБЛњЗЂЫЭ ACK жИСю,УПИі ACK

Command жаЛсАќКЌ ACK_TYPE,ФЧУД broker ЖЫОЭПЩвдИљОн ACK_TYPE РДОіЖЈДЫЯћЯЂЕФКѓајВйзїЁЃдк

afterMessageIsConsumed ЯћЯЂНгЪеДІРэКѓЛсИљОнЬѕМўРДЩшжУ ACK_TYPE.

ЯћЯЂЕФжиЗЂЛњжЦдРэ: дке§ГЃЧщПіЯТЃЌгаМИжаЧщПіЛсЕМжТЯћЯЂжиаТЗЂЫЭ

дкЪТЮёадЛсЛАжаЃЌУЛгаЕїгУ session.commit ШЗШЯЯћЯЂхДЛњЛђепЕїгУsession.rollback

ЗНЗЈЛиЙіЯћЯЂ

дкЗЧЪТЮёадЛсЛАжаЃЌACK ФЃЪНЮЊ CLIENT_ACKNOWLEDGE

(ПЭЛЇЖЫЪжЖЏгІД№)ЕФЧщПіЯТЃЌУЛгаЕїгУ session.commitЛђепЕїгУСЫ recover ЗНЗЈЃЛ

вЛИіЯћЯЂБЛ redelivedred ГЌЙ§ФЌШЯЕФзюДѓжиЗЂДЮЪ§ЃЈФЌШЯ 6 ДЮЃЉЪБЃЌЯћЗбЖЫЛсИј broker

ЗЂЫЭвЛИіЁБpoison ackЁББэЪОетИіЯћЯЂгаЖОЃЌИцЫп broker ВЛвЊдйЗЂСЫЁЃетИіЪБКђ broker

ЛсАбетИіЯћЯЂЗХЕН DLQЃЈЫРаХЖгСаЃЉЁЃ

ЫРаХЖгСаЃК ActiveMQ жаФЌШЯЕФЫРаХЖгСаЪЧ ActiveMQ.DLQЃЌШчЙћУЛгаЬиБ№ЕФХфжУЃЌгаЖОЕФЯћЯЂЖМЛсБЛЗЂЫЭЕНетИіЖгСаЁЃФЌШЯЧщПіЯТЃЌШчЙћГжОУЯћЯЂЙ§ЦквдКѓЃЌвВЛсБЛЫЭЕН

DLQ жаЁЃ

жЛвЊдкДІРэЯћЯЂЕФЪБКђХзГівЛИівьГЃОЭПЩвдбнЪОЃЌЛсПДЕНПижЦЬЈЖдгкЪЇАмЯћЯЂЛсжиЗЂ6ДЮЃЌЕЧТНActiveMQПижЦЬЈЛсПДЕНвЛИі

ActiveMQ.DLQЁЃдкДДНЈЖгСаЕФЪБКђПЩвджБНгжИЖЈДгActiveMQ.DLQШЅЯћЗбЯћЯЂЁЃ

ЫРаХЖгСаХфжУВпТдЃК

ШБЪЁЫљгаЖгСаЕФЫРаХЯћЯЂЖМБЛЗЂЫЭЕНЭЌвЛИіШБЪЁЫРаХЖгСаЃЌВЛБугкЙмРэЃЌПЩвдЭЈЙ§

individualDeadLetterStrategy Лђ sharedDeadLetterStrategy

ВпТдРДНјаааоИФЁЃдкactivemq.xmlЩЯ

<destinationPolicy>

<policyMap>

<policyEntries>

<policyEntry topic=">" >

<!-- The constantPendingMessageLimitStrategy

is used to prevent

slow topic consumers to block producers and affect

other consumers

by limiting the number of messages that are retained

For more information, see:

http://activemq.apache.org/slow-consumer-handling.html

-->

<pendingMessageLimitStrategy>

<constantPendingMessageLimitStrategy limit="1000"/>

</pendingMessageLimitStrategy>

</policyEntry>

// ЁА>ЁББэЪОЖдЫљгаЖгСаЩњаЇЃЌШчЙћашвЊЩшжУжИЖЈЖгСаЃЌдђжБНгаДЖгСаУћГЦ

<policyEntry

queue=">">

<deadLetterStrategy>

//queuePrefix:ЩшжУЫРаХЖгСаЧАзК

//useQueueForQueueMessage ЩшжУЖгСаБЃДцЕНЫРаХЁЃ

<individualDeadLetterStrategy

queuePrefix ="DLQ."useQueueForQueueMessages ="true"/>

</deadLetterStrategy>

</policyEntry>

</policyEntries>

</policyMap>

</destinationPolicy> |

здЖЏЖЊЦњЙ§ЦкЯћЯЂ

<deadLetterStrategy>

<sharedDeadLetterStrategy processExpired="false"

/>

</deadLetterStrategy> |

ActiveMQ ОВЬЌЭјТчХфжУЃКbrokerЭјТчСЌНг(brokerЕФИпадФмЗНАИ)

аоИФ activeMQ ЗўЮёЦїЕФ activeMQ.xml, діМгШчЯТХфжУЃЌетИіХфжУжЛФмЪЕЯжЕЅЯђСЌНгЃЌЪЕЯжЫЋЯђСЌНгашвЊИїИіНкЕуЖМХфжУШчЯТХфжУЁЃ

<networkConnectors>

<networkConnector uri="static:// (tcp://192.168.254.135:61616, tcp://192.168.254.136:61616)"/>

</networkConnectors> |

СНИі Brokers ЭЈЙ§вЛИі static ЕФавщРДНјааЭјТчСЌНгЁЃвЛИі Consumer СЌНгЕНBrokerB

ЕФвЛИіЕижЗЩЯЃЌЕБ Producer дк BrokerA ЩЯвдЯрЭЌЕФЕижЗЗЂЫЭЯћЯЂЃЌДЫЪБЯћЯЂЛсБЛзЊвЦЕН

BrokerB ЩЯЃЌвВОЭЪЧЫЕ BrokerA ЛсзЊЗЂЯћЯЂЕНBrokerB ЩЯЁЃ

дкactiveMQжаЃЌНјааСЫОВЬЌЭјТчЧХНгЕФСНЬЈНкЕуЖјбдЃЌЕБ Producer

дк BrokerA ЩЯвдЯрЭЌЕФЕижЗЗЂЫЭ10ЬѕЯћЯЂЁЃвЛИі Consumer СЌНгЕНBrokerBШЅЯћЗбЯћЯЂЃЌЕБЯћЗбСЫвЛАыЕФЪБКђГіЯжвьГЃСЫЃЌФЧУДЪЃЯТРДЮДДІРэЕФЯћЯЂЛсБЛДцЗХЕН

BrokerB ЕФД§ДІРэЯћЯЂЖгСажаЃЌДЫЪБвЊЭЈЙ§BrokerAдйШЅЯћЗбЪЧЯћЗбВЛЕНЕФЃЌЭђвЛДЫПЬBrokerB

ЙвСЫЃЌФЧУДФФаЉУЛгаЯћЗбЕФЯћЯЂНЋЛсЖЊЪЇЁЃmqИјЮвУЧЬсЙЉСЫвЛИігааЇЕФЯћЯЂЛиСїЛњжЦЁЃ

<policyEntry

queue=">" enableAudit="false">

<networkBridgeFilterFactory>

<conditionalNetworkBridgeFilterFactory

replayWhenNoConsumers="true"/>

</networkBridgeFilterFactory>

</policyEntry> |

ActiveMQ ЕФгХШБЕу ActiveMQ ВЩгУЯћЯЂЭЦЫЭЗНЪНЃЌЫљвдзюЪЪКЯЕФГЁОАЪЧФЌШЯЯћЯЂЖМПЩдкЖЬЪБМфФкБЛЯћЗбЁЃЪ§ОнСПдНДѓЃЌВщевКЭЯћЗбЯћЯЂОЭдНТ§ЃЌЯћЯЂЛ§бЙГЬЖШгыЯћЯЂЫйЖШГЩЗДБШЁЃ

ШБЕу

1.ЭЬЭТСПЕЭЁЃгЩгк ActiveMQ ашвЊНЈСЂЫїв§ЃЌЕМжТЭЬЭТСПЯТНЕЁЃетЪЧЮоЗЈПЫЗўЕФШБЕуЃЌжЛвЊЪЙгУЭъШЋЗћКЯ

JMS ЙцЗЖЕФЯћЯЂжаМфМўЃЌОЭвЊНгЪметИіМЖБ№ЕФTPSЁЃ

2.ЮоЗжЦЌЙІФмЁЃетЪЧвЛИіЙІФмШБЪЇЃЌJMS ВЂУЛгаЙцЖЈЯћЯЂжаМфМўЕФМЏШКЁЂЗжЦЌЛњжЦЁЃЖјгЩгк ActiveMQ

ЪЧЮАЦѓвЕМЖПЊЗЂЩшМЦЕФЯћЯЂжаМфМўЃЌГѕждВЂВЛЪЧЮЊСЫДІРэКЃСПЯћЯЂКЭИпВЂЗЂЧыЧѓЁЃШчЙћвЛЬЈЗўЮёЦїВЛФмГаЪмИќЖрЯћЯЂЃЌдђашвЊКсЯђВ№ЗжЁЃActiveMQ

ЙйЗНВЛЬсЙЉЗжЦЌЛњжЦЃЌашвЊздМКЪЕЯжЁЃ

ЪЪгУГЁОА

1. Жд TPS вЊЧѓБШНЯЕЭЕФЯЕЭГЃЌПЩвдЪЙгУ ActiveMQ РДЪЕЯжЃЌвЛЗНУцБШНЯМђЕЅЃЌФмЙЛПьЫйЩЯЪжПЊЗЂЃЌСэвЛЗНУцПЩПиадвВБШНЯКУЃЌЛЙгаБШНЯКУЕФМрПиЛњжЦКЭНчУц

ВЛЪЪгУЕФГЁОА

1.ЯћЯЂСПОоДѓЕФГЁОАЁЃActiveMQ ВЛжЇГжЯћЯЂздЖЏЗжЦЌЛњжЦЃЌШчЙћЯћЯЂСПОоДѓЃЌЕМжТвЛЬЈЗўЮёЦїВЛФмДІРэШЋВПЯћЯЂЃЌОЭашвЊздМКПЊЗЂЯћЯЂЗжЦЌЙІФмЁЃ

|