| ±ύΦ≠ΆΤΦω: |

±ΨΈΡ÷ς“ΣΫι…ήΝΥNginx

÷Σ ΕΆχΫαΙΙΆΦΓΔΖ¥œρ¥ζάμΓΔΗΚ‘ΊΨυΚβΓΔΕ·Ψ≤Ζ÷άκΓΔNginx ≥Θ”ΟΟϋΝνΦΑ≈δ÷ΟΈΡΦΰΒ»ΓΘ

±ΨΈΡά¥Ή‘”ΎΈΔ–≈ΙΪ÷ΛΚ≈ΦήΙΙ Π Θ§”…ΜπΝζΙϊ»μΦΰLinda±ύΦ≠ΆΤΦωΓΘ |

|

Nginx «“ΜΗωΗΏ–‘ΡήΒΡ HTTP ΚΆΖ¥œρ¥ζάμΖΰΈώΤςΘ§ΧΊΒψ «’Φ”ΟΡΎ¥φ…ΌΘ§≤ΔΖΔΡήΝΠ«ΩΘ§ ¬ Β…œ

Nginx ΒΡ≤ΔΖΔΡήΝΠ»Ζ Β‘ΎΆ§άύ–ΆΒΡΆχ“≥ΖΰΈώΤς÷–±μœ÷ΫœΚΟΓΘ

Nginx Ή®ΈΣ–‘Ρή”≈Μ·ΕχΩΣΖΔΘ§–‘Ρή «ΤδΉν÷Ί“ΣΒΡ“Σ«σΘ§ °Ζ÷ΉΔ÷Ί–߬ Θ§”–±®Ηφ Nginx Ρή÷ß≥÷ΗΏ¥ο

50000 Ηω≤ΔΖΔΝ§Ϋ” ΐΓΘ

Nginx ÷Σ ΕΆχΫαΙΙΆΦ

Nginx ΒΡ÷Σ ΕΆχΫαΙΙΆΦ»γœ¬ΘΚ

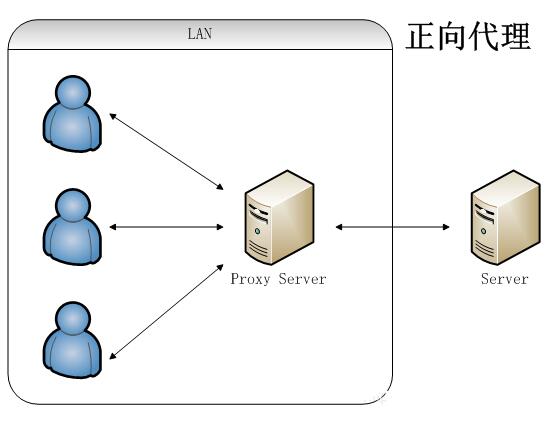

Ζ¥œρ¥ζάμ

’ΐœρ¥ζάμΘΚΨ÷”ρΆχ÷–ΒΡΒγΡ‘”ΟΜßœκ“Σ÷±Ϋ”ΖΟΈ Άχ¬γ «≤ΜΩ…––ΒΡΘ§÷ΜΡήΆ®Ιΐ¥ζάμΖΰΈώΤςά¥ΖΟΈ Θ§’β÷÷¥ζάμΖΰΈώΨΆ±Μ≥ΤΈΣ’ΐœρ¥ζάμΓΘ

Ζ¥œρ¥ζάμΘΚΩΆΜßΕΥΈόΖ®Η–÷Σ¥ζάμΘ§“ρΈΣΩΆΜßΕΥΖΟΈ Άχ¬γ≤Μ–η“Σ≈δ÷ΟΘ§÷Μ“ΣΑ―«κ«σΖΔΥΆΒΫΖ¥œρ¥ζάμΖΰΈώΤςΘ§”…Ζ¥œρ¥ζάμΖΰΈώΤς»Ξ―Γ‘ώΡΩ±ξΖΰΈώΤςΜώ»Γ ΐΨίΘ§»ΜΚσ‘ΌΖΒΜΊΒΫΩΆΜßΕΥΓΘ

¥Υ ±Ζ¥œρ¥ζάμΖΰΈώΤςΚΆΡΩ±ξΖΰΈώΤςΕ‘ΆβΨΆ «“ΜΗωΖΰΈώΤςΘ§±©¬ΕΒΡ «¥ζάμΖΰΈώΤςΒΊ÷ΖΘ§“ΰ≤ΊΝΥ’φ ΒΖΰΈώΤς IP

ΒΊ÷ΖΓΘ

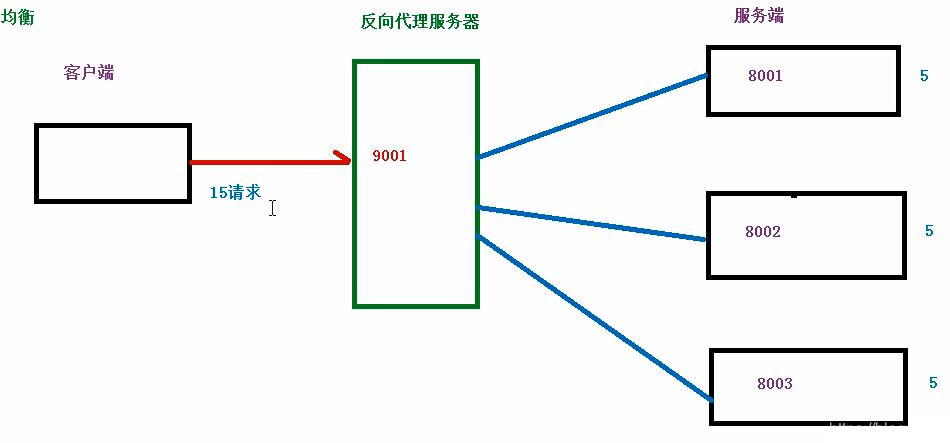

ΗΚ‘ΊΨυΚβ

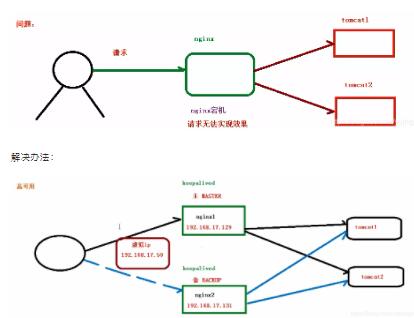

ΩΆΜßΕΥΖΔΥΆΕύΗω«κ«σΒΫΖΰΈώΤςΘ§ΖΰΈώΤς¥Πάμ«κ«σΘ§”–“Μ–©Ω…Ρή“Σ”κ ΐΨίΩβΫχ––ΫΜΜΞΘ§ΖΰΈώΤς¥ΠάμΆξ±œ÷°ΚσΘ§‘ΌΫΪΫαΙϊΖΒΜΊΗχΩΆΜßΕΥΓΘ

Τ’Ά®«κ«σΚΆœλ”ΠΙΐ≥Χ»γœ¬ΆΦΘΚ

ΒΪ «ΥφΉ≈–≈œΔ ΐΝΩ‘ω≥ΛΘ§ΖΟΈ ΝΩΚΆ ΐΨίΝΩΖ…ΥΌ‘ω≥ΛΘ§Τ’Ά®ΦήΙΙΈόΖ®¬ζΉψœ÷‘ΎΒΡ–η«σΓΘ

Έ“Ο« Ήœ»œκΒΫΒΡ «…ΐΦΕΖΰΈώΤς≈δ÷ΟΘ§Ω…“‘”…”ΎΡΠΕϊΕ®¬…ΒΡ»’“φ ß–ßΘ§ΒΞ¥Ω¥””≤ΦΰΧα…ΐ–‘Ρή“―Ψ≠÷πΫΞ≤ΜΩ…»ΓΝΥΘ§‘θΟ¥ΫβΨω’β÷÷–η«σΡΊΘΩ

Έ“Ο«Ω…“‘‘ωΦ”ΖΰΈώΤςΒΡ ΐΝΩΘ§ΙΙΫ®Φ·»ΚΘ§ΫΪ«κ«σΖ÷ΖΔΒΫΗςΗωΖΰΈώΤς…œΘ§ΫΪ‘≠ά¥«κ«σΦ·÷–ΒΫΒΞΗωΖΰΈώΤςΒΡ«ιΩωΗΡΈΣ«κ«σΖ÷ΖΔΒΫΕύΗωΖΰΈώΤςΘ§“≤ΨΆ «Έ“Ο«ΥΒΒΡΗΚ‘ΊΨυΚβΓΘ

ΆΦΫβΗΚ‘ΊΨυΚβΘΚ

ΦΌ…η”– 15 Ηω«κ«σΖΔΥΆΒΫ¥ζάμΖΰΈώΤςΘ§Ρ«Ο¥”…¥ζάμΖΰΈώΤςΗυΨίΖΰΈώΤς ΐΝΩΘ§ΤΫΨυΖ÷≈δΘ§ΟΩΗωΖΰΈώΤς¥Πάμ 5

Ηω«κ«σΘ§’βΗωΙΐ≥ΧΨΆΫ–ΉωΗΚ‘ΊΨυΚβΓΘ

Έ“Α― Ngixn œύΙΊΒΡΈΡ’¬’ϊάμ≥…ΝΥ PDFΘ§ΙΊΉΔΈΔ–≈ΙΪ÷ΎΚ≈ JavaΚσΕΥΘ§ ΜΊΗ¥ 666 œ¬‘ΊΓΘ

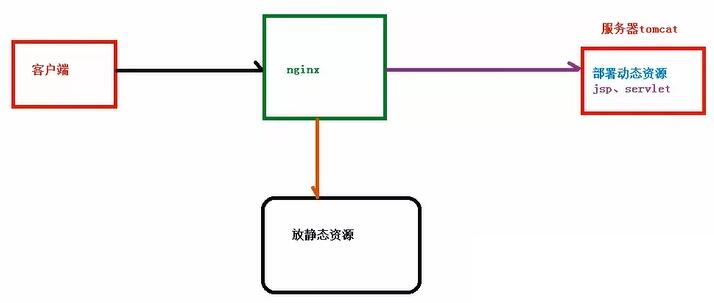

Ε·Ψ≤Ζ÷άκ

ΈΣΝΥΦ”ΩλΆχ’ΨΒΡΫβΈωΥΌΕ»Θ§Ω…“‘Α―Ε·Χ§“≥ΟφΚΆΨ≤Χ§“≥ΟφΫΜΗχ≤ΜΆ§ΒΡΖΰΈώΤςά¥ΫβΈωΘ§Φ”ΩλΫβΈωΒΡΥΌΕ»Θ§ΫΒΒΆ”…ΒΞΗωΖΰΈώΤςΒΡ―ΙΝΠΓΘ

Ε·Ψ≤Ζ÷άκ÷°«ΑΒΡΉ¥Χ§ΘΚ

Ε·Ψ≤Ζ÷άκ÷°ΚσΘΚ

Α≤ΉΑ

≤ΈΩΦΝ¥Ϋ”ΘΚ

| https://blog.csdn.net/yujing1314/article/details/97267369

|

Nginx ≥Θ”ΟΟϋΝν

≤ιΩ¥Αφ±ΨΘΚ

ΤτΕ·ΘΚ

ΙΊ±’Θ®”–ΝΫ÷÷ΖΫ ΫΘ§ΆΤΦω Ι”Ο ./nginx -s quitΘ©ΘΚ

| ./nginx -s stop

./nginx -s quit |

÷Ί–¬Φ”‘Ί Nginx ≈δ÷ΟΘΚ

Nginx ΒΡ≈δ÷ΟΈΡΦΰ

≈δ÷ΟΈΡΦΰΖ÷»ΐ≤ΩΖ÷Ήι≥…ΘΚ

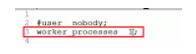

ΔΌ»ΪΨ÷Ωι

¥”≈δ÷ΟΈΡΦΰΩΣ ΦΒΫ events Ωι÷°ΦδΘ§÷ς“Σ «…η÷Ο“Μ–©”Αœλ Nginx ΖΰΈώΤς’ϊΧε‘Υ––ΒΡ≈δ÷Ο÷ΗΝνΓΘ

≤ΔΖΔ¥ΠάμΖΰΈώΒΡ≈δ÷ΟΘ§÷Β‘Ϋ¥σΘ§Ω…“‘÷ß≥÷ΒΡ≤ΔΖΔ¥ΠάμΝΩ‘ΫΕύΘ§ΒΪ «Μα ήΒΫ”≤ΦΰΓΔ»μΦΰΒ»…η±ΗΒΡ÷Τ‘ΦΓΘ

ΔΎevents Ωι

”Αœλ Nginx ΖΰΈώΤς”κ”ΟΜßΒΡΆχ¬γΝ§Ϋ”Θ§≥Θ”ΟΒΡ…η÷ΟΑϋά® «ΖώΩΣΤτΕ‘Εύ workprocess œ¬ΒΡΆχ¬γΝ§Ϋ”Ϋχ–––ρΝ–Μ·Θ§ «Ζώ‘ –μΆ§ ±Ϋ” ’ΕύΗωΆχ¬γͧ۔»»ΓΘ

÷ß≥÷ΒΡΉν¥σΝ§Ϋ” ΐΘΚ

ΔέHTTP Ωι

÷ν»γΖ¥œρ¥ζάμΚΆΗΚ‘ΊΨυΚβΕΦ‘Ύ¥Υ≈δ÷ΟΓΘ

| location[ =

| ~ | ~* | ^~] url{

} |

location ÷ΗΝνΥΒΟςΘ§ΗΟ”οΖ®”Οά¥ΤΞ≈δ urlΘ§”οΖ®»γ…œΘΚ

=ΘΚ”Ο”Ύ≤ΜΚ§’ΐ‘ρ±μ¥ο ΫΒΡ url «ΑΘ§“Σ«σΉ÷Ζϊ¥°”κ url ―œΗώΤΞ≈δΘ§ΤΞ≈δ≥…ΙΠΨΆΆΘ÷Ιœρœ¬Υ―Υς≤Δ¥Πάμ«κ«σΓΘ

~ΘΚ”Ο”Ύ±μ Ψ url ΑϋΚ§’ΐ‘ρ±μ¥ο ΫΘ§≤Δ«“«χΖ÷¥σ–Γ–¥ΓΘ

~*ΘΚ”Ο”Ύ±μ Ψ url ΑϋΚ§’ΐ‘ρ±μ¥ο ΫΘ§≤Δ«“≤Μ«χΖ÷¥σ–Γ–¥ΓΘ

^~ΘΚ”Ο”Ύ≤ΜΚ§’ΐ‘ρ±μ¥ο ΫΒΡ url «ΑΘ§“Σ«σ Nginx ΖΰΈώΤς’“ΒΫ±μ Ψ url ΚΆΉ÷Ζϊ¥°ΤΞ≈δΕ»ΉνΗΏΒΡ

location ΚσΘ§ΝΔΦ¥ Ι”Ο¥Υ location ¥Πάμ«κ«σΘ§Εχ≤Μ‘ΌΤΞ≈δΓΘ

»γΙϊ”– url ΑϋΚ§’ΐ‘ρ±μ¥ο ΫΘ§≤Μ–η“Σ”– ~ ΩΣΆΖ±ξ ΕΓΘ

Ζ¥œρ¥ζάμ Β’Ϋ

ΔΌ≈δ÷ΟΖ¥œρ¥ζάμ

ΡΩΒΡΘΚ‘Ύδ·άάΤςΒΊ÷ΖάΗ δ»κΒΊ÷Ζ www.123.com ΧχΉΣ Linux œΒΆ≥ Tomcat ÷ς“≥ΟφΓΘ

ΔΎΨΏΧε Βœ÷

œ»≈δ÷Ο TomcatΘ§“ρΈΣ±»ΫœΦρΒΞΘ§¥Υ¥Π≤Μ‘ΌΉΗ–πΘ§≤Δ‘Ύ Windows ΖΟΈ ΘΚ

ΨΏΧεΝς≥Χ»γœ¬ΆΦΘΚ

–όΗΡ÷°«ΑΘΚ

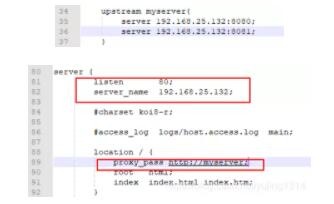

≈δ÷Ο»γœ¬ΘΚ

‘Ό¥ΈΖΟΈ ΘΚ

ΔέΖ¥œρ¥ζάμ 2

ΡΩ±ξΘΚ

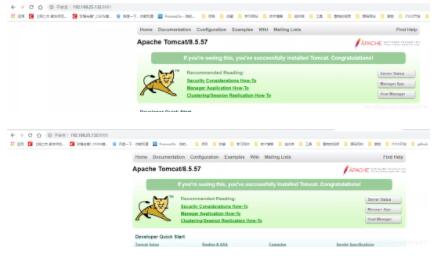

ΖΟΈ http://192.168.25.132:9001/edu/ ÷±Ϋ”ΧχΉΣΒΫ 192.168.25.132:8080

ΖΟΈ http://192.168.25.132:9001/vod/ ÷±Ϋ”ΧχΉΣΒΫ 192.168.25.132:8081

ΉΦ±ΗΘΚ≈δ÷ΟΝΫΗω TomcatΘ§ΕΥΩΎΖ÷±πΈΣ 8080 ΚΆ 8081Θ§ΕΦΩ…“‘ΖΟΈ Θ§ΕΥΩΎ–όΗΡ≈δ÷ΟΈΡΦΰΦ¥Ω…ΓΘ

–¬Ϋ®ΈΡΦΰΡΎ»ίΖ÷±πΧμΦ” 8080ΘΓΘΓΘΓΚΆ 8081ΘΓΘΓΘΓ

Ζ¥œρ¥ζάμ–ΓΫα

ΒΎ“ΜΗωάΐΉ”ΘΚδ·άάΤςΖΟΈ www.123.comΘ§”… host ΈΡΦΰΫβΈω≥ωΖΰΈώΤς ip ΒΊ÷Ζ

192.168.25.132 www.123.comΓΘ

»ΜΚσΡ§»œΖΟΈ 80 ΕΥΩΎΘ§ΕχΆ®Ιΐ Nginx ΦύΧΐ 80 ΕΥΩΎ¥ζάμΒΫ±ΨΒΊΒΡ 8080 ΕΥΩΎ…œΘ§¥”Εχ Βœ÷ΝΥΖΟΈ

www.123.comΘ§Ήν÷’ΉΣΖΔΒΫ tomcat 8080 …œ»ΞΓΘ

ΒΎΕΰΗωάΐΉ”ΘΚ

ΖΟΈ http://192.168.25.132:9001/edu/ ÷±Ϋ”ΧχΉΣΒΫ 192.168.25.132:8080

ΖΟΈ http://192.168.25.132:9001/vod/ ÷±Ϋ”ΧχΉΣΒΫ 192.168.25.132:8081

ΒΦ …œΨΆ «Ά®Ιΐ Nginx ΦύΧΐ 9001 ΕΥΩΎΘ§»ΜΚσΆ®Ιΐ’ΐ‘ρ±μ¥ο Ϋ―Γ‘ώΉΣΖΔΒΫ 8080 ΜΙ « 8081

ΒΡ Tomcat …œ»ΞΓΘ

ΗΚ‘ΊΨυΚβ Β’Ϋ

ΔΌ–όΗΡ nginx.confΘ§»γœ¬ΆΦΘΚ

ΔΎ÷ΊΤτ NginxΘΚ

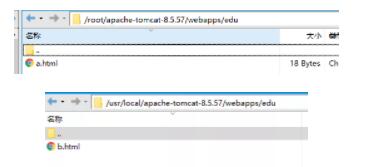

Δέ‘Ύ 8081 ΒΡ Tomcat ΒΡ webapps ΈΡΦΰΦ–œ¬–¬Ϋ® edu ΈΡΦΰΦ–ΚΆ a.html

ΈΡΦΰΘ§Χν–¥ΡΎ»ίΈΣ 8081ΘΓΘΓΘΓΘΓ

Δή‘ΎΒΊ÷ΖάΗΜΊ≥ΒΘ§ΨΆΜαΖ÷ΖΔΒΫ≤ΜΆ§ΒΡ Tomcat ΖΰΈώΤς…œΘΚ

ΗΚ‘ΊΨυΚβΖΫ Ϋ»γœ¬ΘΚ

¬÷―·Θ®Ρ§»œΘ©ΓΘ

weightΘ§¥ζ±μ»®Θ§»®‘ΫΗΏ”≈œ»ΦΕ‘ΫΗΏΓΘ

fairΘ§Α¥ΚσΕΥΖΰΈώΤςΒΡœλ”Π ±Φδά¥Ζ÷≈δ«κ«σΘ§œύ”Π ±ΦδΕΧΒΡ”≈œ»Ζ÷≈δΓΘ

ip_hashΘ§ΟΩΗω«κ«σΑ¥’’ΖΟΈ ip ΒΡ hash ΫαΙϊΖ÷≈δΘ§’β―υΟΩ“ΜΗωΖΟΩΆΙΧΕ®ΒΡΖΟΈ “ΜΗωΚσΕΥΖΰΈώΤςΘ§Ω…“‘ΫβΨω

Session ΒΡΈ ΧβΓΘ

Ε·Ψ≤Ζ÷άκ Β’Ϋ

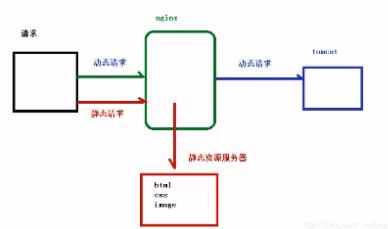

≤Ο¥ «Ε·Ψ≤Ζ÷άκΘΩΑ―Ε·Χ§«κ«σΚΆΨ≤Χ§«κ«σΖ÷ΩΣΘ§≤Μ «Ϋ≤Ε·Χ§“≥ΟφΚΆΨ≤Χ§“≥ΟφΈοάμΖ÷άκΘ§Ω…“‘άμΫβΈΣ Nginx

¥ΠάμΨ≤Χ§“≥ΟφΘ§Tomcat ¥ΠάμΕ·Χ§“≥ΟφΓΘ

Ε·Ψ≤Ζ÷άκ¥σ÷¬Ζ÷ΈΣΝΫ÷÷ΘΚ

¥Ω¥βΫΪΨ≤Χ§ΈΡΦΰΕάΝΔ≥…ΒΞΕά”ρΟϊΖ≈‘ΎΕάΝΔΒΡΖΰΈώΤς…œΘ§“≤ «ΡΩ«Α÷ςΝςΖΫΑΗΓΘ

ΫΪΕ·Χ§ΗζΨ≤Χ§ΈΡΦΰΜλΚœ‘Ύ“ΜΤπΖΔ≤ΦΘ§Ά®Ιΐ Nginx Ζ÷ΩΣΓΘ

Ε·Ψ≤Ζ÷άκΆΦΈωΘΚ

Β’ΫΉΦ±ΗΘ§ΉΦ±ΗΨ≤Χ§ΈΡΦΰΘΚ

≈δ÷Ο NginxΘ§»γœ¬ΆΦΘΚ

Nginx ΗΏΩ…”Ο

»γΙϊ Nginx ≥ωœ÷Έ ΧβΘΚ

«ΑΤΎΉΦ±ΗΘΚ

ΝΫΧ® Nginx ΖΰΈώΤς

Α≤ΉΑ Keepalived

–ιΡβ ip

Α≤ΉΑ KeepalivedΘΚ

| [root@192 usr]#

yum install keepalived -y

[root@192 usr]# rpm -q -a keepalived

keepalived-1.3.5-16.el7.x86_64 |

–όΗΡ≈δ÷ΟΈΡΦΰΘΚ

| [root@192 keepalived]#

cd /etc/keepalived

[root@192 keepalived]# vi keepalived.conf |

Ζ÷±πΫΪ»γœ¬≈δ÷ΟΈΡΦΰΗ¥÷Τ’≥ΧυΘ§Η≤Η«Βτ keepalived.confΘ§–ιΡβ ip ΈΣ 192.168.25.50ΓΘ

Ε‘”Π÷ςΜζ ip –η“Σ–όΗΡΒΡ «ΘΚ

smtp_server 192.168.25.147Θ®÷ςΘ©smtp_server 192.168.25.147Θ®±ΗΘ©

state MASTERΘ®÷ςΘ© state BACKUPΘ®±ΗΘ©

| global_defs

{

notification_email {

acassen@firewall.loc

failover@firewall.loc

sysadmin@firewall.loc

}

notification_email_from Alexandre.Cassen@firewall.loc

smtp_server 192.168.25.147

smtp_connect_timeout 30

router_id LVS_DEVEL # ΖΟΈ ΒΡ÷ςΜζΒΊ÷Ζ

}

vrrp_script chk_nginx {

script "/usr/local/src/nginx_check.sh"

# Φλ≤βΈΡΦΰΒΡΒΊ÷Ζ

interval 2 # Φλ≤βΫ≈±Ψ÷¥––ΒΡΦδΗτ

weight 2 # »®÷Ί

}

vrrp_instance VI_1 {

state BACKUP # ÷ςΜζMASTERΓΔ±ΗΜζBACKUP

interface ens33 # ΆχΩ®

virtual_router_id 51 # Ά§“ΜΉι–η“Μ÷¬

priority 90 # ΖΟΈ ”≈œ»ΦΕΘ§÷ςΜζ÷ΒΫœ¥σΘ§±ΗΜζΫœ–Γ

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.25.50 # –ιΡβip

}

} |

ΤτΕ·ΟϋΝν»γœ¬ΘΚ

| [root@192 sbin]#

systemctl start keepalived.service |

ΖΟΈ –ιΡβ ip ≥…ΙΠΘΚ

ΙΊ±’÷ςΜζ 147 ΒΡ Nginx ΚΆ KeepalivedΘ§ΖΔœ÷»‘»ΜΩ…“‘ΖΟΈ ΓΘ

‘≠άμΫβΈω

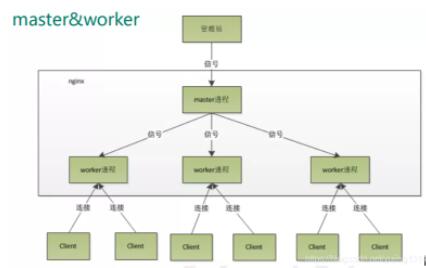

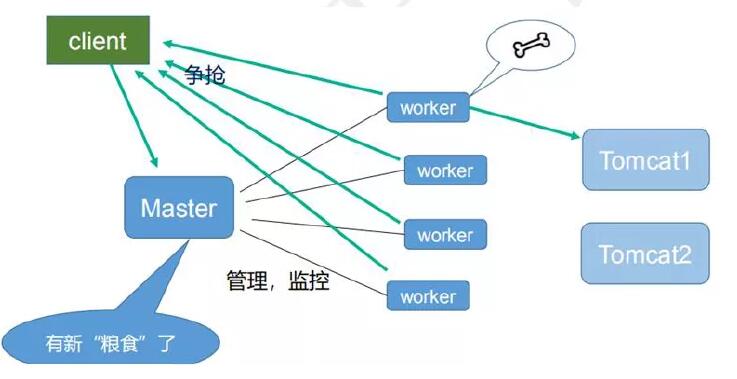

»γœ¬ΆΦΘ§ΨΆ «ΤτΕ·ΝΥ“ΜΗω masterΘ§“ΜΗω workerΘ§master «Ιήάμ‘±Θ§worker «ΨΏΧεΙΛΉςΒΡΫχ≥ΧΓΘ

worker »γΚΈΙΛΉςΘΩ»γœ¬ΆΦΘΚ

–ΓΫα

worker ΐ”ΠΗΟΚΆ CPU ΐœύΒ»ΘΜ“ΜΗω master ΕύΗω worker Ω…“‘ Ι”Ο»»≤Ω πΘ§Ά§ ±

worker «ΕάΝΔΒΡΘ§“ΜΗωΙ“ΝΥ≤ΜΜα”ΑœλΤδΥϊΒΡΓΘ |