| БрМЭЦМі: |

| БОЮФРДздгкsohuЃЌБОЮФНщЩмдкKubernetesЦНЬЈЩЯУцЛљгкIstioЕФСїСПЙмРэзіЛвЖШЗЂВМЁЂЛвЖШВтЪдЕФЪЕМљвдМАвЛаЉОбщЃЌЯЃЭћЖдФњФмгаЫљАяжњЁЃ |

|

IstioФПЧАЪЧService MeshзюЪмЛЖгЕФЪЕЯжЗНЪНЃЌСїСПЙмРэЪЧIstioвЛИіЗЧГЃКЫаФЕФЙІФмЁЃБОЮФжївЊНщЩмдкKubernetesЦНЬЈЩЯУцЛљгкIstioЕФСїСПЙмРэзіЛвЖШЗЂВМЁЂЛвЖШВтЪдЕФЪЕМљвдМАгіЕНЕФИїжжПгЁЃ

Service MeshЪЧЪВУДЃП

ЗўЮёЭјИёЃЈService MeshЃЉЪЧжТСІгкНтОіЗўЮёМфЭЈбЖЕФЛљДЁЩшЪЉВуЁЃЫќИКд№дкЯжДњдЦдЩњгІгУГЬађЕФИДдгЗўЮёЭиЦЫРДПЩППЕиДЋЕнЧыЧѓЁЃЪЕМЪЩЯЃЌService

Mesh ЭЈГЃЪЧЭЈЙ§вЛзщЧсСПМЖЭјТчДњРэЃЈSidecar proxyЃЉЃЌгыгІгУГЬађДњТыВПЪ№дквЛЦ№РДЪЕЯжЃЌЖјЮоашИажЊгІгУГЬађБОЩэЁЃ

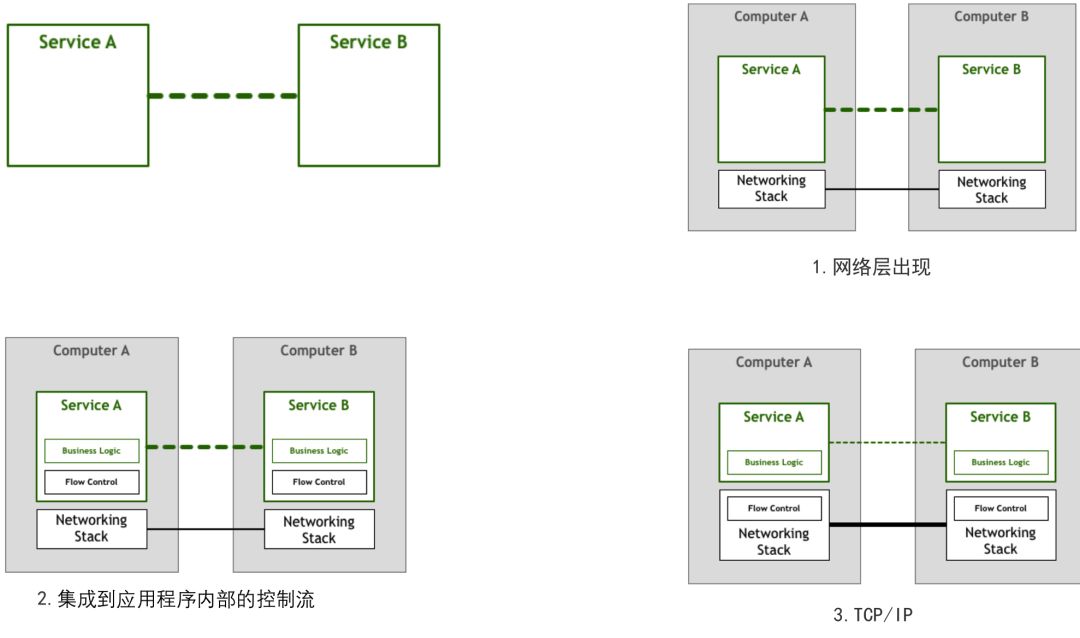

ПЩФмвЛОфЛАКмФбРэНтService MeshЕНЕзЪЧЪВУДЁЃЮвУЧЭЈЙ§СНИіГщЯѓЕФГЁОАРДПДService MeshЪЧдѕУДЗЂеЙЕФЁЃ

ЕквЛИіЪЧЗўЮёЭЈбЖЕФЗЂеЙЃЌЕБЮвУЧгавЛИіашЧѓЪЧСНИіЗўЮёжЎМфНјааЭЈбЖЁЃ

зюдЪМгІИУОЭЪЧЭЈЙ§ЭјЯпЛЅСЊетжжзюМђЕЅЕФЗНЪНЁЃ

ЫцзХМЦЫуЛњБфЕУдНРДдНБувЫКЭдНРДдНСїааЃЌСЌНгЪ§СПКЭЭЈЙ§ЫќУЧЕФЪ§ОнСПМБОчдіМгЁЃЫцзХШЫУЧдНРДдНвРРЕЭјТчЯЕЭГЃЌЙЄГЬЪІашвЊШЗБЃЫћУЧЙЙНЈЕФШэМўЗћКЯгУЛЇЫљашЕФЗўЮёжЪСПЃЌГіЯжСЫЭјТчВуЁЃШчЭМ1ЁЃ

ДЫЪБОЭЖдЮвУЧЕФГЬађЬсГіСЫЬєеНЃЌБШШчЫЕСїСППижЦЁЃ

ЯыЯѓвЛжжГЁОАЃЌМЦЫуЛњAвдИјЖЈЕФЫйТЪЯђМЦЫуЛњBЗЂЫЭзжНкЃЌЕЋВЛФмБЃжЄBНЋвдвЛжТЧвзуЙЛПьЕФЫйЖШДІРэНгЪеЕФзжНкЁЃР§ШчЃЌBПЩФмУІгкВЂаадЫааЦфЫћШЮЮёЃЌЛђепЪ§ОнАќПЩФмЮоађЕНДяЃЌЖјBБЛзшжЙЕШД§гІИУЪзЯШЕНДяЕФЪ§ОнАќЁЃетвтЮЖзХВЛНіAВЛОпБИBЕФдЄЦкадФмЃЌЖјЧвЛЙПЩФмЪЙЪТЧщБфЕУИќдуЃЌвђЮЊЫќПЩФмЛсЪЙBГЌдиЃЌЯждкБиаыНЋЫљгаетаЉДЋШыЕФЪ§ОнАќХХЖгЕШД§ДІРэЁЃ

ЕБГіЯжетжжЮЪЬтЪБЃЌзюМђЕЅЕФОЭЪЧдквЕЮёРяУцЪЕЯжСїСППижЦЕФТпМЁЃШчЭМ2ЁЃ

ММЪѕЗЩЫйЗЂеЙЃЌКмПьTCP/IPГіЯжЃЌНЋСїПижЦКЭаэЖрЦфЫћЮЪЬтФЩШыЭјТчЖбеЛБОЩэЁЃетвтЮЖзХИУЖЮДњТыШдШЛДцдкЃЌЕЋЫќвбДгФњЕФгІгУГЬађЬсШЁЕНФњЕФВйзїЯЕЭГЬсЙЉЕФЕзВуЭјТчВуЁЃ

ЮвУЧЗЂЯжЃЌЫцзХММЪѕЕФЗЂеЙЃЌЙЋЙВЕФЖЋЮїдНРДдНЯТГСЁЃ

ЕкЖўИіГЁОАЃЌЪЧЮЂЗўЮёЪБДњЕФвЛИіГЁОАЃЌЮЂЗўЮёЪБДњИјЮвУЧДјРДСЫКмЖрЛњгіКЭаТЕФЬєеНЁЃ

аТЕФЛњгіБШШчЫЕЮвУЧПЩвдШУЗўЮёЕФжАд№ИќЕЅвЛЃЌЗЂВМИќбИЫйЁЃ

ЬєеНОЭЯёЪЧЮвУЧЭМ1жаЕФЮЪЬтЃЌЗўЮёЗЂЯжКЭШлЖЯЁЃ

зюПЊЪМгіЕНетбљЕФЮЪЬтЃЌПЊЪМЕФЗНЪНвРОЩЪЧдкЮвУЧЕФДњТыжаЃЌБраДЖдгІЕФТпМРДзіЁЃШчЭМ1ЁЃ

ЫцзХММЪѕЗЂеЙЃЌгаСЫзЈУХЕФПтРДАбЙЋЙВЕФЖЋЮїГщЯѓГіРДЃЌЮвУЧжЛашвЊзівЛИівРРЕЁЃШчЭМ2ЁЃ

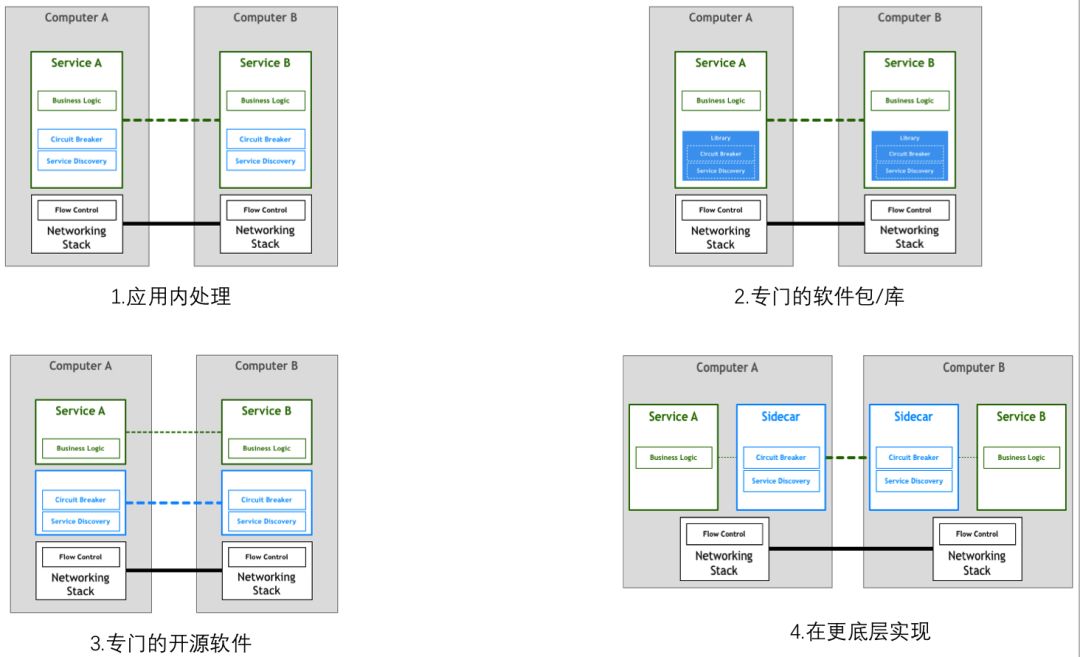

гыЮвУЧдкЭјТчЖбеЛжаПДЕНЕФРрЫЦЃЌЗЧГЃЯЃЭћНЋДѓЙцФЃЗжВМЪНЗўЮёЫљашЕФЙІФмЬсШЁЕНЕзВуЦНЬЈжаЁЃ

ШЫУЧЪЙгУИќИпМЖБ№ЕФавщЃЈШчHTTPЃЉБраДЗЧГЃИДдгЕФгІгУГЬађКЭЗўЮёЃЌЩѕжСВЛПМТЧTCPШчКЮПижЦЦфЭјТчЩЯЕФЪ§ОнАќЁЃетжжЧщПіЪЧЮвУЧЖдЮЂЗўЮёЫљашвЊЕФЃЌЦфжаДгЪТЗўЮёЙЄзїЕФЙЄГЬЪІПЩвдзЈзЂгкЫћУЧЕФвЕЮёТпМЃЌБмУтРЫЗбЪБМфБраДздМКЕФЗўЮёЛљДЁМмЙЙДњТыЛђЙмРэећИіЛњЖгЕФПтКЭПђМмЁЃШчЭМ3ЁЃ

ЖјетбљЕФЪЕЯжЗНЪНБШНЯРЇФбЃЌгкЪЧКѓајгавЛИіаТЕФЗНЪНЁЃSidecarЃЌЫќЪЧжиаТЦєЖЏвЛИіНјГЬЃЌРДРЙНиЫљгаЕФСїСПЁЃгкЪЧгаСЫЭМ4етжжВПЪ№ЗНЪНЁЃ

ЕБЮвУЧгаКмЖрЗўЮёВПЪ№ЕФЪБКђЃЌОЭПДЕНЕФећЬхВПЪ№ЭМОЭБфГЩСЫКмЖрsidecarжЎМфЕФЭЈбЖЁЃФЧУДгжвЛИіаТЕФЬєеНЃЌОЭЪЧsidecarгІИУШчКЮЙмРэЁЃФЧУДcontrol

planeОЭБфГЩСЫвЛИіВЛПЩЛђШБЕФзщМўЁЃгУРДЙмРэЮвУЧЕФsidecarЁЃ

гкЪЧгаСЫзюжеService MeshЕФМмЙЙЭМЁЃ

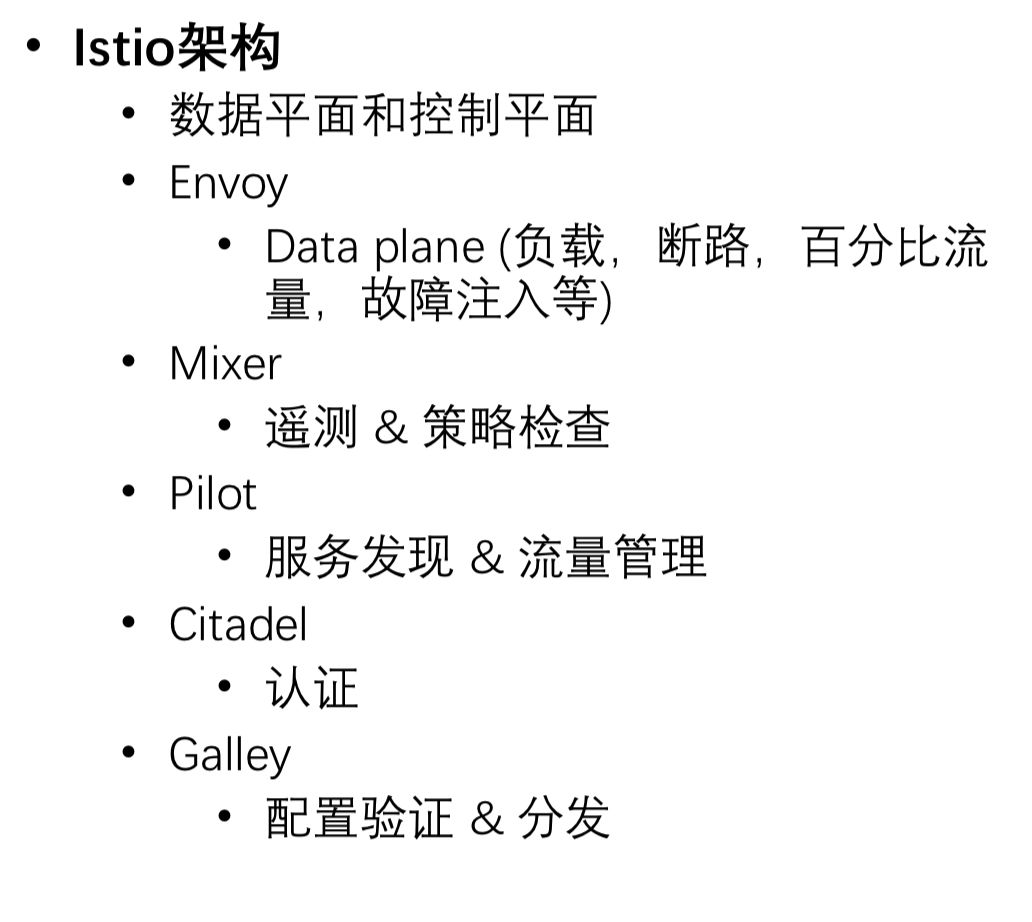

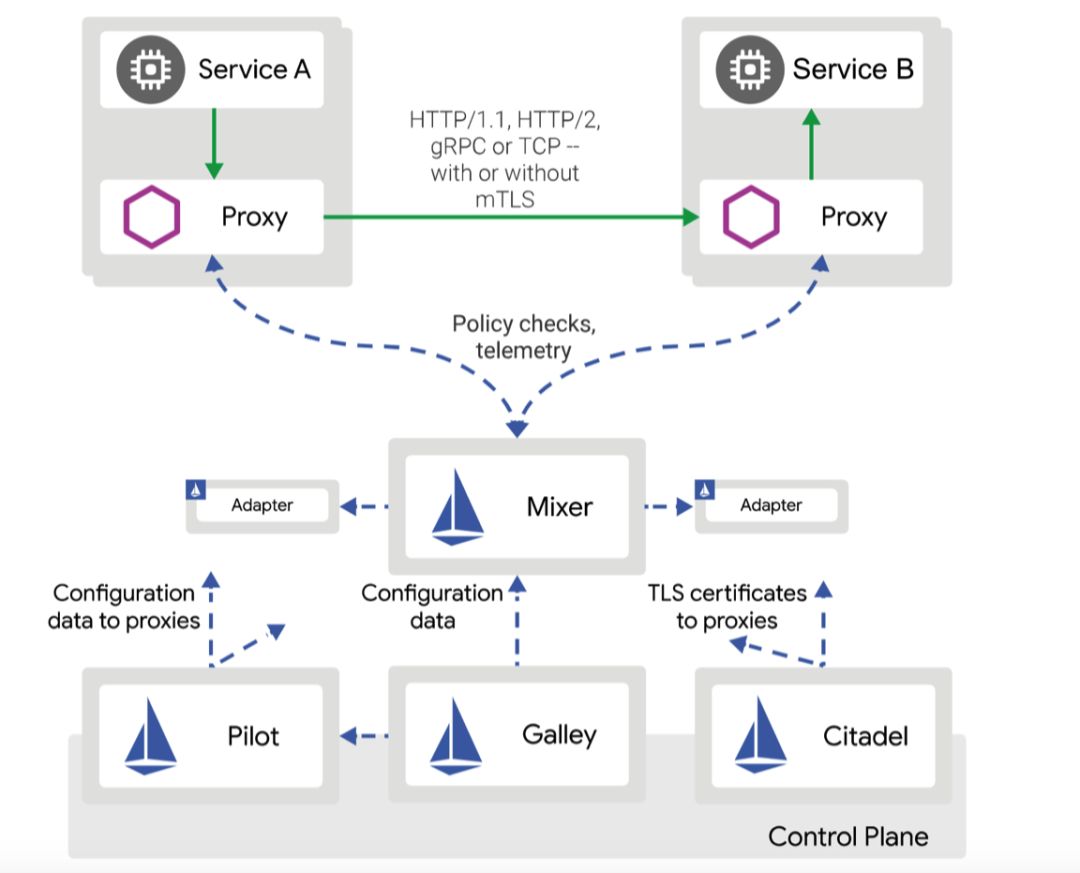

IstioЪЧЪВУДЃП

МђЕЅЫЕЪЧвЛжжService MeshМмЙЙЕФЪЕЯжЁЃ

ЙйЭјЕФУшЪіЮЊIstio ЬсЙЉвЛжжМђЕЅЕФЗНЪНРДЮЊвбВПЪ№ЕФЗўЮёНЈСЂЭјТчЃЌИУЭјТчОпгаИКдиОљКтЁЂЗўЮёМфШЯжЄЁЂМрПиЕШЙІФмЃЌжЛашвЊЖдЗўЮёЕФДњТыНјааКмЩйЛђВЛашвЊзіШЮКЮИФЖЏЁЃЯывЊШУЗўЮёжЇГжIstioЃЌжЛашвЊдкФњЕФЛЗОГжаВПЪ№вЛИіЬиЪтЕФsidecarДњРэЃЌЪЙгУIstioПижЦЦНУцЙІФмХфжУКЭЙмРэДњРэЃЌРЙНиЮЂЗўЮёжЎМфЕФЫљгаЭјТчЭЈаХЁЃ

IstioИїФЃПщЕФжАд№ЃК

IstioЕФМмЙЙЭМЃК

ЮЊЪВУДвЊгУIstioЃП

Cloud NativeдЦдЩњЧїЪЦ

ЖргябдЃКJavaЁЂPythonЁЂGo

ЧПДѓЕФСїСПЙмРэ

ЮЊЪВУДбЁдёIstioЃП

GoogleМгГжЁЃ

вЛИіЗЧГЃЛюдОЕФПЊдДЯюФПЁЃ

ИќаТЦЕДЮЁЃ2дТПЊЪМЕНЯждкИќаТСЫ18ИіАцБОЁЃ

зюНќвЛДЮKubeConДѓЛсЩЯЃЌIstioЪЧвЛИіГіЯжЦЕДЮЗЧГЃИпЕФДЪЁЃ

ЙњФкИїДѓдЦЦНЬЈЕФЪзбЁЃЌАЂРяЃЌЬкбЖЃЌЛЊЮЊЃЌТьвЯН№ЗўЁЁ

IstioВтЪдЛЗОГЪЕМљ

ЮЊЪВУДгжгавЛИіВтЪдЛЗОГЃП

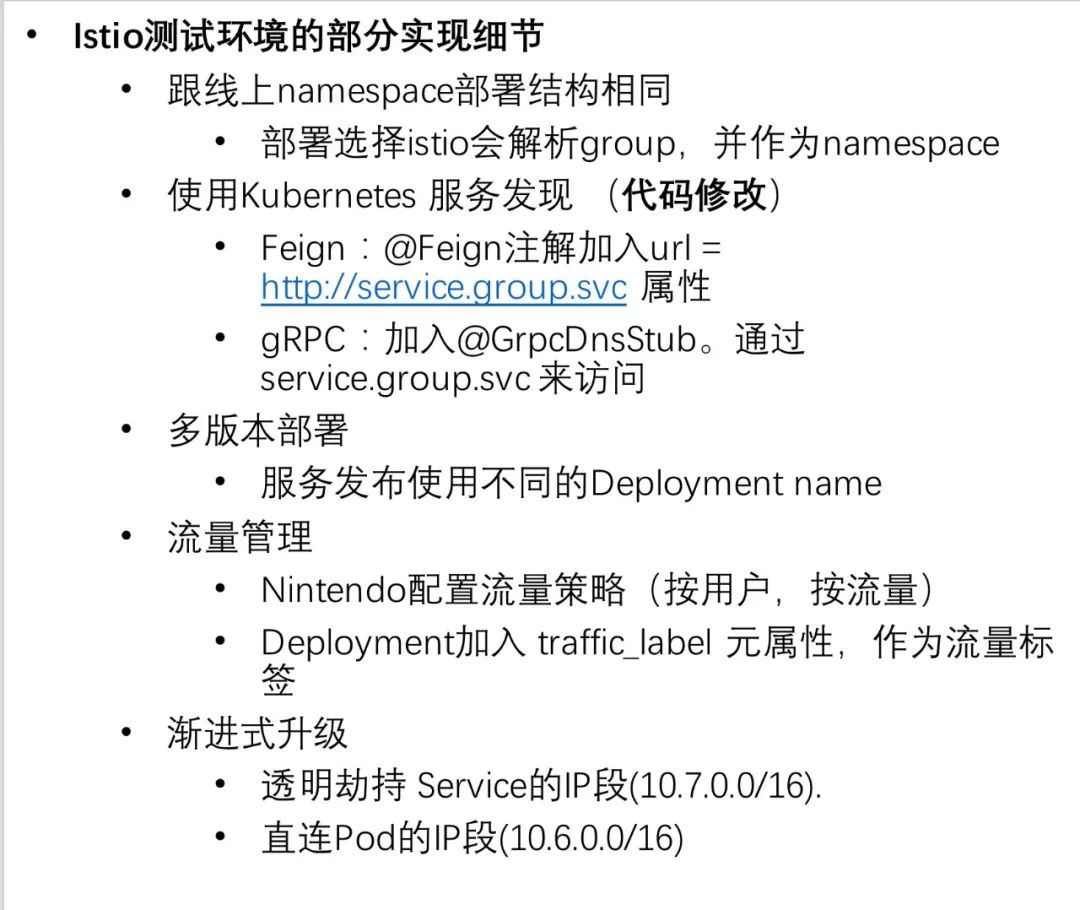

ИњЯпЩЯЛЗОГНсЙЙВЛЭЌЁЃЯпЩЯНсЙЙЪЧЭЈЙ§git groupВ№ЗжnamespaceЁЃВтЪдЛЗОГдкЭЌвЛИіnamespaceЯТХмЫљгаЗўЮёЁЃ

ЖрЛЗОГЁЃЯждкВтЪдЛЗОГга2ИіЃЌУПИіРяУцХмЫљгаЕФЛљДЁЗўЮёЃЌЕМжТPodЪ§КмЖрЃЌгаЖЮЪБМфЃЌВтЪдЛЗОГЕФPodзмЪ§БШЩњВњЛЙвЊЖрЁЃЕЋЪЧСїСПШДЩйКмЖрЁЃ

ЖргябдЁЃЯждкжївЊЪЧJavaММЪѕеЛЃЌКЭВПЗжЕФPythonЃЌЮДРДЛЙгаGoММЪѕеЛЁЃJavaММЪѕеЛЕФЛАЃЌSpring

CloudзіЗўЮёЗЂЯжЃЌШлЖЯЃЌИКдиЕШЙІФмЪЧУЛгаЮЪЬтЃЌЕЋЪЧдкЖрИіММЪѕеЛЕФЪБКђЃЌЮвУЧОЭашвЊдйзіКмЖрЪТЧщРДМцШнЁЃ

СїСПЙмРэЁЃОЭЪЧашвЊИќМгЧПДѓЕФСїСПЙмРэЃЌБШШчЛвЖШЗЂВМЃЌЛљгкБШР§ЕФСїСПВпТдЁЃ

ЯждкЕФСїСПЙмРэЗНЪНЃК

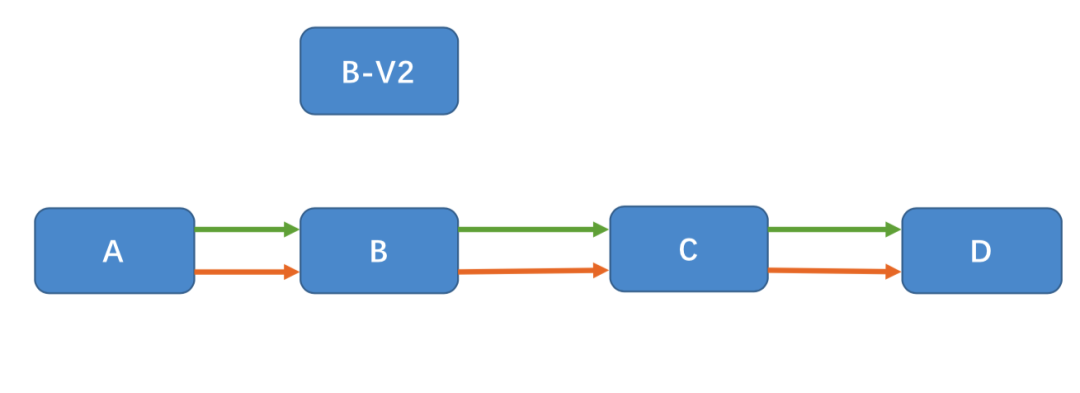

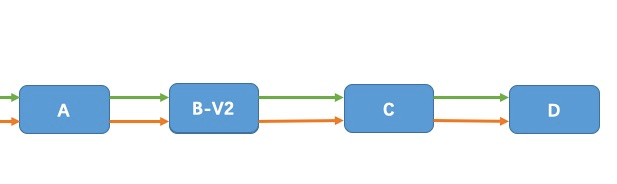

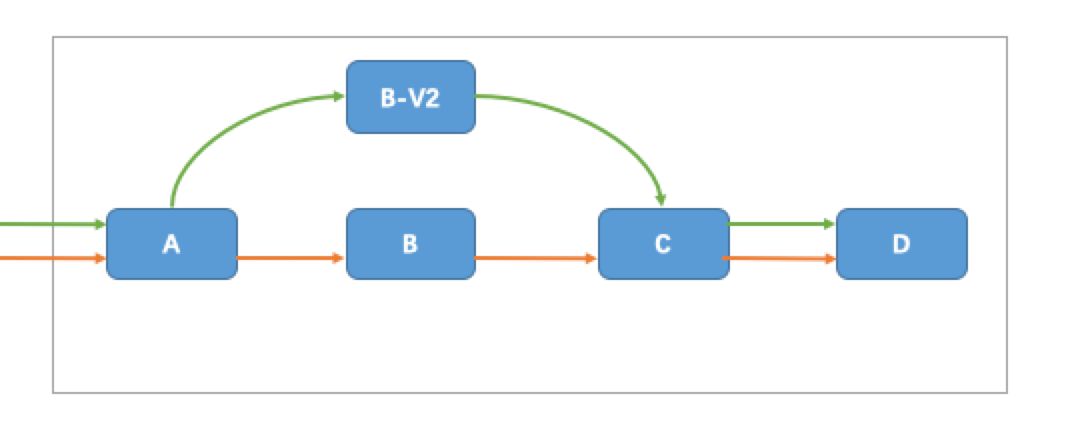

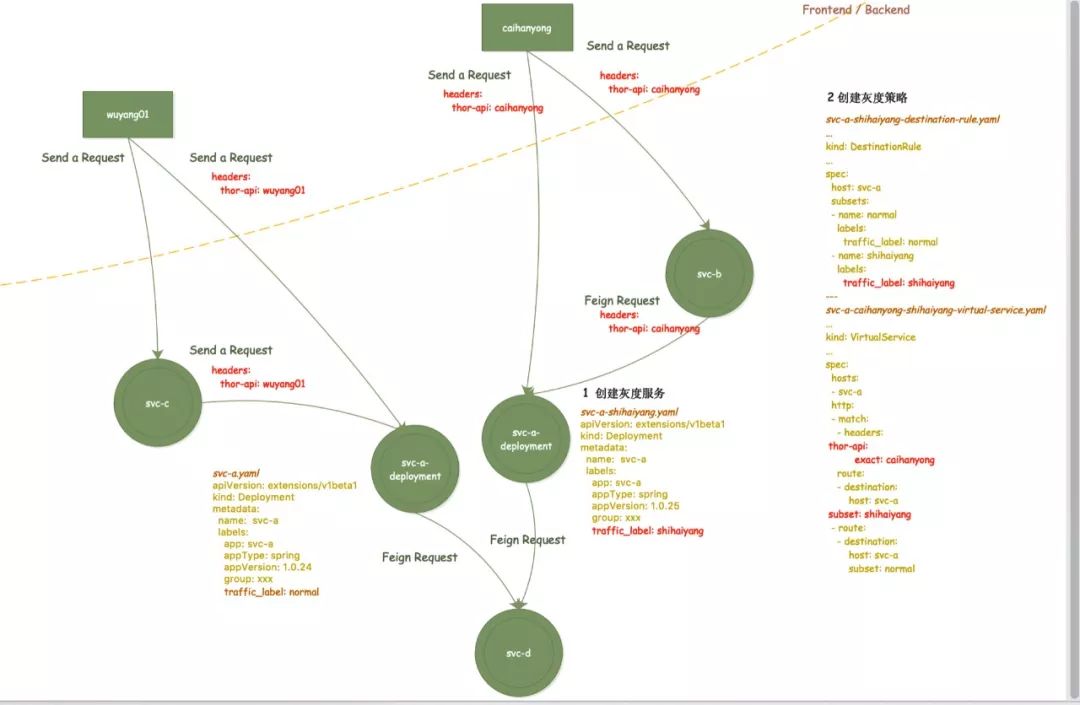

ЕБгаA-B-C-DЕФвЛИіЕїгУСДЪБЃЌЕБBгааТАцБОV2ЗЂВМЃЌЛсАбBРЯАцБОЬцЛЛЁЃЕМжТЫљгаЕФШЫдБВтЪдЕФСїСПЖМЪЧЯрЭЌЕФЗўЮёЃЌетбљЕФВтЪдЛЗОГОЭБфЕУКмВЛЮШЖЈЃЌЩЯгЮЗўЮёПЩФмЛсЪмЕНЯТгЮЗўЮёЗЂВМЕФгАЯьЁЃ

ЮвУЧЦкЭћЕФСїСПЗНЪНЃК

ЮвУЧЦкЭћЕФЗНЪНЪЧЃЌЕБBЗЂВМаТАцБОV2ЪБЃЌИњBРЯАцБОЭЌЪБдЫааЃЌжЛЪЧЖдгІВтЪдB-V2ЕФВтЪдШЫдБЕФСїСПЛсДђЕНB-V2ЗўЮёЁЃЖјЦфЫћШЫЕФСїСПвРШЛзпA-B-C-DЁЃ

ЮвУЧВтЪдЛЗОГЕФВПЗжЪЕЯжЯИНкЃК

ХфжУШчЭМЃК

ГЃМћЮЪЬт

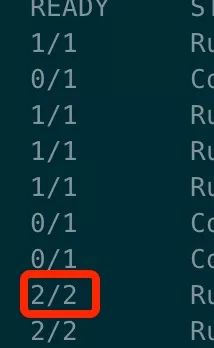

PodЯдЪО2/2ЮЪЬтЃПPodШежОПДВЛСЫСЫЃЌЬсЪОЃК

Error from server (BadRequest): a container name

must be specified for pod spring-account-admin-normal-dcd6544cd-ckxjr,

choose one of: [istio-proxy account-admin]

вђЮЊЃК

ашвЊбЁдёcontainerЁЃ

ашвЊ-cВЮЪ§РДжИЖЈcontainerУћГЦЁЃ

ConsulШЁЯћзЂВсЮЪЬтЃПдРДЪЙгУConsulзіЗўЮёЗЂЯжЃЌЕБЭЃPodЪБЃЌУЛгаДгConsulЩЯзЂЯњЁЃ

вђЮЊЃКдквЕЮёcontainerЙиБеЕФЪБКђЃЌenvoyвВЙиБеСЫЁЃЫљвдЗУЮЪЪЇАмСЫЁЃissue#7136ЁЃ

НтОіЃКpreStopНХБОЃЌдкEnvoyЙиБеЪБЃЌЛсМьВщЪЧЗёгаЗЧEnvoyЕФНјГЬдкдЫааЁЃШчЙћгаЃЌвВЛсГЌЪБжиЪдЁЃЕШД§вЕЮёЗўЮёЕФгХбХЭЃЛњЁЃ

ШнЦїЦєЖЏЫГађЮЪЬтЃПPodЦєЖЏЕФЪБКђЃЌСЌНгconsul timeoutЮЪЬтЁЃ

вђЮЊЃКжївЊЪЧвђЮЊЗўЮёЦєЖЏЕФЫГађЮЪЬтЁЃЕБPodжавЕЮёcontainerЦєЖЏЕФЪБКђЃЌEnvoyвВдкЦєЖЏЃЌЕЋЪЧinitContainerвбОЦєЖЏЭъБЯЃЌiptablesвбОХфжУКУСЫЁЃЫљвдЧыЧѓДђВЛГіШЅСЫЁЃ

НтОіЃКЮвУЧдкШнЦїЦєЖЏЕФЪБКђЃЌМгСЫГЌЪБжиЪдЁЃ

ЗУЮЪЭтЭјЮЪЬтЁЃдкВПЪ№ЭъistioжЎКѓЃЌЮвУЧЫљгаЧыЧѓЭтЭјЕФurlЖМЗЕЛиЪЇАмЁЃ

вђЮЊЃКIstioЕФiptablesЙцдђЁЃЪЧРЙНиЫљгаЕФЧыЧѓЁЃ

НтОіЃКЭЈЙ§ХфжУIstioЕФВЮЪ§global.proxy.includeIPRangesРДжИЖЈEnvoyРЙНиЕФСїСПЁЃжЛРЙНиService

IPЖЮСїСПЁЃ

НЅНјЪНЩ§МЖIstioдѕУДзіЃП

жївЊЪЧМцШнжЎЧАЕФЧыЧѓСДТЗЁЃ

дРДЭЈЙ§ConsulЗўЮёЗЂЯжЃЌБОЕиевЕНConsulжаДцДЂЕФЗўЮёЪЕР§ЃЌМДPod IPЁЃЭЈбЖЕФЪБКђЪЙгУPod

IPЁЃ

ашвЊЛвЖШЕФСїСПашвЊаоИФЮЊKubernetesЕФЗўЮёЗЂЯжЃЌМДЪЙгУService IPНјааЭЈбЖЃЌEnvoyвВжЛРЙНиservice

ipЕФСїСПЁЃМДЧјЗжSVCЕФIPЖЮЃЌКЭPodЕФIPЖЮЁЃетбљЕБвЕЮёВЛИФЖЏДњТыЪБЃЌЛЙЪЧзпдРДЕФЧыЧѓСДТЗЃЌашвЊЪЙгУЛвЖШЙІФмЪБЃЌПЩвдаоИФДњТыЃЌРДжЇГжЛвЖШВтЪдЁЃ

PrometheusФкДцГХБЌЮЪЬтЁЃгавЛДЮВтЪдЛЗОГвЛЩЯЮчВЛФмгУЁЃ

вђЮЊЃКПЊЯфМДгУЕФPrometheusЁЃ

НтОіЃКResources limitsЁЃ

gRPC Not StartedЮЪЬтЃЌгавЛДЮЩ§МЖЭъgRPC StarterжЇГжkeep headerжЎКѓЃЌgRPCЕФЧыЧѓХМЗЂЕФГіЯжgRPC

Not StartedвьГЃЁЃ

вђЮЊЃКашвЊЪЙгУheaderжаЪ§ОнЗжСїЃЌЯпГЬжаgRPCЕїгУЃЌheaderЖЊЪЇЁЃ

НтОіЃКЬэМгШнДэЁЃ

Q&A

QЃКШчКЮХаЖЯcheckЁЂquotaЯТЗХistio-proxyв§ШыЕФЮЪЬтЃП

AЃКЕУЭЈЙ§бЙВтСЫЃЌПДадФмЫ№КФСЫЁЃЮвУЧКѓајЛсМгШыMixerЕФЙІФмдйбЙВтвЛТжЁЃЯждкзіЕФбЙВтЛЙЪЧВЛПЊMixerЙІФмЕФГЁОАЯТбЙЕФЁЃвђЮЊЮвУЧЯпЩЯФПЧАЛЙВЛДђЫуПЊMixerЁЃ

QЃКФмЗёИјИіdemoЃП

AЃКФПЧАЛЙУЛгаПЊЗХдкЭтУцЕФdemoЁЃПЩвдИјаЉЫМТЗЃЌЧыЮЪФуЯывЊЪВУДвЊЕФЙІФмЕФdemoЃПУЛЪЕМљЙ§ЃЌЬ§РэТлзмЪЧгаЕуащЃЁПЩвдЪЕМљвЛЯТЁЃЮвУЧжївЊЪЧгУЕФIstioЃЈEnvoyЃЉЕФСїСПЙмРэЕФЙІФмЁЃжївЊЪЧвЊХфжУIstioЕФСїСПЙмРэВпТдЁЃИјвЕЮёШЫдБдйИјЫћУЧХфжУyamlЮФМўЃЌбЇЯАГЩБОЬЋДѓЃЌЫљвдзіСЫПЩЪгЛЏЃЌгаАДСїСПЃЌАДгУЛЇЃЌздЖЈвхШ§жжЗНЪНЁЃжївЊЪЧАбвГУцХфжУБрвыГЩyamlСїСПХфжУЁЃ

QЃКIstioУПИіЗўЮёжаЕУЕНЕФЗУЮЪIPЖМЪЧ127.0.0.1ЃЌетИіИУдѕУДИуЃПФмФУЕНreal client

ipЃП

AЃКkubectl get svcгІИУПЩвдВщЕНclusteripЃЌНгзХQ3ЃЌappФУЕНЭтУцЗУЮЪЕФaddressЖМЪЧ127.0.0.1ЕФЁЃ

рХЃЌЪЧгаетИіЮЪЬтЃЌЮвУЧвВгіЕНСЫЃЌФПЧАЛЙУЛгаНтОіЗНАИЁЃEnvoyЕФШежОжаЪЧПЩвдФУЕНЕФЃЌКѓајашвЊПДПДдѕУДДјЙ§ШЅЁЃ

QЃКЗўЮёЕФгІгУдЫааШежОдкIstioжаШчКЮЛёШЁЛђепВщПДЃЌР§Шчlog4jПижЦЬЈЕФЪфГіЃП

AЃКгІгУдЫааШежООЭдкгІгУШнЦїЩЯПДАЁЁЃЮвУЧЪЧЭЈЙ§БъзМЪфГіЪеМЏЕНСЫInfluxDBжаЁЃ

QЃКEnvoyЕФCPUЁЂФкДцЕФrequestЁЂlimitвЛАуХфжУЖрЩйЃП

AЃКЮвУЧбЙВтЕФЪЧФЌШЯЕФEnvoyЕФзЪдДЯожЦЁЃУЛгааоИФФЌШЯЕФзЪдДЯожЦЁЃ

cpu: "2"

memory: 1Gi

cpu: 100m

memory: 128Mi

QЃКРяУцдкХфКЯSpring ClundгаБивЊТ№ЃП

AЃКИаОѕУЛБивЊЃЌжиИДСЫЃЌIstioШУГЬађдБИќЙизЂвЕЮёЃЌНЋЮЌЛЄЙмРэЗжРыЁЃ ЮвУЧжЎКѓЛсТНајгУIstioЕФЗНЪНЬцЛЛжЎЧАдкSpring

CloudЩЯЕФЪЕЯжЁЃ

QЃКгаХфКЯAlibaba NacosЪдЪдТ№ЪЕбщТфЕиЕФзюКУЃЌconsul.etcdбЁФФИіКУЕуЃП

AЃКУЛгаЪЙгУЙ§Alibaba NacosЃЌЮвУЧЮДРДЛсзпKubernetesЕФЗўЮёЗЂЯжЃЌЫљвдЛсбЁдёetcdАЩЁЃ

QЃКSpring CloudЯђIstioЧЈвЦКУЧЈвЦТ№ЃП

AЃКБШНЯКУЧЈвЦЁЃЮвУЧгіЕНЕФЮЪЬтжївЊОЭЪЧЭЈбЖЕФЮЪЬтЁЃЩцМАЕНFeignКЭgRPCСНжжЁЃашвЊЩ§МЖвЛЯТstarterЃЌДЋЕнвЛЯТheaderЁЃвђЮЊЮвУЧЕФСїСПБъЧЉЪЧдкheaderжаДЋЕнЁЃЛЙгавЛИіживЊЕФОЭЪЧЗжЯэРяЬсЕНЕФЃЌЗўЮёЗЂЯжЮЪЬтЁЃвђЮЊвЊзіНЅНјЪНЩ§МЖЃЌВЛФмвЛЯТОЭИјЫљгаЕФЗўЮёЩЯIstioЃЌБпдЕЗўЮёЯШЩЯЃЌШШУХЗўЮёКѓЩЯЃЌЫљвдвЊМцШнжЎЧАЕФЗўЮёЗЂЯжЃЈConsulЃЉЃЌЭЌЪБгаСНИіЗўЮёЗЂЯжЛњжЦЕФЪБКђЛсгааЉЮЪЬтЁЃ |