| ±аәНЖәц: |

| ±ңОДАөЧФibmӘ¬±ңОДҢйЙЬБЛРФДЬІвКФµДёЕДоҰұАаРНҰұРФДЬІвКФУ¦УГіҰң°ӘЁБмУтӘ©ТФә°РФДЬІвКФіӘУГµДЦё±кµИПа№ШДЪИЭҰӘ |

|

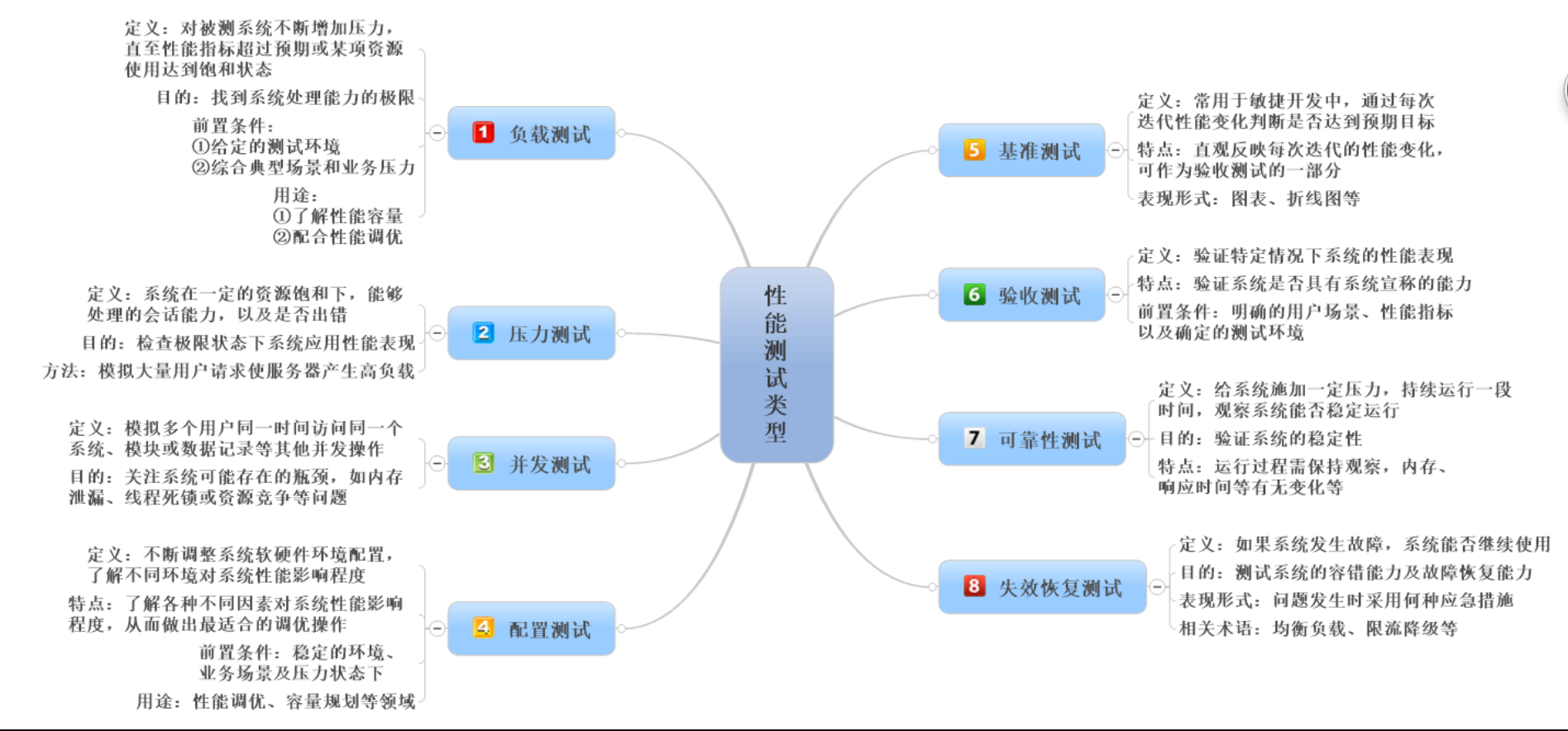

РФДЬІвКФµДёЕДо

¶ЁТеӘғИнәюµДРФДЬКЗИнәюµДТ»ЦЦ·З№¦ДЬМШРФӘ¬Ль№ШЧұµДІ»КЗИнәюКЗ·сДЬ№»НкіЙМШ¶ЁµД№¦ДЬӘ¬¶шКЗФЪНкіЙёГ№¦ДЬК±Х№КңіцАөµДә°К±РФҰӘ

УЙ¶ЁТеүЙЦҒРФДЬ№ШЧұµДКЗИнәюµД·З№¦ДЬМШРФӘ¬ЛщТФТ»°гАөЛµРФДЬІвКФҢйИлµДК±»ъКЗФЪ№¦ДЬІвКФНкіЙЦ®ғуҰӘФЪПµНі»щөҰ№¦ДЬІвКФСйЦ¤НкіЙҰұПµНіЗчУЪОИ¶ЁµДЗйүцПВӘ¬ІЕ»бҢшРРРФДЬІвКФӘ¬·сФтРФДЬІвКФКЗОЮТвТеµДҰӘБнНвӘ¬УЙ¶ЁТеЦРµДә°К±РФүЙЦҒРФДЬТІКЗТ»ЦЦЦё±кӘ¬үЙТФУГК±әд»тЖдЛьЦё±кАөғвБүӘ¬НЁіӘОТГЗ»бК№УГДіР©№¤ңЯ»тКЦ¶ОАөәмІвИнәюµДДіР©Цё±кКЗ·сөпµҢБЛТҒЗуӘ¬ХвңНКЗРФДЬІвКФҰӘ

РФДЬІвКФ¶ЁТеӘғЦёНЁ№эЧФ¶Ү»ҮµДІвКФ№¤ңЯДӘДв¶аЦЦХэіӘҰұ·еЦµТФә°ТміӘёғФШМхәюАө¶ФПµНіµДёчПоРФДЬЦё±кҢшРРІвКФҰӘ

РФДЬІвКФАаРН

»щЧәІвКФӘғФЪёшПµНіК©әУҢПµНС№Б¦К±Ә¬ІйүөПµНіµДФЛРРЧөүцІұәЗВәПа№ШКэЧцОҒ»щөҰІОүә

ёғФШІвКФӘғКЗЦё¶ФПµНіІ»¶ПµШФцәУС№Б¦»тФцәУТ»¶ЁС№Б¦ПВµДіЦРшК±әдӘ¬Ц±µҢ-

ПµНіµДДіПо»т¶аПоРФДЬЦё±көпµҢ°ІИ«БЩҢзЦµӘ¬І»¶ПәУС№К№ПµНіөпµҢЖүң±Ә¬ОҒµчУЕМṩІОүәКэңЭҰӘ

С№Б¦ІвКФӘғ

ӘЁ1Ә©ОИ¶ЁРФС№Б¦ІвКФӘғФЪІ»Н¬µДёш¶ЁµДМхәюПВӘЁ±ИИзДЪөжµДК№УГӘ¬Т»¶ЁК±әд¶ОДЪУР¶аЙЩЗлЗуµИӘ©Ә¬ПµНі±нПЦіцАөµДө¦АнӘ¬·өУ¦ДЬБ¦ӘЁХвАп»бүәВЗПµНіµДИЭөнДЬБ¦Ә¬»ЦёөДЬБ¦Ә©

ӘЁ2Ә©ЖЖ»µРФС№Б¦ІвКФӘғІ»¶ПәУС№Ә¬Ц±ЦБПµНі±ААӘӘ¬№ТµфӘ¬АөµГіцПµНіµДЧоөуіРКЬДЬБ¦ФЪДД¶щ

ОИ¶ЁРФІвКФӘғФЪёшПµНіәУФШТ»¶ЁТµОсС№Б¦µДЗйүцПВӘ¬К№ПµНіФЛРРТ»¶ОК±әдӘ¬ТФөЛәмІвПµНіКЗ·сОИ¶ЁҰӘ

Іұ·ұІвКФӘғІвКФ¶аёцУГ»§Н¬К±·ГОКН¬Т»ёцУ¦УГҰұН¬Т»ёцДӘүй»тХЯКэңЭәЗВәК±КЗ·сөжФЪЛАЛш»тХЯЖдЛыРФДЬОКМвӘ¬

К§Р§»ЦёөІвКФӘғХл¶ФУР¶аУа±ё·ЭғНёғФШңщғвµДПµНіЙиәЖ,әмІвИз№ыПµНіңЦІү·ұЙъ№КХПӘ¬ПµНіДЬ·сәМРшК№УГ

ЕдЦГІвКФӘғНЁ№э¶Ф±»ІвПµНіИнУІәю»·ңіµДµчХыӘ¬БЛҢвёчЦЦІ»Н¬»·ңі¶ФПµНіРФДЬУ°ПмµДіМ¶ИӘ¬өУ¶шХТµҢПµНіёчПоЧКФөµДЧоУЕ·ЦЕдФФт

РФДЬІвКФУ¦УГіҰң°ӘЁБмУтӘ©

РФДЬІвКФУ¦УГіҰң°ӘЁБмУтӘ©ЦчТҒУРӘғ

ДЬБ¦СйЦ¤Ұұ№ж»®ДЬБ¦ҰұРФДЬµчУЕҰұИ±ПЭ·ұПЦҰұРФДЬ»щЧә±ИҢПӘ¬

ПВ±нәтµӨҢйЙЬғН¶Ф±ИБЛХвәёёціҰң°µДёчЧФУГНңғНМШµгӘғ

ПВ±нОҒРФДЬІвКФУ¦УГБмУтУлІвКФ·Ң·Ё№ШБҒӘғ

РФДЬІвКФіӘУГµДЦё±к

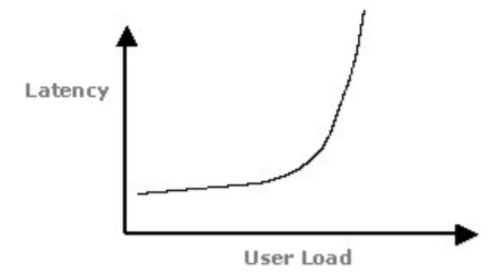

1ҰұПмУ¦К±әдӘЁResponse TimeӘ©

¶ЁТеӘғөУУГ»§·ұЛНТ»ёцЗлЗуµҢУГ»§ҢУКХµҢ·юОсЖч·µ»ШµДПмУ¦КэңЭХв¶ОК±әдңНКЗПмУ¦К±әд

әЖЛг·Ң·ЁӘғResponse time = ӘЁНшВзК±әд + У¦УГіМРтө¦АнК±әдӘ©

ғПАнµДПмУ¦К±әд 2/5/10 ӘЁ2ГлЦ®ДЪёшүН»§ПмУ¦±»УГ»§ИПОҒКЗ·ЗіӘУРОьТэБ¦µДӘ¬5ГлЦ®ДЪӘ¬±ИҢПФгёвӘ¬10ГлЦ®ДЪӘ¬ФгёвµДУГ»§МеСйӘ¬і¬№э10ГлӘ¬ЗлЗуК§°ЬӘ©

ПмУ¦К±әд-ёғФШ¶ФУ¦№ШПµӘғ

НәЦР№ХµгЛµГчӘғ

1ҰұПмУ¦К±әдН»И»ФцәУ

2ҰұТвО¶ЧЕПµНіµДТ»ЦЦ»т¶аЦЦЧКФөАыУГөпµҢµДә«ПЮ

3ҰұНЁіӘүЙТФАыУГ№ХµгАөҢшРРРФДЬІвКФ·ЦОцУл¶ЁО»

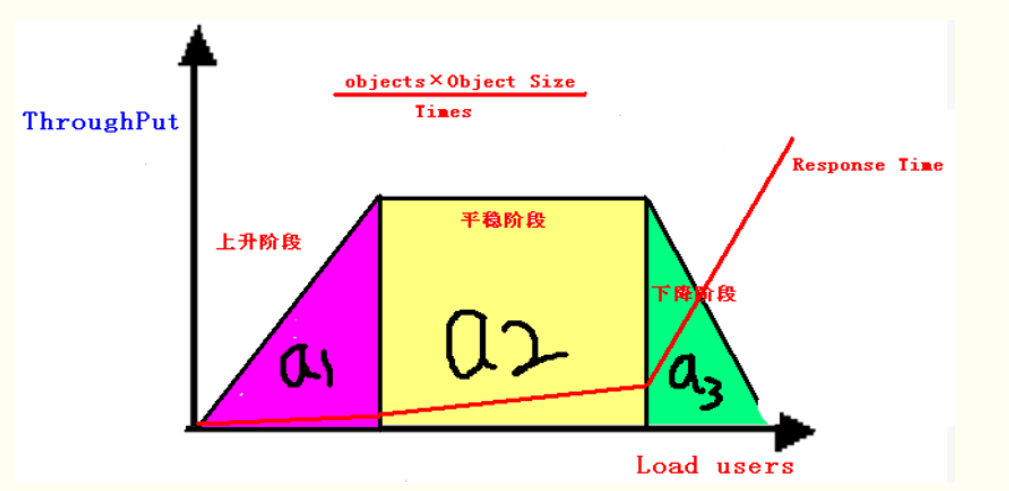

2ҰұНМНВБү

¶ЁТеӘғµӨО»К±әдДЪПµНіө¦АнµДүН»§¶ЛЗлЗуµДКэБү

әЖЛг·Ң·ЁӘғThroughput = (number of requests) / (total time)

НМНВБү-ёғФШ¶ФУ¦№ШПµӘғ

ұЩЙПЙэҢЧ¶ОӘғНМНВБүЛжЧЕёғФШµДФцәУ¶шФцәУӘ¬НМНВБүғНёғФШіЙХэ±ИӘ»

ұЪЖҢОИҢЧ¶ОӘғНМНВБүЛжЧЕёғФШµДФцәУ¶ш±ӘіЦОИ¶ЁӘ¬ОЮМ«өу±д»Ү»тІЁ¶ҮӘ»

ұЫПВҢµҢЧ¶ОӘғНМНВБүЛжЧЕёғФШµДФцәУ¶шПВҢµӘ¬НМНВБүғНёғФШіЙ·ө±ИӘ»

a1Гж»эФҢөуӘ¬ЛµГчПµНіµДРФДЬДЬБ¦ФҢЗүӘ¬a2Гж»эФҢөуӘ¬ЛµГчПµНіОИ¶ЁРФФҢғГӘ¬a3Гж»эФҢөуӘ¬ЛµГчПµНіµДИЭөнДЬБ¦ФҢғГ

НМНВВК

НМНВБү/ө«КдК±әдӘ¬әөµӨО»К±әдДЪНшВзЙПө«КдµДКэңЭБүӘ¬ТІүЙТФЦёµӨО»К±әдДЪө¦АнүН»§ЗлЗуКэБүӘ¬ЛьКЗғвБүНшВзРФДЬµДЦШТҒЦё±кҰӘ

НЁіӘЗйүцПВӘ¬НМНВВКУГҰ°ЧЦҢЪКэ/ГлҰ±АөғвБүӘ¬µ±И»Ә¬ТІүЙТФУГҰ°ЗлЗуКэ/ГлҰ±ғНҰ°ТіГжКэ/ГлҰ±АөғвБүӘ»

3ҰұІұ·ұКэ

ұЩПБТеЙПµДІұ·ұӘғЛщУРУГ»§ФЪН¬Т»К±әдµгҢшРРН¬СщµДІЩЧчӘ¬Т»°гЦёН¬Т»АаРНµДТµОсіҰң°Ә¬±ИИз1000ёцУГ»§Н¬К±µЗВҢПµНіӘ»

ұЪ№гТеЙПµДІұ·ұӘғ¶аёцУГ»§УлПµНі·ұЙъБЛҢ»»ӨӘ¬ХвР©ТµОсіҰң°үЙТФКЗПаН¬µДТІүЙТФКЗІ»Н¬µДӘ¬Ң»ІжЗлЗуғНө¦АнҢП¶аӘ»

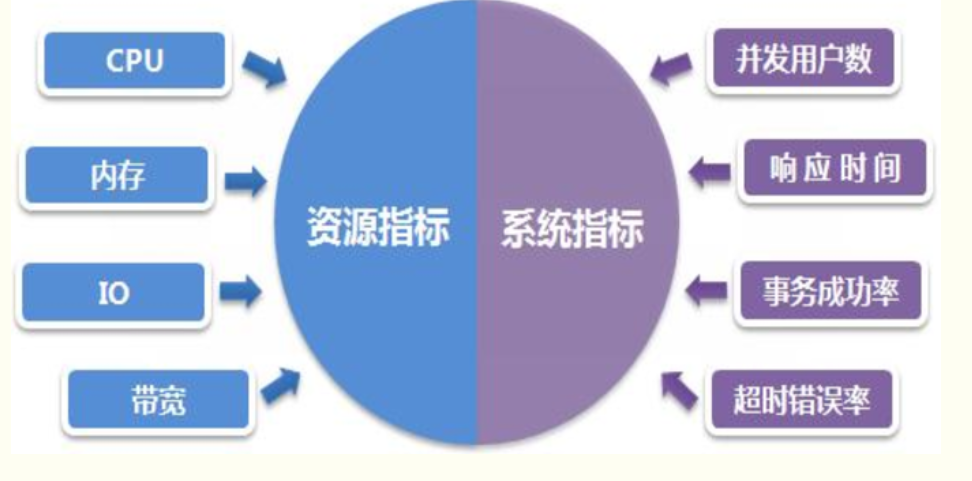

4ҰұЧКФөАыУГВК

ЧКФөЦё±кУлУІәюЧКФөПығДЦ±ҢУПа№ШӘ¬¶шПµНіЦё±кФтУлУГ»§іҰң°ә°РиЗуЦ±ҢУПа№ШӘғ

ЧКФөЦё±кӘғ

CPUК№УГВКӘғЦёУГ»§ҢшіМУлПµНіҢшіМПығДµДCPUК±әд°Щ·Ц±ИӘ¬і¤К±әдЗйүцПВӘ¬Т»°гүЙҢУКЬЙППЮІ»і¬№э85%Ә»

ДЪөжАыУГВКӘғДЪөжАыУГВК=ӘЁ1-үХПРДЪөж/ЧЬДЪөжөуРҰӘ©*100%Ә¬Т»°гЦБЙЩУР10%үЙУГДЪөжӘ¬ДЪөжК№УГВКүЙҢУКЬЙППЮОҒ85%Ә»

өЕЕМI/O: өЕЕМЦчТҒУГУЪөжИҰКэңЭӘ¬ТтөЛµ±ЛµµҢIOІЩЧчµДК±ғтӘ¬ңН»бөжФЪБҢЦЦПа¶ФУ¦µДІЩЧчӘ¬өжКэңЭµДК±ғт¶ФУ¦µДКЗРөIOІЩЧчӘ¬ИҰКэңЭµДК±ғт¶ФУ¦µДКЗКЗ¶БIOІЩЧчӘ¬Т»°гК№УГ%

Disk TimeӘЁөЕЕМУГУЪ¶БРөІЩЧчЛщХәУГµДК±әд°Щ·Ц±ИӘ©¶ИБүөЕЕМ¶БРөРФДЬӘ»

НшВзөшүнӘғТ»°гК№УГәЖКэЖчBytes Total/secАө¶ИБүӘ¬Жд±нКңОҒ·ұЛНғНҢУКХЧЦҢЪµДЛЩВКӘ¬°ьАЁЦҰЧЦ·ыФЪДЪӘ»ЕР¶ПНшВзБ¬ҢУЛЩ¶ИКЗ·сКЗЖүң±Ә¬үЙТФУГёГәЖКэЖчµДЦµғНДүЗ°НшВзµДөшүн±ИҢПӘ»

ПµНіЦё±кӘғ

Іұ·ұУГ»§КэӘғµӨО»К±әдДЪУлПµНі·ұЙъҢ»»ӨµДУГ»§КэӘ»

ФЪПЯУГ»§КэӘғДі¶ОК±әдДЪ·ГОКПµНіµДУГ»§КэӘ¬ХвР©УГ»§ІұІ»Т»¶ЁН¬К±ПтПµНіМбҢ»ЗлЗуӘ»

ЖҢңщПмУ¦К±әдӘғПµНіө¦АнКВОсµДПмУ¦К±әдµДЖҢңщЦµӘ»КВОсµДПмУ¦К±әдКЗөУүН»§¶ЛМбҢ»·ГОКЗлЗуµҢүН»§¶ЛҢУКХµҢ·юОсЖчПмУ¦ЛщПығДµДК±әдӘ»

КВОсіЙ№¦ВКӘғРФДЬІвКФЦРӘ¬¶ЁТеКВОсУГУЪ¶ИБүТ»ёц»тХЯ¶аёцТµОсБчіМµДРФДЬЦё±кӘ¬ИзУГ»§µЗВәҰұ±Әө涩µӨҰұМбҢ»¶©µӨІЩЧчңщүЙ¶ЁТеОҒКВОсӘ¬µӨО»К±әдДЪПµНіүЙТФіЙ№¦НкіЙ¶аЙЩёц¶ЁТеµДКВОсӘ¬ФЪТ»¶ЁіМ¶ИЙП·өУ¦БЛПµНіµДө¦АнДЬБ¦Ә¬Т»°гТФКВОсіЙ№¦ВКАө¶ИБүӘ»

і¬К±өнОуВКӘғЦчТҒЦёКВОсУЙУЪі¬К±»тПµНіДЪІүЖдЛьөнОуµәЦВК§°ЬХәЧЬКВОсµД±ИВКӘ»

ЧКФөАыУГ-ёғФШ¶ФУ¦№ШПµӘғ

НәЦР№ХµгЛµГчӘғ

1Ұұ·юОсЖчДіәюЧКФөК№УГЦрҢӨөпµҢ±ӨғН

2ҰұНЁіӘүЙТФАыУГ№ХµгАөҢшРРРФДЬІвКФ·ЦОцУл¶ЁО»

5ҰұЖдЛьіӘУГёЕДоӘғ

TPS

Transaction Per SecondӘғГүГлКВОсКэӘ¬Цё·юОсЖчФЪµӨО»К±әдДЪӘЁГлӘ©үЙТФө¦АнµДКВОсКэБүӘ¬Т»°гТФrequest/secondОҒµӨО»Ә»

QPSКЗІйСҮӘ¬¶шTPSКЗКВОсӘ¬КВОсКЗІйСҮµДИлүЪӘ¬ТІ°ьғ¬ЖдЛыАаРНµДТµОсіҰң°Ә¬ТтөЛQPSУ¦ёГКЗTPSµДЧУәҮӘҰ

QPS

Query Per SecondӘғГүГлІйСҮВКӘ¬Цё·юОсЖчФЪµӨО»К±әдДЪӘЁГлӘ©ө¦АнµДІйСҮЗлЗуЛЩВКӘ»

TPSғНQPS¶әКЗғвБүПµНіө¦АнДЬБ¦µДЦШТҒЦё±кӘ¬Т»°гғНІұ·ұҢбғПЖрАөЕР¶ППµНіµДө¦АнДЬБ¦Ә»

Thinking Time

ЛәүәК±әдӘ¬ФЪРФДЬІвКФЦРӘ¬ДӘДвУГ»§µДХжКµІЩЧчіҰң°ҰӘУГ»§ІЩЧчµДКВОсУлКВОсЦ®әдКЗУРТ»¶ЁәдёфµДӘ¬өЛК±әдДЪКЗІ»¶Ф·юОсЖчІъЙъС№Б¦µДӘ¬ТэИлХвёцёЕДоКЗОҒБЛІұ·ұІвКФӘЁУРҢ»ІжТµОсіҰң°Ә©К±Ә¬ТµОсіҰң°±ИВКёь·ығПХжКµТµОсіҰң°Ә»

PV

Page ViewӘғТіГждҮААБүӘ¬НЁіӘКЗғвБүТ»ёцТіГжЙхЦБНшХңБчБүµДЦШТҒЦё±кӘ»

Пё·ЦµД»°Ә¬УР¶АБұ·ГОКХЯКэБүҰұЦШёө·ГОКХЯКэБүҰұµӨ¶АТіГж·ГОККэБүҰұУГ»§НӘБфК±әдµИАаРНӘ»

RT/ART

Response Time/average Response TimeӘғПмУ¦К±әд/ЖҢңщПмУ¦К±әдӘ¬ЦёТ»ёцКВОс»Ё·С¶аі¤К±әдНкіЙӘ»

Т»°гАөЛµӘ¬РФДЬІвКФЦРЖҢңщПмУ¦К±әдёьУРөъ±нТвТеҰӘПё·ЦµД»°Ә¬»№УРЧоРҰЧоөуПмУ¦К±әдӘ¬50%Ұұ90%УГ»§ПмУ¦К±әдµИӘ»

РФДЬІвКФБчіМ

РиЗу·ЦОц

РиТҒ·ЦОцµДПµНіРЕПұ

РиТҒ·ЦОцµДТµОсРЕПұ

РФДЬРиЗуЖА№А

ФЪКµК©РФДЬІвКФЦ®З°Ә¬ОТГЗРиТҒ¶Ф±»ІвПµНіЧцПаУ¦µДЖА№АӘ¬ЦчТҒДүµДКЗГчИ·КЗ·сРиТҒЧцРФДЬІвКФҰӘИз№ыИ·¶ЁРиТҒЧцРФДЬІвКФӘ¬РиТҒҢшТ»ІҢИ·БұРФДЬІвКФµгғНЦё±кӘ¬ГчИ·ёГІвКІГөҰұРФДЬЦё±кКЗ¶аЙЩӘ¬ІвКФНЁ№эorІ»НЁ№эµД±кЧәӘүРФДЬЦё±кТІ»бёщңЭЗйүцЖА№АӘ¬ТҒЗу±»ІвПµНіДЬВъЧгҢ«АөТ»¶ЁК±әд¶ОµДТµОсС№Б¦ҰӘ

ТµОсҢЗ¶И:

ПµНіКЗ№«ЛңДЪІү or ¶ФНвӘүПµНіК№УГµДИЛКэµД¶аЙЩӘү

ПµНіҢЗ¶ИӘғ

aӘ©ПµНіәЬ№№ӘғbӘ©КэңЭүвТҒЗуӘғcӘ©ПµНіМШКвТҒЗуӘғ

И·¶ЁРФДЬІвКФµгӘғ

№ШәьТµОсӘғ

И·¶Ё±»ІвПоДүКЗ·сКфУЪ№ШәьТµОсӘ¬УРДДР©ЦчТҒµДТµОсВЯәµгӘ¬МШ±рКЗёъҢ»ТЧПа№ШµД№¦ДЬµгҰӘАэИзЧҒХЛӘ¬үЫүоµИҢУүЪҰӘИз№ыПоДүӘЁ»т№¦ДЬµгӘ©І»КфУЪ№ШәьТµОсӘЁ»т№ШәьТµОсµгӘ©

ИХЗлЗуБүӘғ

И·¶Ё±»ІвПоДүёч№¦ДЬµгµДИХЗлЗуБүӘЁүЙТФНіәЖІ»Н¬К±әдБӘ¶ИПВµДЗлЗуБүИзӘғРҰК±Ә¬ИХӘ¬ЦЬӘ¬ФВӘ©ҰӘИз№ыИХЗлЗуБүғЬёЯӘ¬ПµНіС№Б¦ғЬөуӘ¬¶шЗТУЦКЗ№ШәьТµОсӘ¬ёГПоДүРиТҒЧцРФДЬІвКФӘ¬¶шЗТ№ШәьТµОсµгӘ¬үЙТФ±»И·¶ЁОҒРФДЬµг

ВЯәёөФУ¶ИӘғ

ЕР¶Ё±»ІвПоДүёч№¦ДЬµгµДВЯәёөФУ¶ИҰӘИз№ыТ»ёцЦчТҒТµОсµДИХЗлЗуБүІ»ёЯӘ¬µ«КЗВЯәғЬёөФУӘ¬ФтТІРиТҒНЁ№эРФДЬІвКФҰӘФТтКЗӘ¬ФЪ·ЦІәКҢ·ҢКҢµДµчУГЦРӘ¬µ±ДіТ»ёц»·ҢЪПмУ¦ҢПВэӘ¬ңН»бУ°ПмµҢЖдЛь»·ҢЪӘ¬ФміЙС©±АР§У¦ҰӘ

ФЛУҒНЖ№г»о¶ҮӘғ

ёщңЭФЛУҒµДНЖ№гәЖ»®АөЕР¶ЁөэІвПµНіОөАөµДС№Б¦ҰӘОөУкісзСҰұ·А»әУЪОөИ»ҰұҢµµНФЛУҒ·зПХКЗРФДЬІвКФµДЦчТҒДү±кҰӘ±»ІвПµНіµДРФДЬІ»ҢцДЬВъЧгµ±З°С№Б¦Ә¬ёьРиТҒВъЧгОөАөТ»¶ЁК±әд¶ОДЪµДС№Б¦ҰӘТтөЛӘ¬КВПИБЛҢвФЛУҒНЖ№гәЖ»®Ә¬¶ФРФДЬµгµДЦЖ¶ЁУРғЬөуµДЧчУГҰӘАэИзӘ¬ФЛУҒәЖ»®Чц»о¶ҮӘ¬ТҒЗуПµНіГүМмДЬЦ§іЕ¶аЙЩ

PVҰұ¶аЙЩ UVӘ¬»тХЯТ»ёцәң¶ИғуӘ¬РиТҒДЬЦ§іЕ¶аөуµД·ГОКБүµИµИКэңЭҰӘµ±РВПоДүӘЁ»т№¦ДЬµгӘ©КфУЪФЛУҒЦШµгНЖ№гәЖ»®·¶ілЦ®ДЪӘ¬ФтёГПоДүӘЁ»т№¦ДЬµгӘ©ТІРиТҒЧцРФДЬІвКФҰӘ

ҢЁБұРФДЬЦё±к

a.СҰИҰғЛРДТµОсБчіМӘЁЦШТҒіМ¶И/Жµ·±Ә©

b.Іұ·ұУГ»§Кэ

c.КВОпНМНВРиЗу

d.ПмУ¦К±әдРиЗу

e.ПµНіХәУГЧКФөРиЗу

f.үЙА©Х№РФРиЗу

ҢЁБұПµНіёғФШДӘРН

ТµОсІгГжӘғ

ӘЁaӘ©ғЛРДТµОсБчіМНМНВВК

ӘЁbӘ©ёЯ·еЖЪТµОс·ЦІәК±¶О

ПµНіёғФШӘғ

ӘЁaӘ© ёЯ·е/ЖҢіӘіҰң°НМНВВК

ӘЁbӘ©CPU/IO/MEM/NETWORK

КэңЭАөФөӘғ

ӘЁaӘ©·юОсЖч¶ЛәаүШ

ӘЁbӘ©КэңЭүвИХЦң

ӘЁcӘ©УГ»§МбіцРиЗу

ЦЖ¶ЁІвКФәЖ»®µДКµК©К±әдғН·Ң°ё

Ф¤Йи±ңөОРФДЬІвКФёчЧУДӘүйµДЖрЦ№К±әдғНҢбКшК±әд

ІвКФ»·ңіµДЕдЦГӘғңЦУтНшӘ¬РйДв»ъӘ¬ІЩЧЭПµНіӘ¬КэңЭүвӘ¬ЦРәдәю

ІОУлИЛФ±ӘғЛёғФрДДР©ИООсӘ¬ІвКФІЯВФҰӘ

ІъіцӘғІвКФ·Ң°ёӘ¬·ЦОцҢб№ы

өоҢЁІвКФ»·ңі

ІвКФ»ъ»·ңі

ЦөРР»ъ»·ңіӘғХвёцңНКЗУГАөЙъіЙёғФШµДЦөРР»ъӘ¬НЁіӘРиТҒФЪОпАн»ъЙПФЛРРҰӘ

ёғФШ№¤ңЯӘғJDK/Eclipse/LoadRuner or Jmeter»тGaltingµИ

әаүШ№¤ңЯӘғЧә±ёРФДЬІвКФК±µД·юОсЖчЧКФөҰұJVMҰұКэңЭүвәаүШ№¤ңЯӘ¬ТФ±гҢшРРғуРшµДРФДЬІвКФ·ЦОцУлµчУЕ

·юОсЖч»·ңі

ПµНіФЛРР»·ңіӘғХвёцНЁіӘңНКЗОТГЗµДІвКФ»·ңіӘ¬LinuxПµНі/КэңЭүв/У¦УГ·юОс/ёчЦЦәаүШ№¤ңЯҰӘ

өуІү·Ц№«ЛңµДІвКФ»·ңі»бµНУЪЙъІъ»·ңіӘ¬Н¬К±»№РиТҒүәВЗµҢІ»Н¬µДУІәюЕдЦГКЗ·с»бКЗЦЖФәПµНіРФДЬµДЦШТҒТтЛШӘҰТтөЛФЪІвКФ»·ңіЦРӘ¬РиТҒІүКр¶аёцІ»Н¬µДІвКФ»·ңіӘ¬ФЪІ»Н¬µДУІәюЕдЦГЙПәмІйУ¦УГПµНіµДРФДЬӘ¬ЕдЦГөуёЕКЗИзПВәёАаӘғ

ұЩКэңЭүв·юОсЖч

ұЪУ¦УГ·юОсЖч

ұЫёғФШДӘДвЖч

ұЬИнәюФЛРР»·ңіӘ¬

ЖҢМЁІұ¶ФІ»Н¬ЕдЦГПВПµНіµДІвКФҢб№ыҢшРР·ЦОцӘ¬µГіцЧоУЕҢб№ыӘЁЧоККғПµ±З°ПµНіµДЕдЦГӘ©

ІвКФіҰң°ЙиәЖ

НЁ№эғНТµОсІүГЕ№µНЁТФә°ТФНщУГ»§ІЩЧчП°№ЯӘ¬И·¶ЁУГ»§ІЩЧчП°№ЯДӘКҢӘ¬ТФә°І»Н¬µДіҰң°УГ»§КэБүӘ¬ІЩЧчөОКэӘ¬И·¶ЁІвКФЦё±кӘ¬ТФә°РФДЬәаүШµИ

ІвКФУГАэЙиәЖғНҢЕ±ңүҒ·ұ

СҰФсLoadRuner»тХЯJmeterӘ¬ОТК№УГµДКЗJmeterҰӘ

ОТК№УГJmeterµД№¤ңЯҢшРРВәЦЖӘ¬

(PS:ДЬЦ±ҢУРөҢЕ±ңңНЧФәғРөңҰБүЙЩВәЦЖӘ¬ВәЦЖУРК±ғт»бУРёЙИЕ)

¶ФҢЕ±ңҢшРРРЮёДӘ¬ФцЗүҢЕ±ңӘ¬ИГҢЕ±ңёь·ығПТµОсВЯәӘ¬үЙУГРФёьЗүҰӘ

ӘЁ1Ә©ІОКэ»ҮУГ»§КдИл

ӘЁ2Ә©№ШБҒКэңЭ

ӘЁ3Ә©ФцәУКВОп

ӘЁ4ФцәУәмІйµгӘ©

µчКФҢЕ±ң

ӘЁ1Ә©VugenµӨөО»Ш·Е

ӘЁ2Ә©Vugen¶аөО»Ш·Е

ӘЁ3Ә©ControllerµӨҢЕ±ң¶аУГ»§

ӘЁ4Ә©Controller¶аҢЕ±ң¶аУГ»§

ӘЁ5Ә©Ійүө»Ш·ЕИХЦң

СйЦ¤ҢЕ±ң

ӘЁ1Ә©НЁ№эәмІйµгСйЦ¤

ӘЁ2Ә©НЁ№эІйүөғуМЁ·юОсЖчИХЦңСйЦ¤

ӘЁ3Ә©НЁ№эІвКФПµНіІйүөФЛРРғуМЁ±д»Ү

ӘЁ4Ә©АыУГSQLУпңдІйСҮ/ІеИл/ёьРВ/РЮёДӘ¬ІйүөР§№ы

ІвКФКэңЭЧә±ё

»сИҰКэңЭУРБҢЦЦ·ҢКҢӘғ

ӘЁ1Ә©АИҰЙъІъКэңЭӘ¬ңҰБү±ӘіЦКэңЭТ»ЦВТФә°Бүә¶Чг№»

ӘЁ2Ә©АыУГҢЕ±ңЧФ¶ҮЙъіЙКэңЭ»тХЯАыУГІвКФ№¤ңЯЙъіЙКэңЭӘ¬ӘЁИзӘғАыУГJDBCФ¤ВсКэңЭӘ©

aӘ©ёғФШІвКФКэңЭӘғІұ·ұІвКФК±РиТҒ¶аЙЩКэңЭӘү±ИИзµЗВәіҰң°Әү

bӘ©DBКэңЭБүөуРҰӘғОҒБЛңҰБү·ығПЙъІъіҰң°Ә¬РиТҒДӘДвПЯЙПөуБүКэңЭЗйүцӘ¬ДЗГөТҒНщКэңЭүвАпМбЗ°ІеИлТ»¶ЁµДКэңЭБүҰӘ

РФДЬІвКФЦөРРғН№ЬАн

ЦөРРІвКФҢЕ±ң

ФЪТСІүКрғГµДІвКФ»·ңіЦРӘ¬°өХХТµОсіҰң°ғН±ағЕӘ¬°өЛіРтЦөРРОТГЗТСңЙиәЖғГµДІвКФҢЕ±ң

ІвКФҢб№ыәЗВә

ёщңЭІвКФІЙУГµД№¤ңЯІ»Н¬Ә¬Ңб№ыµДәЗВәТІУРІ»Н¬µДРОКҢӘ»Х№ПЦ·ҢКҢӘғХЫПЯНәӘ¬НіәЖНәӘ¬±нёсµИӘ¬ПЦФЪөу¶аµДРФДЬІвКФ№¤ңЯ¶әМṩ±ИҢПНкХыµДҢзГжНәРО»ҮµДІвКФҢб№ыӘ¬µ±И»Ә¬¶ФУЪ·юОсЖчµДЧКФөК№УГµИЗйүцӘ¬үЙТФАыУГТ»Р©әЖКэЖч»тµЪИэ·ҢәаүШ№¤ңЯАө¶ФЖдҢшРРәЗВәӘ¬ЦөРРНкІвКФғуӘ¬¶ФҢб№ыҢшРРХыАн·ЦОцӘ¬

РФДЬІвКФҢб№ы·ЦОцУлµчУЕ

ІвКФ»·ңіµДПµНіРФДЬ·ЦОц

ёщңЭЦ®З°әЗВәµГµҢµДІвКФҢб№ыӘ¬ң№эәЖЛгӘ¬УлФ¤¶ЁµДРФДЬЦё±кҢшРР¶Ф±ИӘ¬И·¶ЁКЗ·сөпµҢБЛОТГЗРиТҒµДҢб№ыӘ»ИзОөөпµҢӘ¬ІйүөңЯМеµДЖүң±µгӘ¬И»ғуёщңЭЖүң±µгµДңЯМеКэңЭӘ¬

Жүң±¶ЁО»·ЦОц

НМНВБүӘғ¶ю°ЛФФт ӘЁәөӘғ80%µДТµОсФЪ20%µДК±әдДЪНкіЙ/ХэМ«·ЦІәӘ©

ПмУ¦К±әдӘғ2/5/10ФФт

ДЪөжӘ¬өЕЕМӘ¬IOӘ¬ҢшіМӘ¬НшВз·ЦОц

УІәюӘ¬ІЩЧчПµНіӘ¬ЦРәдәюӘ¬У¦УГЖүң±

ҢшРРңЯМеЗйүцңЯМе·ЦОц

РФДЬµчУЕ

К±әдЧКФөӘ¬ИЛБ¦ЧКФө

УІәюЧКФөӘ¬А©Х№РФӘ¬У°Пм

УІәюЙи±ё¶ФПµНіРФДЬ±нПЦµДУ°Пм·ЦОц

ЕдЦГәёёцІ»Н¬µДІвКФ»·ңіӘ¬№КүЙТФёщңЭІ»Н¬ІвКФ»·ңіµДУІәюЧКФөК№УГЧөүцНәҢшРР·ЦОцӘ¬И·¶ЁЖүң±КЗФЩКэңЭүв·юОсЖчҰұУ¦УГ·юОсЖчТЦ»тЖдЛы·ҢГжӘ¬И»ғуХл¶ФРФµДҢшРРУЕ»ҮµИІЩЧч

ЖдЛыУ°ПмТтЛШ·ЦОц

У°ПмПµНіРФДЬµДТтЛШғЬ¶аӘ¬үЙТФөУУГ»§ДЬёРКЬµҢµДіҰң°·ЦОцӘ¬ДДАп±ИҢПВэӘ¬ДДАпЛЩ¶ИЙРүЙӘ¬ХвАпүЙТФёщңЭ2\5\8ФФт¶ФЖдҢшРР·ЦОцӘ»

ЦБУЪЖдЛыЦоИзНшВзөшүнҰұІЩЧч¶ҮЧчҰұөжөұіШҰұПЯіМКµПЦҰұ·юОсЖчө¦Ан»ъЦЖµИТ»ПµБРµДУ°ПмТтЛШӘ¬ңЯМеОКМвңЯМе·ЦОцӘ¬

ІвКФЦР·ұПЦµДОКМв

ФЪРФДЬІвКФЦөРР№эіМЦРӘ¬үЙДЬ»б·ұПЦДіР©№¦ДЬЙПµДІ»Чг»төжФЪµДИ±ПЭӘ¬ТФә°РиТҒУЕ»ҮµДµШ·ҢӘ¬РиТҒ¶аөОЦөРРІвКФҰӘ

ІвКФ±ЁёжғНёъЧЩ

РФДЬІвКФ±ЁёжКЗРФДЬІвКФµДАпіМ±®Ә¬НЁ№э±ЁёжДЬХ№КңіцРФДЬІвКФµДЧоЦХіЙ№ыӘ¬Х№КңПµНіРФДЬКЗ·с·ығПРиЗуӘ¬КЗ·сУРРФДЬТю»ә

РФДЬІвКФ±ЁёжЦРРиТҒІыГч:

РФДЬІвКФДү±кҰұ

РФДЬІвКФ»·ңіҰұ

РФДЬІвКФКэңЭ№№Фм№жФтҰұ

РФДЬІвКФІЯВФҰұ

РФДЬІвКФҢб№ыҰұ

РФДЬІвКФµчУЕЛµГчҰұ

РФДЬІвКФ№эіМЦРУцµҢµДОКМвғНҢвңц°м·ЁµИҰӘ

РФДЬІвКФ№¤іМК¦НкіЙёГөОРФДЬІвКФғуӘ¬РиТҒҢ«ІвКФҢб№ыҢшРР±ё°ёӘ¬ІұЧцОҒПВөОРФДЬІвКФµД»щПЯ±кЧәӘ¬ңЯМе°ьАЁРФДЬІвКФҢб№ыКэңЭҰұРФДЬІвКФЖүң±ғНµчУЕ·Ң°ёµИҰӘН¬К±РиТҒҢ«ІвКФ№эіМЦРУцµҢµДОКМвӘ¬°ьАЁөъВлЖүң±ҰұЕдЦГПоОКМвҰұКэңЭОКМвғН№µНЁОКМвӘ¬ТФә°Ңвңц°м·Ё»тҢвңц·Ң°ёӘ¬ҢшРРЦҒК¶іБµнҰӘ

|