| Logstash��һ����ȫ��Դ�Ĺ��ߣ������Զ������־�����ռ���������������洢���Ժ�ʹ�ã��磬��������������ʹ������˵��������logstash����һ��web���棬������չʾ������־��

kibana Ҳ��һ����Դ����ѵĹ��ߣ��������������ܡ�������������Ҫ������־���ṩ�Ѻõ�web���档������Ϊ

Logstash �� ElasticSearch �ṩ����־������ Web ����

˵��������ǿ��� kibana �� logstash������Ϊ������Щʲô�أ�������kibana�Ľ���

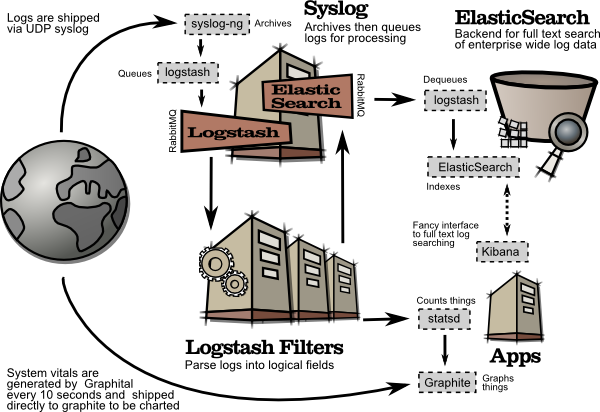

������������Ĺ������̾��� logstash agent ��ز�������־�������˺����־���ݷ���redis(�����redisֻ�������в����洢)��logstash

index����־�ռ���һ��

ȫ����������ElasticSearch ������ElasticSearch�����Զ������� ͨ��Kibana

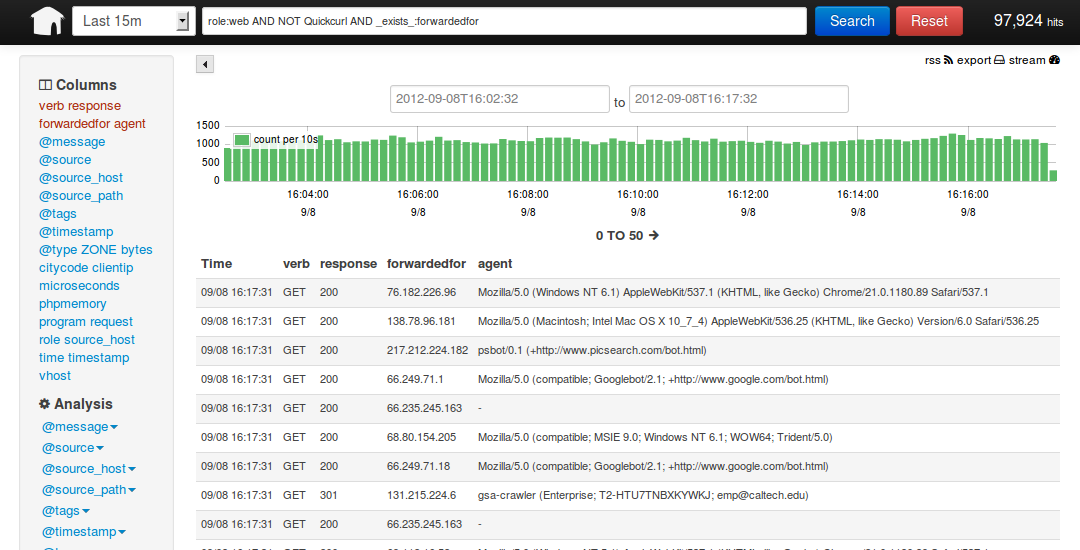

����� �Զ�����������ҳ��չʾ����ͼ�� Kibana�����ϵ�����ͼ

���� ������һ�����İ�������������ɣ��ȿ�������Ҫ��װʲô������

ruby ����Kibana ���룬

rubygems ��װruby��չ����

bundler ����������yum

JDK ����java�������

redis ����������־����

logstash �ռ���������־

ElasticSearch ȫ����������(logstash������һ��)

kibana ҳ��չʾ

��������̨������

192.168.233.128 logstash index��ElasticSearch��kibana��JDK

192.168.233.129 logstash agent��JDK

192.168.233.130 redis

���ȵ� logstash index���������棬logstash��Ϊ index��aget ��agent�����ء�������־��index�����ռ���־������־����ElasticSearch

������

���� logstash ���ռ���ʽ��Ϊ standalone �� centralized��

standalone �����й��ܶ���һ�����������棬�Է����գ�centralized ���Ǽ����ռ���һ̨��������������shipper(�����������logstash

agent)����־��

��ʵ logstash�������� ʲô shipper �� collector ��ֻ�������������ļ���ͬ���ѣ�������ΰ��ռ��еķ�ʽ������

�� logstash index�ϰ�װ��������������

[192.168.233.128 root@nodec:~]

# cd /soft/

[192.168.233.128 root@nodec:/soft]

# wget http:

//down1.chinaunix.net/distfiles/jdk-6u13-dlj-linux-i586.bin

��oracle����ʵ����̫���ˣ�

��CU���ػ��һЩ�������Ҫ���°汾���������

http://www.oracle.com/

technetwork/java/javase/downloads/jdk7-downloads-1880260.html

[192.168.233.128 root@nodec:/soft]

# sh jdk-6u13-dlj-linux-i586.bin

����yes �㿪ʼ��װ��

��װ��ɺ�����һ�� JAVA_HOME

[192.168.233.128 root@nodec:/soft/Kibana-0.2.0]

# vim /etc/profile

export JAVA_HOME=/usr/java

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=

.:$JAVA_HOME/lib/tools.jar:$JAVA_HOME/lib/dt.jar:$CLASSPATH

��װruby �ͱȽϼ���(Kibana��Ҫruby 1.8.7���ϰ汾)

[192.168.233.128 root@nodec:/soft]

# yum install ruby rubygems

..... ��װ����ʡ��

��װ��ɺ��� rubygems ����װbundler

[192.168.233.128 root@nodec:/soft]

# /usr/bin/gem install bundler

.....

ok ���������Ļ������Ѿ����ˣ�������ǰ�װkibana �� logstash

��ʵlogstash ����һ��java�ű�������Ҫ��װ... ���ؼ���

[192.168.233.128 root@nodec:/soft]

# wget http:

//logstash.objects.dreamhost.com/release/logstash-1.1.0-monolithic.jar

���ڿ��� ����ű�Ӧ����ôȥִ��

[192.168.233.128 root@nodec:/soft]

# java -jar /soft/logstash-1.1.0-monolithic.jar -h

No such command "-h"

Available commands:

-v

-V

--version

agent

web

test

��Ȼû�� -h ������

�����г������õIJ���������logstash�IJ����ɲ�ֹ��Щ��

java -jar /soft/logstash-1.1.0-monolithic.jar agent --help

��Щ����agentģʽ�µ��������

-f, --config CONFIGFILE

Load the logstash config from a specific file,

directory, or a wildcard. If given a directory or wildcard,

config files will be read in order lexigraphically.

-e CONFIGSTRING

Use the given string as the configuration data.

Same syntax as the config file.

If not input is specified, 'stdin { type => stdin }'

is default. If no output is specified, 'stdout

{ debug => true }}' is default.

-w, --filterworks COUNT

Run COUNT filter workers (default: 1)

--watchdog-timeout TIMEOUT

Set watchdog timeout value.

-l, --log FILE

Log to a given path. Default is to log to stdout

-v

Increase verbosity.

There are multiple levels of verbosity available with

'-vv' currently being the highest

--pluginpath PLUGIN_PATH

A colon-delimted path to find other logstash plugins in

java -jar /soft/logstash-1.1.0-monolithic.jar web --help

���������web����IJ���

--log FILE

Log to a given path. Default is stdout.

--address ADDRESS

Address on which to start webserver. Default is 0.0.0.0.

--port PORT

Port on which to start webserver. Default is 9292.

-B, --elasticsearch-bind-host ADDRESS

Address on which to bind elastic search node.

-b, --backend URL

The backend URL to use.

Default is elasticsearch:///

(assumes multicast discovery).

You can specify elasticsearch://[host][:port]/[clustername] |

����������Щ�����ִ�������Ļ��ͱ�ʾ logstash����ʹ���ˣ���Ҫ������������Ҫһ�������ļ�

[192.168.233.128 root@nodec:/soft]

# vim redis.conf

input {

redis {

host => '192.168.233.130'

data_type => 'list'

port => "6379"

key => 'logstash:redis'

type => 'redis-input'

}

}

output {

elasticsearch {

embedded => true

}

} |

����һ�� logstash�������ļ��� input filter output �ȼ��������IJ�����ɣ�����˼��

input ���������ռ����ݣ�output����������ģ�filter����һ�����˹�����˼��ʲô����

�ᱻ�ռ���

����������� logstash ȥ192.168.233.130 ���redis��������ȥ�ռ���־ redis�˿�Ϊ6379��key��

logstash:redis ����Ϊ redis-input ����ע��:�⼸��ֵ�����logstash

agent��

output ����Ӧ�����ռ���ɺ������ elasticsearch ,embedded => true

����˼��ʹ��logstash ��Ƕ�� elasticsearch������ж�����elasticsearch����������Ҫ��

������Ϊ

host => 'elasticsearch��ip' port => �˿�

���ˣ�����������ļ�������logstash��ʼ������

[192.168.233.128 root@nodec:/soft]

# java -jar /soft/logstash-1.1.0-monolithic.jar

agent -f /soft/redis.conf -- web

--backend elasticsearch:///?local &

[1] 5205

...����Ҫ�ȴ�Լ5����... Ϊʲô��ȥ�ʿ����߰�

[192.168.233.128 root@nodec:/soft]

# I, [2013-03-19T03:23:10.749000 #5205] INFO -- :

Using beta plugin 'redis'. For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status

{"timestamp":"2013-03-19T03:23:10.732000 -0700",

"message":"Using beta plugin 'redis'.

For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status ","level":"info"}

file:/soft/logstash-1.1.0-monolithic

.jar!/gems/rack-1.3.4/lib/rack/backports/uri/common_192.rb:53

warning: already initialized constant WFKV_

Mizuno 0.5.0 (Jetty 8.0.y.z-SNAPSHOT) listening on 0.0.0.0:9292

����һ�� ��������� agent ����ģʽ -f ָ�������ļ�

--web ��ʵ�Ǹ��ָ���������������һ�����

����IJ������ǿ���һ��webҳ��Ĭ�϶˿���9292,

����������������������������

java -jar /soft/logstash-1.1.0-monolithic.jar

agent -f /soft/redis.conf &

java -jar /soft/logstash-1.1.0-monolithic.jar web

--backend elasticsearch:///?local &

(��ʵ�����kibana����web����Ļ���һ����ȫ����ʡ����) |

���ˣ�����9292 �˿������ʹ��� �����ɹ��ˣ����һ��

[192.168.233.128 root@nodec:/soft]

# lsof -i:9292

COMMAND PID USER FD

TYPE DEVICE SIZE NODE NAME

java 5205 root 465u IPv4 130805

TCP *:armtechdaemon (LISTEN)

��ʵlogstash��������һ���˿�9200��

��Ϊ��������Ƕ�� elasticsearch�����9200�� elasticsearch�ڼ���

[192.168.233.128 root@nodec:/soft]

# lsof -i:9200

COMMAND PID USER FD TYPE DEVICE SIZE NODE NAME

java 5205 root 160u IPv4 130682 TCP *:wap-wsp (LISTEN) |

��ʵlogstash��������һ���˿�9200����Ϊ��������Ƕ�� elasticsearch�����9200��

elasticsearch�ڼ���

[192.168.233.128 root@nodec:/soft]

# lsof -i:9200

COMMAND PID USER FD TYPE DEVICE SIZE NODE NAME

java 5205 root 160u IPv4 130682 TCP *:wap-wsp (LISTEN)

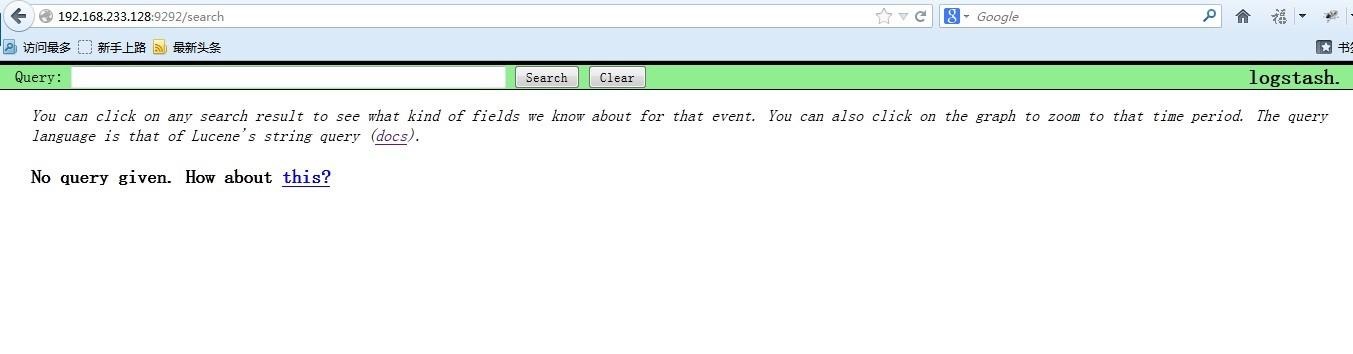

���ڿ���ͨ�����������һ�� http://192.168.233.128:9292 ����logstash�ǵ�ҳ���Ǹ�ʲô����

���ڻ�����������Ϊ���ڻ�û�����ݣ���ʵ���ʱ�� http://192.168.233.128:9200

Ҳ�ǿ��Է��ʵģ�

�ܶ���Լ�д����������elasticsearch ��ʵ�������Լ�����Ҫ������Ͳ���˵��

192.168.233.128 ��̨logstash index�IJ�����ʱ��һ���䣬���濪ʼ����logstash��agent

��¼�� ������ 192.168.233.129 ��װ������������logstash

[192.168.233.129 root@noded:~]

# cd /soft/

[192.168.233.129 root@noded:/soft]

# wget http://down1.chinaunix.net/distfiles/jdk-6u13-dlj-linux-i586.bin

[192.168.233.129 root@noded:/soft]

# sh jdk-6u13-dlj-linux-i586.bin

���� JAVA_HOME

[192.168.233.129 root@noded:/soft]

# vim /etc/profile

export JAVA_HOME=/usr/java

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=.:$JAVA_HOME/lib/tools.jar:

$JAVA_HOME/lib/dt.jar:$CLASSPATH

[192.168.233.129 root@noded:/soft]

# yum install ruby

192.168.233.129 root@noded:/soft]

# wget

http://logstash.objects.dreamhost.com/release/logstash-1.1.0-monolithic.jar

[192.168.233.129 root@noded:/soft]

# vim redis.conf

input {

file {

type => "producer"

path => "/soft/apache.log"

}

file {

type => "php-log"

path => "/soft/php.log"

}

}

filter {

grep {

match => [ "@message", "mysql|GET|error" ]

}

}

output {

redis {

host => '192.168.233.130'

data_type => 'list'

key => 'logstash:redis'

}

} |

���˵һ����������ļ� input ���file����Ҫ���ӵ��ļ��� �����Ҽ����������ļ�������������ļ����ӵ����ݾͻ�ͨ�������output���÷���

redis������

filter ���grep ��˼���� grep... ������ξ��� ��־��������ֻҪ��ƥ�� mysql��GET��error�����ݾͻᱻ���˳��������͵�

logstash index

���Ͼ���һ���Ƚϼ������ļ��ˣ�������������

[192.168.233.129 root@noded:/soft]

# java -jar /soft/logstash-1.1.0-monolithic.jar agent -f /soft/redis.conf &

I, [2013-03-19T19:45:35.762000 #2721] INFO -- :

Using beta plugin 'file'.

For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status

{"timestamp":"2013-03-19T19:45:35.752000 -0700","

message":"Using beta plugin 'file'.

For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status ","level":"info"}

I, [2013-03-19T19:45:35.778000 #2721] INFO -- :

Using beta plugin 'file'.

For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status

{"timestamp":"2013-03-19T19:45:35.778000 -0700",

"message":"Using beta plugin 'file'.

For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status ","level":"info"}

I, [2013-03-19T19:45:35.804000 #2721] INFO -- :

Using beta plugin 'grep'.

For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status

{"timestamp":"2013-03-19T19:45:35.803000 -0700"

,"message":"Using beta plugin 'grep'.

For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status ","level":"info"}

I, [2013-03-19T19:45:35.854000 #2721] INFO -- :

Using beta plugin 'redis'.

For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status

{"timestamp":"2013-03-19T19:45:35.853000 -0700","

message":"Using beta plugin 'redis'.

For more information about plugin statuses,

see http://logstash.net/docs/1.1.0/plugin-status ","level":"info"} |

ֻҪû�� warning �� error����������������

����֮ǰ��ȷ�� 192.168.233.130�� redis�������Ѿ���������Ȼ�ᱨ��

�����¼�� 192.168.233.130 �Ͽ��� redis�����״̬

[192.168.233.130 root@nodea:/data/redis/etc]

# lsof -i:6379

COMMAND PID USER FD TYPE DEVICE SIZE NODE NAME

redis-ser 2732 root 4u IPv4 7946

TCP *:6379 (LISTEN)

redis-ser 2732 root 5u IPv4 7963

TCP localhost.localdomain:6379->

localhost.localdomain:19214 (ESTABLISHED)

java 2733 root 9u IPv4 7959

TCP localhost.localdomain:19214->

localhost.localdomain:6379 (ESTABLISHED)

״̬�������˿ڴ��ڼ���״̬�����õ������ ���ã�

[192.168.233.130 root@nodea:/data/redis/etc]

# vim redis.conf

#this is the config file for redis

pidfile /var/run/redis.pid

port 6379

timeout 0

loglevel verbose

logfile /data/redis/log/redis.log

dbfilename dump.rdb

dir /data/redis/db/

vm-swap-file /tmp/redis.swap

activerehashing yes

������������

[192.168.233.130 root@nodea:/data/redis/etc]

# redis-server /data/redis/etc/redis.conf & |

���ذ�װ�ͱȽϼ���

[192.168.233.130 root@nodea:/soft]

# wget http://redis.googlecode.com/files/redis-2.4.14.tar.gz

[192.168.233.130 root@nodea:/data/redis/etc]

# make �Cj24

[192.168.233.130 root@nodea:/data/redis/etc]

# make install |

�����ļ�����Ǽ���·��Ҫ��ǰ����

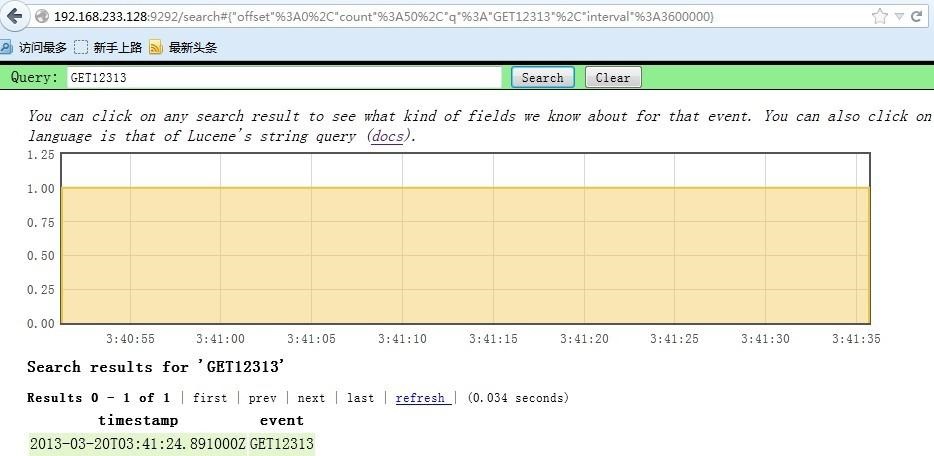

������ǻص� logstash agent �������һ��

[192.168.233.129 root@noded:/soft]

# echo GET12313 >> apache.log

[192.168.233.129 root@noded:/soft]

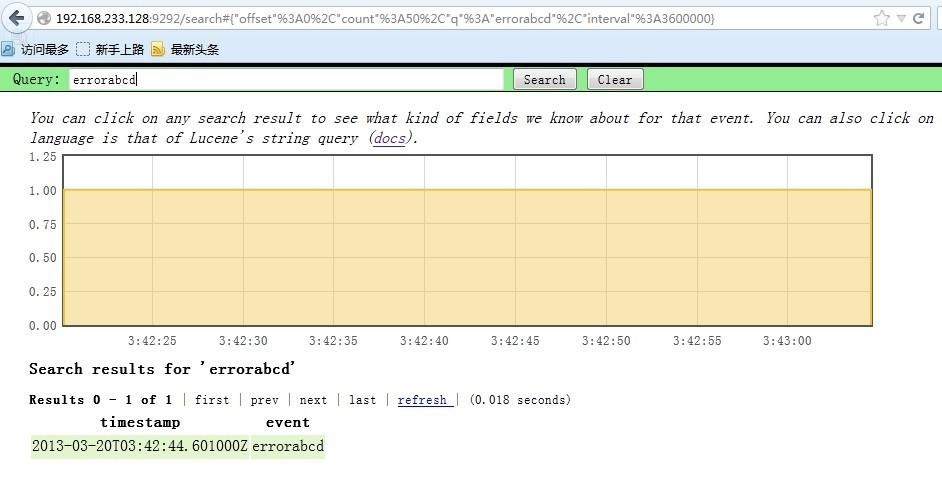

# echo errorabcd >> apache.log |

ok �� http://192.168.233.128:9292 ȥ����һ�� �ղŵ���������

�ţ����������ˣ��������Ҹ�php�Ĵ�����־�����ӵ�php.log�ļ���

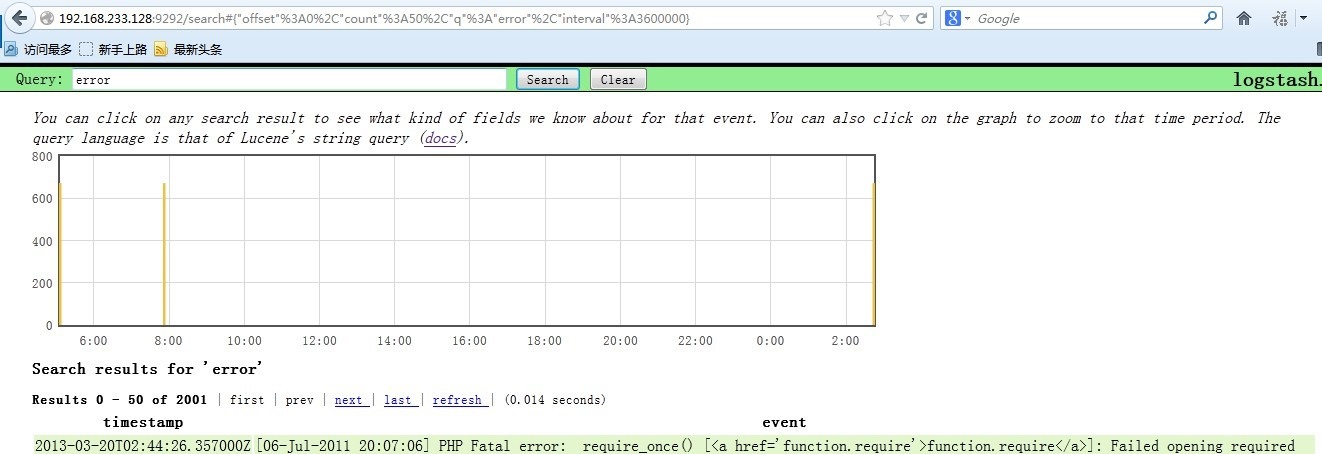

[192.168.233.129 root@noded:/soft]

# cat php-error.log >> php.log

�ڿ��� logstash��ҳ�� ����һ�� error

OK�������� Kibana�� ���Ұ�Kibanaװ���� logstash index����

���ص�ַΪ http://kibana.org/intro.html

[192.168.233.128 root@nodec:/soft]

# tar xf Kibana-0.2.0.tar.gz

[192.168.233.128 root@nodec:/soft]

# cd Kibana-0.2.0

[192.168.233.128 root@nodec:/soft/Kibana-0.2.0]

# bundle install

ֱ�Ӱ�װ�ͺ��ˣ��dz���

����Ϊ֮ǰ�����Ѿ���װ���� bundle

�༭�����ļ���ָ�� elasticsearch ��λ��

[192.168.233.128 root@nodec:/soft/Kibana-0.2.0]

# vim KibanaConfig.rb

.....

Elasticsearch = "localhost:9200"

KibanaPort = 5601

KibanaHost = '0.0.0.0'

.....

��Ҫ���⼸������

�����Ļ���Ҫruby

[192.168.233.128 root@nodec:/soft/Kibana-0.2.0]

# /usr/bin/ruby kibana.rb &

[192.168.233.128 root@nodec:/soft/Kibana-0.2.0]

# == Sinatra/1.3.5 has taken the stage on

5601 for development with backup from Thin

>> Thin web server (v1.5.0 codename Knife)

>> Maximum connections set to 1024

>> Listening on 0.0.0.0:5601, CTRL+C to stop

���ruby�Ķ�������ȱ�Ļ����������˳����

ok ���ڿ���5601�˿ڵ�״̬

[192.168.233.128 root@nodec:/soft/Kibana-0.2.0]

# lsof -i:5601

COMMAND PID USER FD TYPE DEVICE SIZE NODE NAME

ruby 3116 root 5u IPv4 28947 TCP *:esmagent (LISTEN) |

����һ�� ���Կ� http://192.168.233.128:5601 ��������һ��php�Ĵ�����־������mysql

�Ǻǣ�Ҫ�ľ������Ч������־��ʵʱ�Ļ��ܵ� logstash index �Ϲ����Dz�ѯ����Ȼ��ֻ�ǿ�ʼʹ��logstash�ĵ�һ�����ѣ�����ĸ����ܿ��Կ����ٷ��ĵ�

http://logstash.net/docs/1.1.9/

����������ҿ���һ��̽�֣���Ҳ�Ǹտ�ʼ�Ӵ�����������ռ���־���൱���㰡����˵���ܸ�nagios���

|